OpenAI выпустила привлекательную новую модель gpt-4o-audio-preview, которая совершила значительный прорыв в области генерации и анализа речи, предоставляя пользователям более естественный и интеллектуальный опыт голосового взаимодействия. Редактор Downcodes поможет вам глубже понять основные функции, сценарии применения и стратегии ценообразования этой модели, а также проанализировать ее потенциальное влияние на различные отрасли.

OpenAI снова лидирует в сфере технологий искусственного интеллекта и запускает новую модель gpt-4o-audio-preview. Эта модель не только демонстрирует удивительные возможности по генерации и анализу речи, но и открывает новые возможности взаимодействия человека и компьютера. Давайте подробнее рассмотрим особенности этой инновационной модели и ее потенциальное применение.

Основные функции gpt-4o-audio-preview включают три основных аспекта: во-первых, он может генерировать естественные и плавные голосовые ответы на основе текста, обеспечивая надежную поддержку таких приложений, как голосовые помощники и виртуальное обслуживание клиентов. Во-вторых, модель обладает способностью анализировать эмоции, интонацию и высоту звука, что имеет широкие перспективы применения в области аффективных вычислений и анализа пользовательского опыта. Наконец, он поддерживает голосовое взаимодействие, при котором звук может использоваться как в качестве входа, так и в качестве выхода, что закладывает основу для полного спектра систем голосового взаимодействия.

По сравнению с существующим API реального времени OpenAI, gpt-4o-audio-preview больше фокусируется на деталях обработки речи. Он превосходно справляется с генерацией речи, анализом настроений и речевым взаимодействием, уделяя особое внимание обработке тонких характеристик, таких как интонация и эмоции. Напротив, Realtime API больше ориентирован на обработку данных в реальном времени и подходит для сценариев, требующих немедленной обратной связи, таких как преобразование речи в текст в реальном времени или перевод в реальном времени и другие постоянно интерактивные приложения.

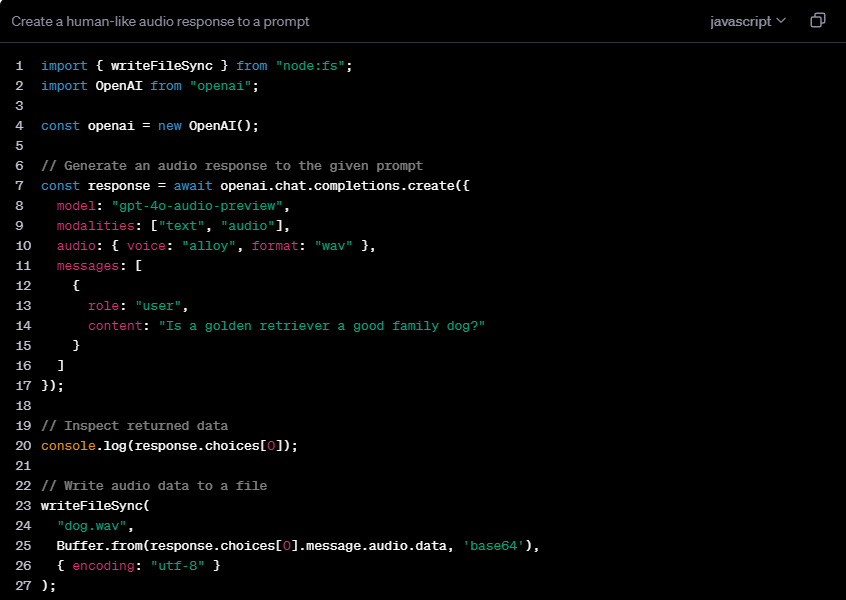

Гибкость gpt-4o-audio-preview отражена в поддержке нескольких комбинаций режимов. Пользователи могут выбрать текстовый ввод для создания текстового и аудиовывода или использовать аудиовход для получения текстового и речевого вывода. Кроме того, он также поддерживает преобразование аудио в текст и смешанные режимы ввода, предоставляя разработчикам богатые возможности.

Что касается ценообразования, OpenAI использует модель выставления счетов на основе токенов. Цена ввода текста относительно низкая — около 5 долларов за миллион токенов. Текстовый вывод немного выше — около 15 долларов за миллион токенов. Стоимость обработки звука относительно высока: входная стоимость составляет 100 долларов США за миллион токенов (приблизительно 0,06 доллара США в минуту), а выходной звук достигает 200 долларов США за миллион токенов (приблизительно 0,24 доллара США в минуту). Эта ценовая стратегия отражает сложность и требования к вычислительным ресурсам для обработки звука.

Запуск gpt-4o-audio-preview, несомненно, окажет преобразующее влияние на многие отрасли. В сфере обслуживания клиентов он может обеспечить более естественное и эмоциональное голосовое взаимодействие. В сфере образования эту технологию можно использовать для разработки интеллектуальных помощников по изучению языка, которые помогут учащимся улучшить произношение и интонацию. Ожидается, что в индустрии развлечений это будет способствовать более реалистичному синтезу речи и взаимодействию виртуальных персонажей. Кроме того, с точки зрения вспомогательных технологий, gpt-4o-audio-preview может предоставлять более точные услуги преобразования речи в текст для людей с нарушениями слуха или предоставлять более подробные голосовые описания для людей с нарушениями зрения.

Подробности: https://platform.openai.com/docs/guides/audio/quickstart.

В целом появление модели gpt-4o-audio-preview знаменует собой новый этап в технологии голосового искусственного интеллекта. Его мощные функции и широкие перспективы применения внесут революционные изменения в будущие методы взаимодействия человека и компьютера. Редактор Downcodes с нетерпением ожидает появления новых инновационных приложений на основе этой модели.