Редактор Downcodes узнал, что Пекинский научно-исследовательский институт искусственного интеллекта Чжиюань объединил усилия с рядом университетов для запуска крупной модели для понимания сверхдлинных видео под названием Video-XL. Модель хорошо справляется с обработкой длинных видео продолжительностью более десяти минут, занимая лидирующие позиции в нескольких тестах, демонстрируя сильные возможности обобщения и эффективность обработки. Video-XL использует языковые модели для сжатия длинных визуальных последовательностей и достигает почти 95% точности в таких задачах, как «поиск иголки в стоге сена». Для обработки 2048 кадров ввода требуется только видеокарта с 80 ГБ видеопамяти. Открытый исходный код этой модели будет способствовать сотрудничеству и развитию глобального исследовательского сообщества, занимающегося пониманием мультимодального видео.

Пекинский научно-исследовательский институт искусственного интеллекта Чжиюань объединил усилия с такими университетами, как Шанхайский университет Цзяо Тун, Китайский университет Жэньминь, Пекинский университет и Пекинский университет почты и телекоммуникаций, чтобы запустить большую модель сверхдлинного понимания видео под названием Video-XL. Эта модель является важной демонстрацией основных возможностей мультимодальных больших моделей и ключевым шагом на пути к общему искусственному интеллекту (AGI). По сравнению с существующими мультимодальными большими моделями Video-XL показывает лучшую производительность и эффективность при обработке длинных видео продолжительностью более 10 минут.

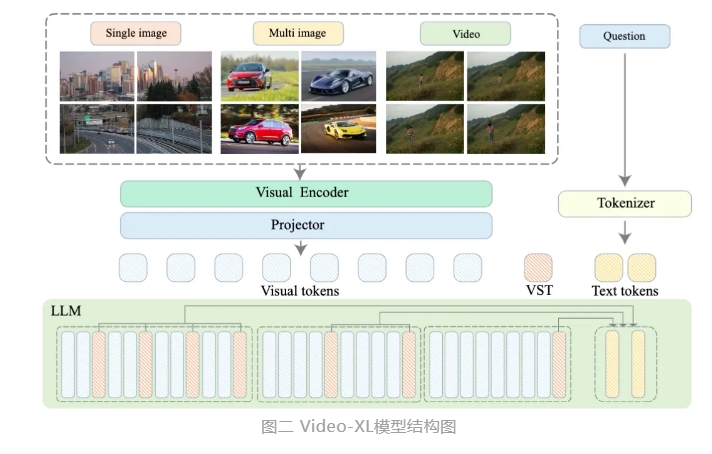

Video-XL использует собственные возможности языковых моделей (LLM) для сжатия длинных визуальных последовательностей, сохраняет способность понимать короткие видеоролики и демонстрирует отличные возможности обобщения при понимании длинных видео. Эта модель занимает первое место в нескольких задачах во многих основных тестах понимания длинных видео. Video-XL обеспечивает хороший баланс между эффективностью и производительностью. Ему нужна только видеокарта с 80 ГБ видеопамяти для обработки входных 2048 кадров, выборки часовых видео и достижения почти 95% видео в задаче «иголка в стоге сена». % точность.

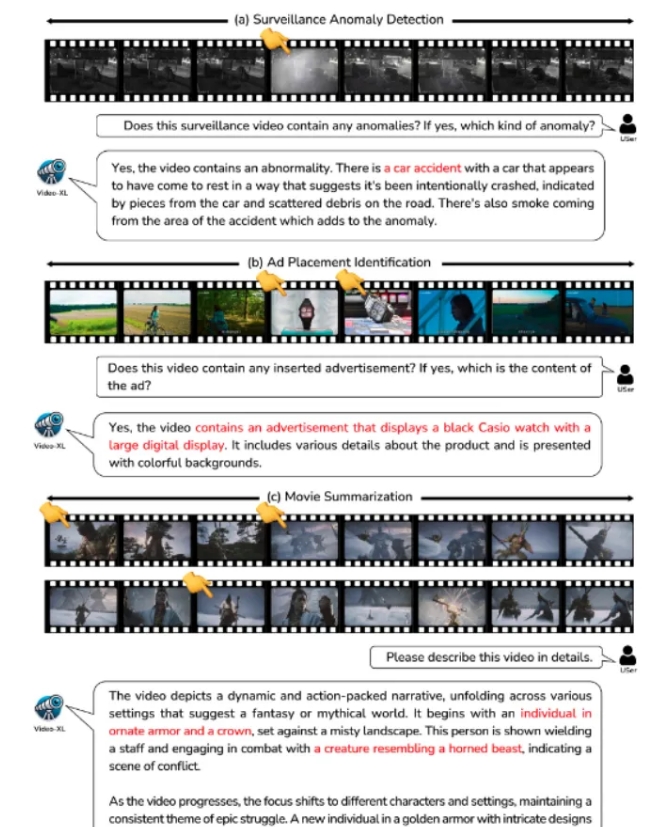

Ожидается, что Video-XL продемонстрирует большую ценность в таких сценариях применения, как обобщение фильмов, обнаружение видеоаномалий и обнаружение размещения рекламы, а также станет мощным помощником для понимания длительного видео. Запуск этой модели знаменует собой важный шаг в повышении эффективности и точности технологии распознавания длинного видео и обеспечивает мощную техническую поддержку для автоматизированной обработки и анализа длинного видеоконтента в будущем.

В настоящее время исходный код модели Video-XL открыт для содействия сотрудничеству и обмену технологиями в глобальном исследовательском сообществе, занимающемся пониманием мультимодального видео.

Название статьи: Video-XL: Языковая модель сверхдлинного видения для понимания видео в часовом масштабе

Ссылка на статью: https://arxiv.org/abs/2409.14485.

Ссылка на модель: https://huggingface.co/sy1998/Video_XL

Ссылка на проект: https://github.com/VectorSpaceLab/Video-XL

Открытый исходный код Video-XL открывает новые возможности для исследований и применения в области понимания длинных видео. Его эффективность и точность будут способствовать дальнейшему развитию соответствующих технологий и обеспечат техническую поддержку для большего количества сценариев применения в будущем. Мы с нетерпением ожидаем появления в будущем более инновационных приложений на базе Video-XL.