Израильский стартап в области искусственного интеллекта aiOla выпустил новую модель распознавания речи с открытым исходным кодом Whisper-Medusa, которая улучшена по сравнению с Whisper от OpenAI и работает на 50% быстрее. Ее исходный код открыт под лицензией MIT на Hugging Face и разрешено коммерческое использование. Редактор Downcodes даст вам подробное объяснение этой привлекательной новой модели.

Израильский стартап в области искусственного интеллекта aiOla недавно сделал большой шаг и объявил о запуске новой модели распознавания речи с открытым исходным кодом Whisper-Medusa.

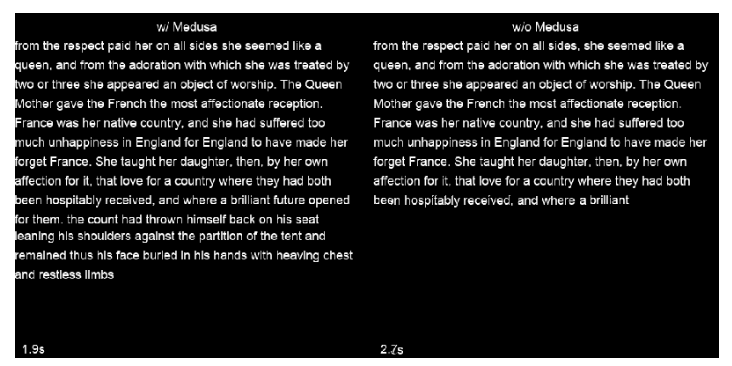

Эта модель непроста. Она на 50% быстрее знаменитого Whisper от OpenAI! Она построена на основе Whisper, но использует новую архитектуру «множественного внимания» для одновременного прогнозирования количества токенов. продукты. Более того, код и веса были опубликованы на Hugging Face под лицензией MIT, которая позволяет проводить исследования и коммерческое использование.

Гилл Хетц, вице-президент по исследованиям aiOla, сказал, что открытый исходный код может стимулировать инновации и сотрудничество сообщества, делая их быстрее и полнее. Эта работа может проложить путь к созданию сложных систем искусственного интеллекта, которые смогут понимать вопросы пользователей и отвечать на них практически в реальном времени.

В нашу эпоху, когда базовые модели могут создавать разнообразный контент, расширенное распознавание речи по-прежнему очень важно. Whisper, например, может обрабатывать сложную речь на разных языках и с разными акцентами. Его загружают более 5 миллионов раз в месяц, он поддерживает множество приложений и стал золотым стандартом распознавания речи.

Так что же такого особенного в Whisper-Medusa от aiOla?

Компания изменила структуру Whisper и добавила механизм внимания с несколькими головками, который может предсказывать 10 токенов одновременно и увеличивать скорость на 50%, не влияя на точность. Для обучения этой модели использовался метод машинного обучения со слабым контролем, и в будущем появятся более мощные версии. Более того, поскольку магистраль Whisper-Medusa построена на Whisper, повышение скорости не произойдет за счет производительности.

При обучении Whisper-Medusa aiOla использовала метод машинного обучения, называемый слабым контролем. В рамках этого он заморозил основные компоненты Whisper и обучил дополнительный модуль прогнозирования токенов, используя в качестве меток аудиотранскрипции, сгенерированные моделью.

Отвечая на вопрос, могут ли какие-либо компании получить ранний доступ к Whisper-Medusa, Хетц ответил, что они были протестированы на реальных сценариях использования корпоративных данных и могут точно работать в реальных сценариях, что сделает голосовые приложения более отзывчивыми в будущем. В конечном счете, он считает, что увеличение скорости распознавания и транскрипции позволит сократить время обработки голосовых приложений и проложит путь к предоставлению ответов в реальном времени.

Выделять:

На 50% быстрее: Whisper-Medusa от aiOla значительно быстрее, чем распознавание речи Whisper от OpenAI.

?Без потери точности: скорость повышается при сохранении той же точности, что и исходная модель.

Широкие перспективы применения: ожидается, что он ускорит реагирование, повысит эффективность и снизит затраты в голосовых приложениях.

В целом, модель Whisper-Medusa от aiOla, с ее преимуществом в скорости и атрибутами открытого исходного кода, как ожидается, откроет новую волну в области распознавания речи и принесет значительные улучшения производительности различных речевых приложений. Редактор Downcodes продолжит уделять внимание дальнейшему развитию и вкладу сообщества в эту модель.