В условиях стремительного роста контента, генерируемого искусственным интеллектом, платформы социальных сетей сталкиваются с беспрецедентной проблемой: как обеспечить, чтобы пользователи могли отличать правдивую информацию от ложной? Глава Instagram Адам Моссери недавно опубликовал на Threads серию постов, в которых выразил обеспокоенность по поводу контента, создаваемого искусственным интеллектом, и изложил стратегии Instagram и Meta по решению этой проблемы. Он подчеркнул, что пользователям необходимо быть более бдительными и научиться распознавать контент, созданный ИИ, и призвал платформы усилить контроль за контентом и повысить прозрачность и достоверность информации.

В недавней серии публикаций на Threads глава Instagram Адам Моссери подчеркнул, что пользователям социальных сетей необходимо быть более бдительными перед лицом растущего количества контента, генерируемого искусственным интеллектом.

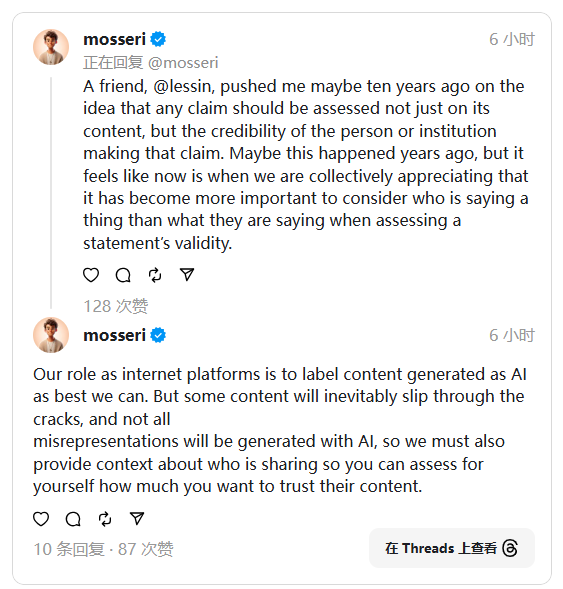

Он отметил, что изображения и информация, которые пользователи видят в Интернете, могут быть нереальными, поскольку технология искусственного интеллекта уже может генерировать контент, очень похожий на реальность. Чтобы помочь пользователям лучше оценить подлинность информации, Моссери отметил, что пользователи должны учитывать источник контента, и социальные платформы также несут ответственность за поддержку этого.

Моссери сказал, что роль платформ социальных сетей заключается в том, чтобы максимально маркировать сгенерированный ИИ контент, чтобы помочь пользователям его идентифицировать. Однако он также признал, что некоторый контент может быть пропущен и не будет вовремя отмечен. С этой целью он подчеркнул, что платформам также необходимо предоставлять пользователям справочную информацию об общем контенте, чтобы пользователи могли лучше решить, насколько доверять контенту. Его взгляды отражают глубокую обеспокоенность по поводу достоверности сообщений в социальных сетях.

На данном этапе Meta (материнская компания Instagram) не предоставила достаточно контекстной информации, чтобы помочь пользователям оценить подлинность контента. Тем не менее, компания недавно намекнула, что, возможно, вносит существенные изменения в свои правила содержания. Ожидается, что это изменение повысит доверие пользователей к информации и поможет им лучше справляться с проблемами, создаваемыми технологией искусственного интеллекта.

Моссери отметил, что пользователи должны подтвердить, что информация, предоставляемая чат-ботом, надежна, прежде чем доверять поисковой системе, управляемой искусственным интеллектом. Это похоже на проверку источника публикации или изображения, только информация, исходящая от авторитетных аккаунтов, заслуживает большего доверия.

Подход к модерации контента, который описывает Моссери, ближе к системам модерации, управляемым пользователем, таким как заметки сообщества в Твиттере и фильтры контента YouTube. Хотя неясно, представит ли Meta аналогичные функции, учитывая прошлый опыт компании, заимствованный у других платформ, за будущей политикой модерации контента стоит следить.

В целом, перед лицом проблем, связанных с контентом, созданным искусственным интеллектом, Instagram и Meta активно изучают решения, которые не только требуют усилий самой платформы, но и требуют от пользователей улучшения своих собственных способностей распознавания и совместного поддержания достоверность и безопасность онлайн-информации. То, как будет развиваться будущая модель контроля контента, заслуживает нашего постоянного внимания.