OpenAI объявила о визуализации расширенного голосового режима ChatGPT. Пользователи, подписавшиеся на Plus, Team или Pro, могут взаимодействовать с ChatGPT в режиме реального времени через камеры своих мобильных телефонов и иметь возможность совместного использования экрана. Эта функция уже много раз откладывалась и, наконец, была официально запущена после длительного периода тестирования. Однако не все пользователи смогут использовать ее немедленно. Некоторым регионам и типам пользователей придется подождать до января следующего года или даже дольше.

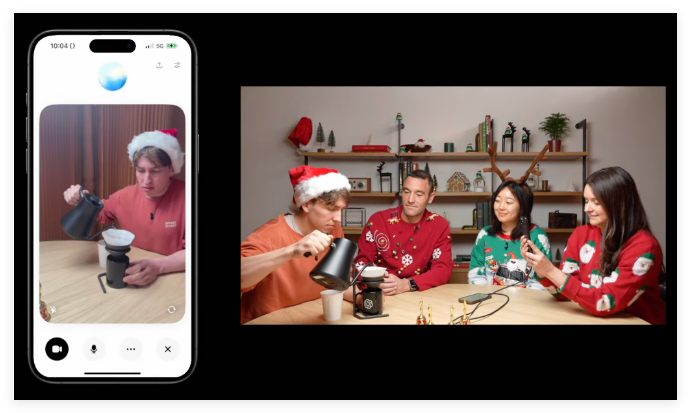

OpenAI объявила в четверг, что была визуализирована функция человеческого разговора «Расширенный речевой режим», разработанная ею для ChatGPT. Пользователи, оформившие подписку на ChatGPT Plus, Team или Pro, теперь могут навести камеру своего телефона на объект, и ChatGPT ответит практически в реальном времени.

Этот расширенный голосовой режим с функциями машинного зрения также включает возможности совместного использования экрана, которые анализируют содержимое на экране устройства. Например, он может объяснить различные меню настроек и дать советы по математическим задачам.

Способ использования очень прост: щелкните значок голоса рядом с панелью чата ChatGPT, а затем щелкните значок видео в левом нижнем углу, чтобы запустить видео. Если вы хотите поделиться своим экраном, вы можете нажать на трехточечное меню и выбрать «Поделиться экраном».

Что касается развертывания функции, OpenAI сообщила, что расширенный речевой режим со зрением будет запущен начиная с этого четверга и закончится на следующей неделе. Важно отметить, что не сразу это будет доступно всем пользователям. Пользователям ChatGPT Enterprise и Edu придется подождать до января следующего года, в то время как пользователи в ЕС, Швейцарии, Исландии, Норвегии и Лихтенштейне еще не объявили конкретный график.

Во время недавнего выступления на программе CNN «60 минут» президент OpenAI Грег Брокман продемонстрировал Андерсону Куперу расширенные возможности визуального анализа речевых моделей. Когда Купер рисовал на доске части человеческого тела, ChatGPT смог понять и прокомментировать его рисунки. Например, в нем говорится, что мозг расположен точно, и предполагается, что форма мозга близка к эллипсу.

Однако во время демонстрации этот расширенный речевой режим также выявил некоторые неточности, касающиеся геометрических вопросов, показывая потенциальный риск «галлюцинаций».

Стоит отметить, что запуск этого расширенного голосового режима с визуальными функциями задерживался несколько раз. В апреле OpenAI пообещала запустить его «в течение нескольких недель», но позже заявила, что для этого потребуется больше времени. Эта функция была недоступна некоторым пользователям ChatGPT до начала этой осени, а функция визуального анализа на тот момент еще не была доступна.

На фоне растущей конкуренции в области искусственного интеллекта такие конкуренты, как Google и Meta, также разрабатывают аналогичные возможности. На этой неделе Google открыла для некоторых тестировщиков Android свой диалоговый проект искусственного интеллекта Project Astra, предназначенный для анализа видео в реальном времени.

В дополнение к визуальным функциям OpenAI также запустила в четверг праздничный «Режим Санты», позволяющий пользователям включать голос Санты через значок снежинки рядом с панелью уведомлений в приложении ChatGPT.

Это визуальное обновление расширенного голосового режима ChatGPT отмечает улучшение способности ИИ взаимодействовать с реальным миром, но также раскрывает проблемы и ограничения в развитии технологий. В будущем стоит ожидать улучшения и популяризации подобных функций. Развитие технологий искусственного интеллекта будет продолжать влиять на наш образ жизни.