Команда Alibaba Tongyi Lab запустила CosyVoice 2.0. Эта крупная модель генерации речи с открытым исходным кодом совершила значительный прорыв в технологии синтеза речи. По сравнению с версией предыдущего поколения CosyVoice 2.0 значительно улучшила точность, стабильность и естественность, реализовала двусторонний потоковый синтез речи и значительно уменьшила задержку синтеза. Это обновление не только отражается на техническом уровне, но и обеспечивает качественный скачок в пользовательском опыте, предоставляя пользователям более богатые и удобные услуги синтеза речи.

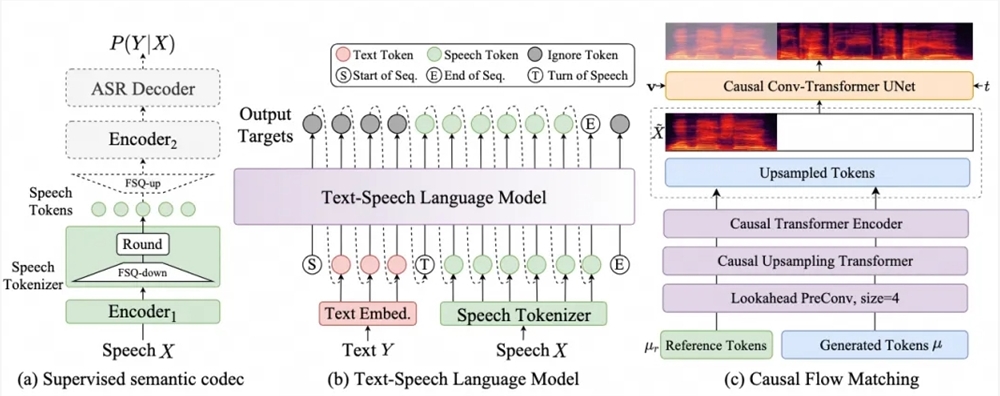

Команда ораторского искусства Alibaba Tongyi Lab объявила, что ее большая модель генерации речи с открытым исходным кодом CosyVoice была обновлена до версии 2.0. Это обновление знаменует собой значительное улучшение точности, стабильности и естественности технологии генерации речи. CosyVoice2.0 использует технологию генерации больших моделей речи, которая объединяет автономное и потоковое моделирование для достижения двустороннего потокового синтеза речи. Задержка первого синтеза пакета может достигать 150 мс, что значительно повышает скорость отклика синтеза речи.

Что касается точности произношения, CosyVoice2.0 имеет снижение уровня ошибок на 30–50 % по сравнению с предыдущей версией. Он достиг самого низкого уровня ошибок в словах на жестком тестовом наборе тестов Seed-TTS, особенно на синтетическом языке. твистеры, Отличное исполнение полифонических персонажей и редких персонажей. Кроме того, версия 2.0 поддерживает согласованность тембра при генерации речи с нулевой выборкой и синтезе межъязыковой речи. В частности, возможности синтеза межъязыковой речи были значительно улучшены по сравнению с версией 1.0.

CosyVoice2.0 также улучшил ритм, качество звука и эмоциональное соответствие синтезированного звука. Оценка MOS увеличилась с 5,4 до 5,53, что близко к баллу крупной коммерческой модели синтеза речи. В то же время версия 2.0 поддерживает более детальный контроль эмоций и контроль диалектного акцента, предоставляя пользователям более широкий выбор языков, включая основные диалекты, такие как кантонский диалект, сычуаньский диалект, диалект Чжэнчжоу, диалект Тяньцзинь и диалект Чанша, а также ролевые диалекты. игровые функции, такие как имитация роботов, речь в стиле Свинки Пеппы и т. д.

Обновление CosyVoice2.0 не только улучшает технологию и опыт синтеза речи, но также способствует дальнейшему развитию сообщества открытого исходного кода и побуждает больше разработчиков участвовать в инновациях и применении технологий обработки речи.

Репозиторий GitHub: CosyVoice (https://github.com/FunAudioLLM/CosyVoice). Ознакомьтесь с последней обновленной версией CosyVoice2.

Испытайте ДЕМО онлайн: https://www.modelscope.cn/studios/iic/CosyVoice2-0.5B

Открытый исходный код: https://github.com/FunAudioLLM/CosyVoice.

Модель с открытым исходным кодом: https://www.modelscope.cn/models/iic/CosyVoice2-0.5B.

Открытый исходный код CosyVoice 2.0 будет способствовать дальнейшему популяризации и развитию технологии синтеза речи, предоставит разработчикам и исследователям мощные инструменты и ресурсы, а также будет способствовать появлению более инновационных приложений. Добро пожаловать на ссылку, предоставленную для ознакомления и загрузки.