Answer.AI и LightOn совместно выпустили языковую модель с открытым исходным кодом ModernBERT, которая является значительным улучшением по сравнению с Google BERT и значительно повышает скорость, эффективность и качество. ModernBERT обрабатывает в четыре раза быстрее, чем BERT, использует меньше памяти и может обрабатывать текст длиной до 8192 токенов, что в 16 раз быстрее, чем существующие модели. Компания также впервые добилась прорывного прогресса в кодировании программного кода, набрав более 80 баллов в наборе данных StackOverflow Q&A, установив новый рекорд. Что еще более важно, ModernBERT значительно снижает стоимость крупномасштабной обработки текста и может работать на обычном оборудовании потребительского уровня, что делает его более экономичным, чем такие модели, как GPT-4.

Конструкция ModernBERT позволяет ему обрабатывать текст длиной до 8192 токенов, что в 16 раз превышает типичный предел в 512 токенов существующих моделей кодирования. Кроме того, ModernBERT — это первая тщательно обученная модель кодирования программного кода, получившая более 80 баллов в наборе данных StackOverflow Q&A, установив новый рекорд для моделей кодирования.

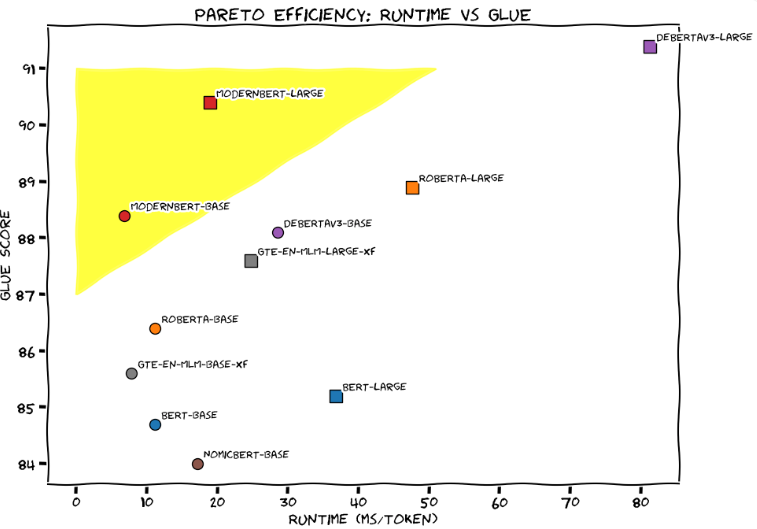

В оценке общего понимания языка (GLUE) ModernBERT-Large достиг наилучшего баланса скорости и точности обработки: время обработки примерно 20 миллисекунд на токен и оценка 90. Команда разработчиков наглядно сравнила ModernBERT с тюнингованной Honda Civic, подчеркнув его надежность и эффективность в повседневном использовании.

По сравнению с существующими крупномасштабными языковыми моделями, такими как GPT-4, ModernBERT значительно снижает стоимость крупномасштабной обработки текста. GPT-4 стоит копейки за запрос, а ModernBERT работает локально, быстрее и дешевле. Например, когда проект FineWeb Edu отфильтровал 15 миллиардов тегов, стоимость использования модели BERT составила 60 000 долларов США, и даже использование декодера Gemini Flash от Google стоило более 1 миллиона долларов США.

Команда разработчиков утверждает, что ModernBERT хорошо подходит для различных практических приложений, включая системы генерации расширенного поиска (RAG), поиск кода и просмотр контента. В отличие от GPT-4, для которого требуется специализированное оборудование, ModernBERT может эффективно работать на обычных потребительских игровых графических процессорах.

В настоящее время ModernBERT доступен в двух версиях: базовая модель содержит 139 миллионов параметров, а большая версия — 395 миллионов параметров. Обе версии теперь выпущены на Hugging Face, и пользователи могут напрямую заменять ими существующие модели BERT. Команда разработчиков планирует запустить более крупную версию в следующем году, но мультимодальные возможности не планируются. Чтобы способствовать разработке новых приложений, они также запускают конкурс, в рамках которого пять лучших докладчиков получат 100 долларов США и шестимесячную подписку Hugging Face pro.

С тех пор, как Google запустил BERT в 2018 году, эта модель стала одной из самых популярных языковых моделей: на HuggingFace ее загружали более 68 миллионов раз в месяц.

Вход в проект: https://huggingface.co/blog/modernbert

Выделять:

ModernBERT в четыре раза быстрее, чем BERT, и может обрабатывать текст длиной до 8192 токенов.

По сравнению с GPT-4 стоимость ModernBERT при крупномасштабной обработке текста значительно снижается, а его работа более эффективна.

Эта модель особенно хороша при обработке программного кода: она набрала более 80 баллов в наборе данных StackOverflow Q&A, установив новый рекорд.

Короче говоря, версия ModernBERT с открытым исходным кодом предоставляет разработчикам эффективный, экономичный и мощный выбор языковой модели. Он имеет значительные преимущества в скорости, эффективности и способности обрабатывать длинные тексты и, как ожидается, будет способствовать инновационной разработке большего количества приложений искусственного интеллекта. . С нетерпением ждем будущих обновлений и более широкого применения.