Команда Qwen открыла исходный код своей новейшей мультимодальной модели рассуждения QVQ, которая построена на Qwen2-VL-72B и значительно улучшает визуальное понимание и возможности рассуждения ИИ. QVQ получила высокий балл 70,3 в обзоре MMMU и превзошла свою предшественницу в нескольких математических тестах. В этой статье будут подробно представлены характеристики, преимущества, ограничения и использование модели QVQ, а также предоставлены соответствующие ссылки, которые помогут читателям лучше понять и использовать ее.

Команда Qwen недавно объявила об открытом исходном коде своей последней мультимодальной модели рассуждения QVQ, что ознаменовало важный шаг в визуальном понимании искусственного интеллекта и возможностях решения сложных задач. Эта модель построена на базе Qwen2-VL-72B и направлена на улучшение рассуждений ИИ за счет объединения языковой и визуальной информации. В оценке MMMU QVQ получил высокий балл 70,3 и продемонстрировал значительное улучшение производительности по сравнению с Qwen2-VL-72B-Instruct в нескольких тестах, связанных с математикой.

Модель QVQ показала особые преимущества в задачах визуального мышления, особенно в областях, требующих сложного аналитического мышления. Несмотря на отличную производительность QVQ-72B-Preview, команда также указала на некоторые ограничения модели, в том числе проблемы смешивания языков и переключения кода, возможность попадания в шаблоны циклической логики, соображения безопасности и этики, а также ограничения производительности и тестов. Команда подчеркнула, что, хотя модель улучшила визуальное мышление, она не может полностью заменить способности Qwen2-VL-72B. В ходе многоэтапного процесса визуального мышления модель может постепенно терять фокус на содержании изображения, что приводит к галлюцинациям.

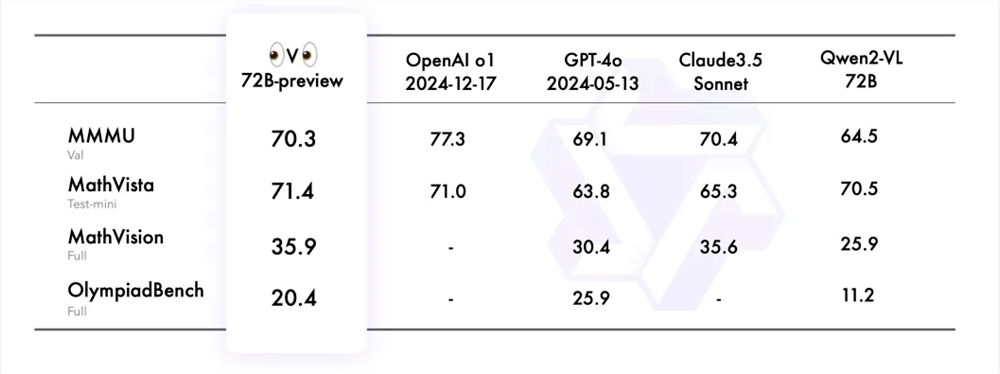

Команда Qwen оценила QVQ-72B-Preview на четырех наборах данных, включая MMMU, MathVista, MathVision и OlympiadBench. Эти наборы данных предназначены для изучения всесторонних возможностей модели по пониманию и рассуждению, связанных со зрением. QVQ-72B-Preview показал хорошие результаты в этих тестах, фактически сократив отставание от ведущей модели.

Чтобы дополнительно продемонстрировать применение модели QVQ в задачах визуального мышления, команда Qwen предоставила несколько примеров и поделилась ссылкой на технический блог. Кроме того, команда также предоставила примеры кода для вывода модели и способы использования Magic API-Inference для прямого вызова модели QVQ-72B-Preview. API-вывод Magic Platform обеспечивает поддержку модели QVQ-72B-Preview, и пользователи могут напрямую использовать эту модель посредством вызовов API.

Ссылка на модель:

https://modelscope.cn/models/Qwen/QVQ-72B-Preview

Ссылка на опыт:

https://modelscope.cn/studios/Qwen/QVQ-72B-preview

Китайский блог:

https://qwenlm.github.io/zh/blog/qvq-72b-preview

Открытый исходный код модели QVQ предоставляет ценные ресурсы для исследований мультимодального искусственного интеллекта, а также предвещает дальнейшее развитие ИИ в области визуального мышления в будущем. Несмотря на некоторые ограничения, его отличная производительность во многих тестах производительности по-прежнему впечатляет. Мы надеемся на дальнейшую оптимизацию и улучшение модели QVQ в будущем.