В конце года компания Beijing Zhipu Huazhang Technology Co., Ltd. выпустила первую версию GLM-Zero, первой модели вывода, обученной на основе технологии расширенного обучения с подкреплением — GLM-Zero-Preview. Эта модель продемонстрировала отличные возможности в математической логике, написании кода и решении сложных задач и достигла результатов, сопоставимых с аналогичными моделями OpenAI в многочисленных авторитетных оценках. GLM-Zero-Preview не только улучшает возможности экспертных задач, но также обеспечивает отличную производительность при выполнении общих задач, устанавливая новый стандарт для улучшения возможностей рассуждения искусственного интеллекта.

В конце года для Beijing Zhipu Huazhang Technology Co., Ltd. компания выпустила первую модель вывода, обученную на основе технологии расширенного обучения с подкреплением, — первую версию GLM-Zero, GLM-Zero-Preview. Эта модель направлена на улучшение рассуждений искусственного интеллекта, особенно в области математической логики, написания кода и сложной обработки задач, требующих глубоких рассуждений. По сравнению с базовой моделью GLM-Zero-Preview значительно улучшил свои возможности экспертных задач, сохранив при этом общие возможности задач. Его производительность в оценках AIME2024, MATH500 и LiveCodeBench эквивалентна OpenAI o1-preview.

Теперь пользователи могут бесплатно испытать GLM-Zero-Preview в агенте «Модель нулевого вывода» платформы Zhipu Qingyan. Платформа поддерживает загрузку текста и изображений, а модель выводит полный процесс рассуждения. При этом разработчики также могут вызывать данную модель через API открытой платформы Zhipu.

Хотя между GLM-Zero-Preview и моделью o3 OpenAI все еще существует определенный разрыв, Zhipu Huazhang Technology Co., Ltd. планирует продолжать оптимизировать технологию итеративного обучения с подкреплением и вскоре выпустит официальную версию GLM-Zero для расширения возможностей. глубокого мышления от математической логики до более общих технологических областей.

С точки зрения производительности модели, GLM-Zero-Preview демонстрирует важность обучения с подкреплением для расширения возможностей модели по глубокому рассуждению. По мере увеличения объема обучения производительность модели в таких аспектах, как глубокое рассуждение, постоянно улучшается. Также был проверен закон масштабирования модели на этапе вывода. То есть по мере того, как количество токенов, которые может обдумывать модель, увеличивается и требуется больше вычислений, качество результатов, предоставляемых моделью, также неуклонно улучшается. GLM-Zero-Preview может реализовать автономное принятие решений, декомпозицию проблем и попробовать несколько способов решения проблем в процессе рассуждения, который аналогичен человеческому мышлению и процессу принятия решений.

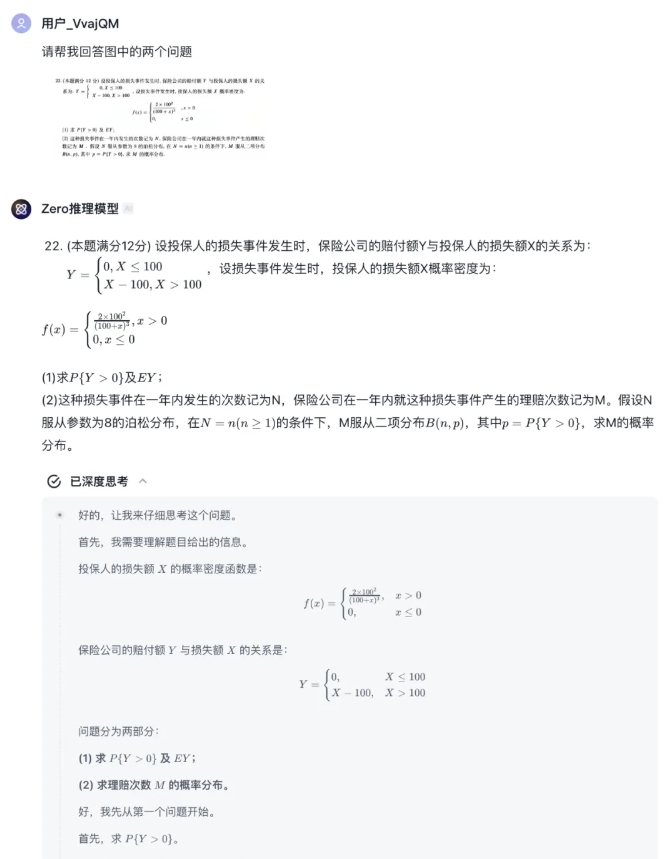

В реальных тестовых случаях GLM-Zero-Preview продемонстрировал способность выявлять логические лазейки и моделировать множество предположений с точки зрения логического рассуждения. С точки зрения математики модель обладает сильными индуктивными и дедуктивными возможностями, может быстро обрабатывать сложные математические операции и достигла уровня выдающегося аспиранта на вступительном экзамене по математике для аспирантов 2025 года I. Что касается программирования, GLM-Zero-Preview владеет несколькими языками программирования и помогает разработчикам быстро писать код.

Спектр мудрости ясные слова:

https://chatglm.cn/main/gdetail/676411c38945bbc58a905d31?lang=zh

Открытая платформа Жипу:

https://bigmodel.cn/dev/api/normal-model/glm-zero-preview

Запуск GLM-Zero-Preview означает, что Zhipu Huazhang добилась значительного прогресса в области рассуждений с помощью искусственного интеллекта. Его бесплатная и открытая стратегия также облегчает работу разработчиков и пользователей и обеспечивает обратную связь, предоставляя ценные данные для итеративной оптимизации будущих моделей. Мы с нетерпением ждем выхода официальной версии GLM-Zero, которая будет способствовать дальнейшему развитию технологий искусственного интеллекта.