15 января 2025 года MiniMax выпустила новую серию моделей MiniMax-01 с открытым исходным кодом, включая большую текстовую модель MiniMax-Text-01 и визуальную мультимодальную большую модель MiniMax-VL-01. Эта серия параметров модели достигает 456 миллиардов при однократной активации 45,9 миллиардов. Она смело внедряет инновации в архитектуре и впервые применяет механизм линейного внимания в больших масштабах, преодолевая ограничения традиционного Трансформера и способного. эффективной обработки контекстов до 4 миллионов токенов, что значительно опережает существующие модели. Серия MiniMax-01 находится на одном уровне с лучшими зарубежными моделями по производительности и демонстрирует значительные преимущества при обработке длинных текстов. Ее эффективные возможности обработки и низкая цена делают ее чрезвычайно конкурентоспособной в коммерческих приложениях.

Компания MiniMax объявила об открытии исходного кода своей новой серии моделей MiniMax-01 15 января 2025 года. В серию входят базовая языковая большая модель MiniMax-Text-01 и визуальная мультимодальная большая модель MiniMax-VL-01. Серия MiniMax-01 внесла смелые инновации в архитектуру, впервые реализовав механизм линейного внимания в больших масштабах, преодолев ограничения традиционной архитектуры Transformer. Его объем параметров достигает 456 миллиардов, а одна активация — 45,9 миллиардов. Его комплексная производительность сопоставима с лучшими зарубежными моделями, и он может эффективно обрабатывать контексты до 4 миллионов токенов. Эта длина в 32 раза больше, чем у GPT-4o. и Клод-3,5-Сонет 20 раз.

MiniMax считает, что 2025 год станет критическим годом для быстрого развития агентов. Будь то система с одним агентом или система с несколькими агентами, для поддержки непрерывной памяти и больших объемов связи необходим более длинный контекст. Запуск серии моделей MiniMax-01 призван удовлетворить этот спрос и сделать первый шаг в раскрытии базовых возможностей сложных Агентов.

Благодаря архитектурным инновациям, оптимизации эффективности, интегрированному кластерному обучению и push-проектированию MiniMax может предоставлять услуги API текстового и мультимодального понимания по самому низкому ценовому диапазону в отрасли. Стандартная цена составляет 1 юань за миллион токенов и 8 выходных токенов. юань/сто жетонов. Открытая платформа MiniMax и зарубежная версия были запущены для разработчиков.

Модели серии MiniMax-01 выложены в открытый доступ на GitHub и будут постоянно обновляться. В основных отраслевых оценках понимания текста и мультимодального понимания серия MiniMax-01 сравнялась с международно признанными усовершенствованными моделями GPT-4o-1120 и Claude-3.5-Sonnet-1022 в большинстве задач. Особенно для задач с длинным текстом, по сравнению с моделью Gemini от Google, MiniMax-Text-01 имеет самое медленное снижение производительности при увеличении длины ввода, что значительно лучше, чем у Gemini.

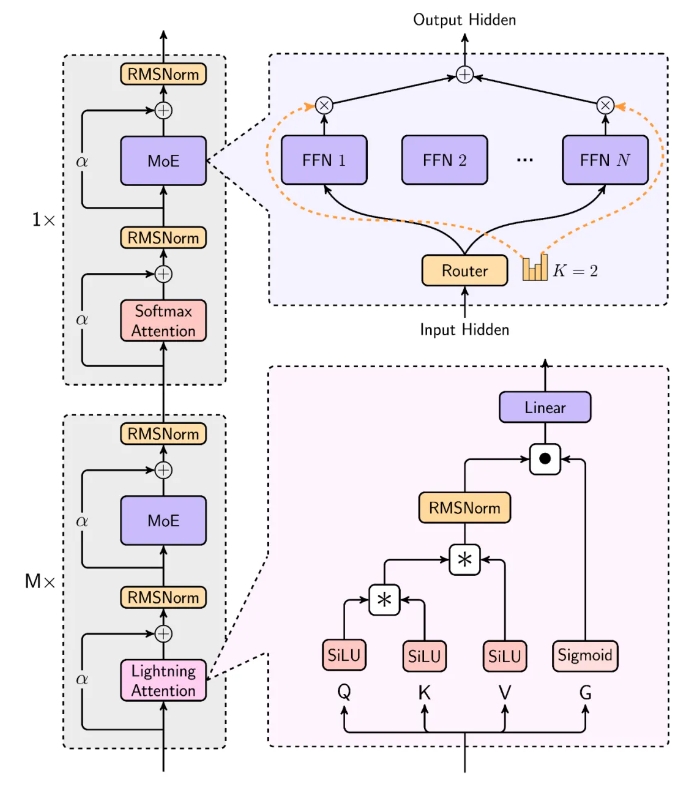

Модель MiniMax чрезвычайно эффективна при обработке длинных входных данных, сложность которых приближается к линейной. В его структурной конструкции 7 из каждых 8 уровней используют линейное внимание, основанное на Lightning Attention, а 1 слой использует традиционное внимание SoftMax. Впервые в отрасли механизм линейного внимания был расширен до уровня коммерческой модели. MiniMax всесторонне рассмотрел закон масштабирования в сочетании с MoE, структурным проектированием, оптимизацией обучения и оптимизацией вывода, а также реконструировал систему обучения и вывода. включая более эффективную MoE Оптимизацию связи «все со всеми», оптимизацию более длинных последовательностей и эффективную реализацию линейного внимания в ядре на уровне вывода.

В большинстве академических испытаний серия MiniMax-01 достигла результатов, сравнимых с результатами первого зарубежного уровня. Он значительно опережает набор длинных контекстных оценок, например, по превосходной производительности в задаче извлечения 4 миллионов иголок в стоге сена. В дополнение к наборам академических данных MiniMax также создал набор вспомогательных тестов на основе реальных данных, и MiniMax-Text-01 показал превосходные результаты в этом сценарии. В наборе тестов мультимодального понимания MiniMax-VL-01 также впереди.

Адрес открытого исходного кода: https://github.com/MiniMax-AI.

Открытый исходный код моделей серии MiniMax-01 вдохнул новую жизнь в развитие области искусственного интеллекта. Его прорывы в обработке длинных текстов и мультимодальном понимании будут способствовать быстрому развитию технологии агентов и связанных с ней приложений. Мы с нетерпением ждем новых инноваций и прорывов от MiniMax в будущем.