В условиях стремительного роста объема видеоданных вопрос о том, как эффективно использовать видеоинформацию для поиска знаний и ответов на вопросы, стал горячей темой исследований. Традиционные системы поиска и дополненной генерации (RAG) в основном полагаются на текстовую информацию, и им трудно в полной мере использовать богатую мультимодальную информацию, содержащуюся в видео. В этой статье представлена новая платформа под названием VideoRAG, которая способна динамически извлекать видео, соответствующие запросу, и эффективно интегрировать визуальную и текстовую информацию для генерации более точных и информативных ответов. Платформа использует большие языковые модели видео (LVLM) для обеспечения плавной интеграции мультимодальных данных и обработки видео без субтитров с помощью технологии автоматического распознавания речи, что значительно повышает эффективность поиска и генерации.

С быстрым развитием видеотехнологий видео стало важным инструментом поиска информации и понимания сложных концепций. Видео объединяет визуальные, временные и контекстуальные данные, обеспечивая мультимодальное представление, выходящее за рамки статических изображений и текста. Сегодня, с распространением платформ обмена видео и распространением образовательных и информационных видеороликов, использование видео в качестве источника знаний открывает беспрецедентные возможности для решения вопросов, требующих подробного контекста, пространственного понимания и демонстрации процессов.

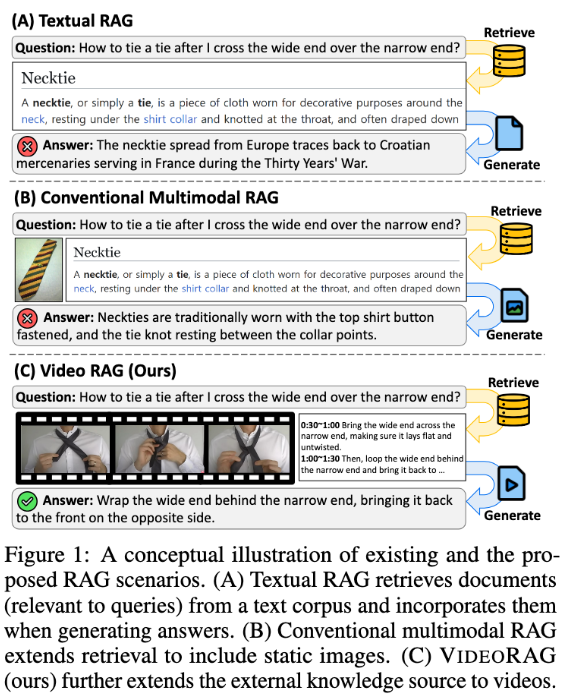

Однако существующие системы дополненной генерации (RAG) часто упускают из виду весь потенциал видеоданных. Эти системы часто полагаются на текстовую информацию и иногда используют статические изображения для поддержки ответов на запросы, но не могут уловить визуальную динамику и мультимодальные сигналы, содержащиеся в видео, которые имеют решающее значение для сложных задач. Традиционные подходы либо предварительно определяют видео, связанные с запросом, без извлечения, либо преобразуют видео в текстовый формат, тем самым теряя важный визуальный контекст и временную динамику, ограничивая возможность предоставления точных и информативных ответов.

Чтобы решить эти проблемы, исследовательская группа из Корейского института передовых наук и технологий (KaIST) и DeepAuto.ai предложила новую платформу — VideoRAG. Платформа способна динамически получать видео, соответствующие запросу, и интегрировать визуальную и текстовую информацию в процесс генерации. VideoRAG использует передовые крупномасштабные модели языка видео (LVLM) для достижения плавной интеграции мультимодальных данных, гарантируя, что полученные видео контекстуально соответствуют запросам пользователей, и поддерживая временное разнообразие видеоконтента.

Рабочий процесс VideoRAG разделен на два основных этапа: поиск и создание. На этапе поиска платформа идентифицирует видео, похожие на его визуальные и текстовые характеристики, посредством запроса.

На этапе генерации используется технология автоматического распознавания речи для генерации вспомогательных текстовых данных для видео без субтитров, тем самым гарантируя, что генерация ответа для всех видео может эффективно предоставлять информацию. Соответствующие извлеченные видео далее вводятся в модуль генерации, который объединяет мультимодальные данные, такие как видеокадры, субтитры и текст запроса, и обрабатывает их с помощью LVLM для генерации длинных, насыщенных, точных и контекстуально соответствующих ответов.

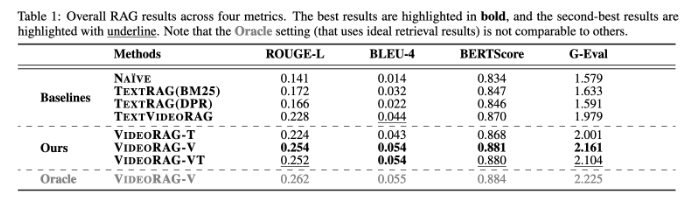

VideoRAG проводит обширные эксперименты с такими наборами данных, как WikiHowQA и HowTo100M, и результаты показывают, что качество ответа значительно лучше, чем у традиционных методов. Эта новая структура не только улучшает возможности систем генерации расширений поиска, но также устанавливает новые стандарты для будущих мультимодальных поисковых систем.

Статья: https://arxiv.org/abs/2501.05874.

Выделять:

**Новая платформа**: VideoRAG динамически извлекает соответствующие видео и объединяет визуальную и текстовую информацию для улучшения эффекта генерации.

**Экспериментальная проверка**: протестировано на нескольких наборах данных и показало значительно лучшее качество ответа, чем традиционный метод RAG.

**Технические инновации**: Используя крупномасштабные модели языка видео, VideoRAG открывает новую главу в интеграции мультимодальных данных.

В целом, платформа VideoRAG обеспечивает новое решение задач улучшения поиска информации на основе видео. Ее достижения в области мультимодальной интеграции данных и поиска информации предоставляют важную информацию для будущих более интеллектуальных и точных систем поиска информации. Ожидается, что результаты исследования найдут широкое применение в образовании, медицине и других областях.