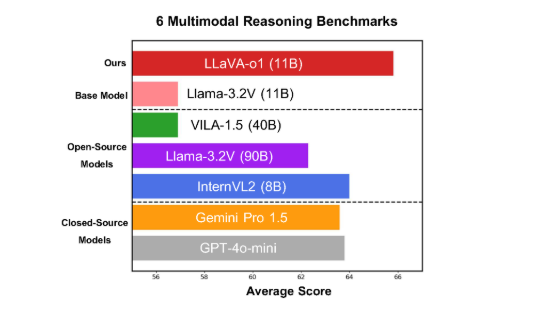

Такие исследовательские группы, как Пекинг Университет, недавно выпустили многомодовую модель с открытым исходным кодом Llava-O1. Систематические рассуждения. Llava-O1 принимает механизм рассуждения «медленного мышления», чтобы разложить процесс рассуждения на четыре этапа: краткое изложение, визуальное интерпретация, логические рассуждения и генерация выводов, что эффективно избегает ошибок, вызванных упрощением традиционных процессов рассуждений моделей. Эта модель хорошо выполнялась в шести сложных тестах, превзошла многих конкурентов и хорошо выполнялась при сравнении более крупных или закрытых источников.

В последнее время научные исследовательские группы, такие как Peking University, объявили о выпуске многомодовой модели с открытым исходным кодом, называемой Llava-O1. O1.

Эта модель хорошо выполнялась в шести сложных многомодах тестов.

Llava-O1 основан на модели Llama-3.2-Vision.

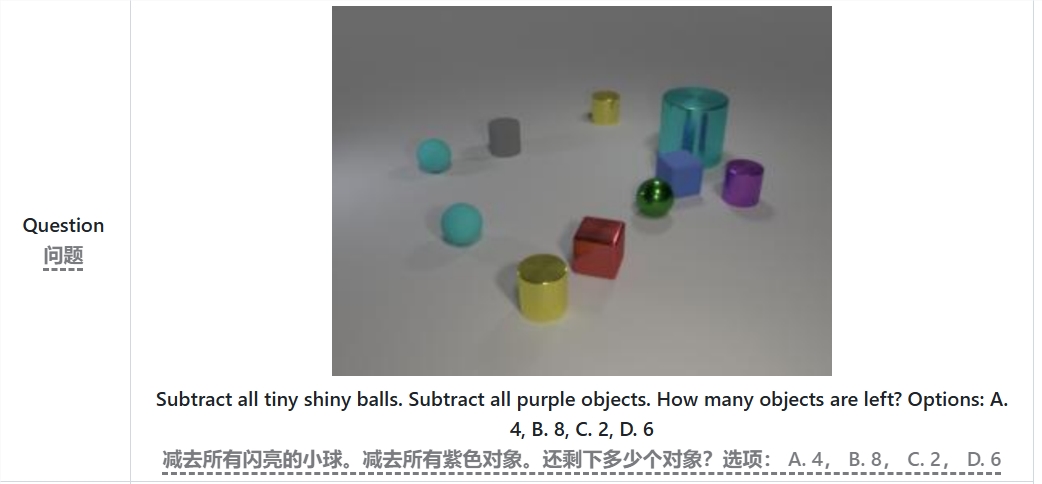

В тесте с многомодовым контролем рассуждений производительность Llava-O1 превысила свою базовую модель в 8,9%. Уникальность этой модели заключается в том, что ее процесс рассуждения делится на четыре этапа: краткое изложение, визуальная интерпретация, логические рассуждения и генерация выводов. В традиционных моделях процесс рассуждения часто является относительно простым, и его легко вызвать ошибки.

Например, при решении проблемы «минус все маленькие яркие шарики и фиолетовые объекты, сколько объектов осталось», Llava-O1 сначала обобщает проблему, затем извлеките информацию из изображения, затем постепенно разум и, наконец, даст ей чтобы дать это. Этот метод в фазе расширяет возможности рассуждения системы модели и делает его более эффективным при решении сложных проблем.

Стоит отметить, что Llava-O1 представил метод поиска луча на уровне этапа в процессе рассуждения. Этот метод позволяет модели генерировать несколько ответов кандидатов на каждом этапе рассуждения и выбирать лучший ответ, чтобы продолжить следующий этап рассуждений, что значительно улучшает общее качество рассуждений. Придерживаясь точной настройки и разумных данных обучения, Llava-O1 показал хорошо по сравнению с более крупными или закрытыми источниками.

Результаты исследований команды Пекинского университета не только способствовали развитию мультимодального ИИ, но и предоставили новые идеи и методы для будущих моделей понимания визуального языка. Команда заявила, что код Llava-O1, предварительный тренировочный вес и наборы данных будут полностью открыты, и ожидается, что все больше исследователей и разработчиков будут исследовать и применяют эту инновационную модель вместе.

Тезис: https://arxiv.org/abs/2411.10440

Github: https: //github.com/pku- Yuanroup/llava-O1

Очки:

Llava-O1-это новая многомодальная модель рассуждений, выпущенная такими командами, как Peking University, которая способна «медленно думать».

Производительность превышает 8,9%базовой модели в тесте на многочисленную оценку рассуждений.

Llava-O1 через структурированные многоэтапные рассуждения, чтобы обеспечить точность и будет открытым исходным кодом в ближайшем будущем.

Открытый источник Llava-O1 будет способствовать исследованию и разработке многомодальных областей ИИ и обеспечит прочную основу для построения более интеллектуальных и более сильных моделей визуального языка. С нетерпением жду возможности показать больший потенциал в будущих приложениях. Документы и ссылки на GitHub удобны для исследователей, чтобы понять и использовать модель подробно.