Недавно исследовательская группа публично выпустила структуру миграции выражения под названием Hellomeme, которая может перенести выражения одного человека на образы другого человека со сверхвысокой верностью. Благодаря своей уникальной сетевой структуре и инновационному модулю Animatediff, Hellomeme достигает идеального баланса гладкости и высокого качества изображения для генерации видео, и поддерживает Arkit Face Blendshapes, давая пользователям прекрасный контроль над выражениями персонажей. Кроме того, его конструкция адаптера горячей замены обеспечивает совместимость с моделью SD1.5, расширяет возможности создания и значительно повышает эффективность генерации видео. В этой статье подробно будут представлены основные функции, технические функции и сравнения с другими методами фреймворка Hellomeme.

Недавно исследовательская группа выпустила структуру под названием Hellomeme, которая может перенести выражение одного человека на картинке на изображение персонажа на другой картине.

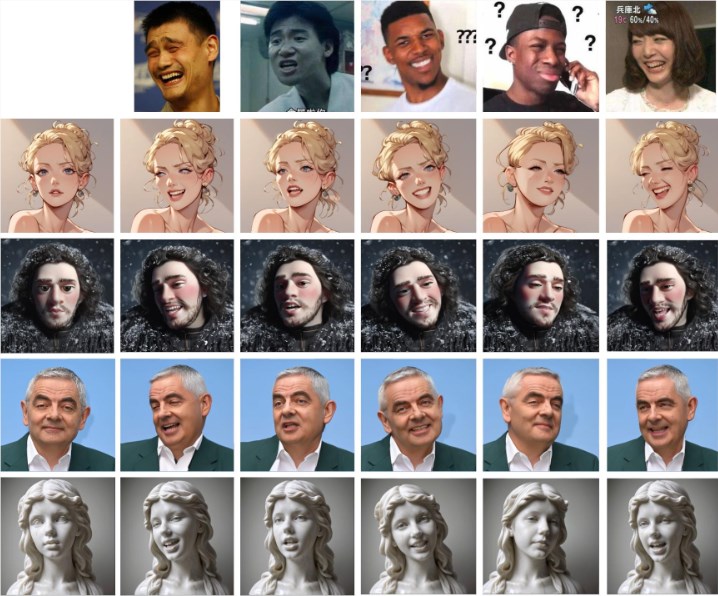

Как показано на следующем рисунке, дайте изображение выражения (первая строка), а затем вы можете перенести детали выражения символам на других изображениях.

Ядром Hellomeme является его уникальная сетевая структура. Рамка способна извлекать функции каждого кадра из приводного видео и вводить эти функции в HMControlmodule. Благодаря такой обработке исследователи могут генерировать плавные видеоизображения. Тем не менее, в изначально сгенерированном видео существует проблема мерцания между кадрами, что влияет на общий опыт просмотра. Чтобы решить эту проблему, команда представила модуль Animatediff, инновации, которая значительно улучшила непрерывность видео, но также в некоторой степени снизила точность картины.

В ответ на это противоречие исследователи также оптимизировали и скорректировали модуль анимированного анализа, в конечном итоге достигнув высокого качества изображения, при этом улучшая непрерывность видео.

Кроме того, Hellomeme Framework также обеспечивает мощную поддержку для редактирования выражения лица. Привязывая Arkit Face Blendshapes, пользователи могут легко контролировать выражения лицевых символов в сгенерированном видео. Эта гибкость позволяет создателям генерировать видео с определенными эмоциями и выражениями по мере необходимости, значительно обогащая выразительность видеоконтента.

С точки зрения технической совместимости, Hellomeme принимает дизайн адаптера с горячими заводом на основе SD1.5. Самым большим преимуществом этой конструкции является то, что он не влияет на способность обобщения модели T2I (текстовый к изображению), что позволяет любым стилизованным моделям, разработанным на SD1.5, плавно интегрироваться с Hellomeme. Это предоставляет больше возможностей для различных творений.

Исследовательская группа обнаружила, что введение HmReferenceModule значительно улучшило условия верности при создании видео, что означает, что этапы отбора проб могут быть уменьшены при создании высококачественных видео. Это открытие не только повышает эффективность поколения, но и открывает новые двери для генерации видео в реальном времени.

Эффект сравнения с другими методами заключается в следующем.

Вход в проект: https://songkey.github.io/hellomeme/

https://github.com/hellovision/comfyui_hellomeme

Ключевые моменты:

Hellomeme достигает двойного улучшения беглости генерации видео и качества изображений благодаря своей уникальной сетевой структуре и модуле Animatediff.

Фреймворк поддерживает смеси Arkit Face Blendshapes, позволяя пользователям гибко контролировать выражения персонажей лица и обогащать производительность видеоконтента.

Конструкция адаптера горячих заводов обеспечивает совместимость с другими моделями на основе SD1.5, обеспечивая большую гибкость для создания.

Благодаря своей эффективной способности к миграции выражения, гладким эффектом генерации видео и мощной совместимостью, фреймворк Hellomeme предоставляет новые возможности для создания видео и, как ожидается, сыграет важную роль в производстве кино и телевидения, спецэффекты анимации и других областей. Его функции с открытым исходным кодом также способствуют большему количеству разработчиков участвовать и совместно способствовать дальнейшему развитию и улучшению технологии.