Последние исследования в области искусственного интеллекта показывают удивительное сходство между крупными языковыми моделями (LLMS) и структурами мозга человека. Благодаря углубленному анализу пространства активации LLM ученые в MIT обнаружили, что его внутренняя структура имеет значительное соответствие с уровнями Micro, Meso и Macro в человеческом мозге. Это открытие не только дает нам новую перспективу, чтобы понять, как работает ИИ, но и закладывает основу для будущего развития умных систем ИИ.

ИИ на самом деле начал «выращивать ваш мозг»?!

В этом исследовании использовалась разреженная технология AutoEncoder для проведения углубленного анализа пространства активации LLM и обнаружил три уровня структурных характеристик, что было удивительно:

Во -первых, на микроскопическом уровне исследователи обнаружили существование «кристаллической» структуры. Лицы этих «кристаллов» состоят из параллелограммов или трапеций, похожих на знакомые словарный запас, такие как «Мужчина: Женщины: Король: Королева».

Что еще более удивительно, так это то, что эти «кристаллические» структуры становятся более ясными после удаления некоторых неактуальных интерференционных факторов (таких как длина слова) с помощью линейных дискриминантных методов анализа.

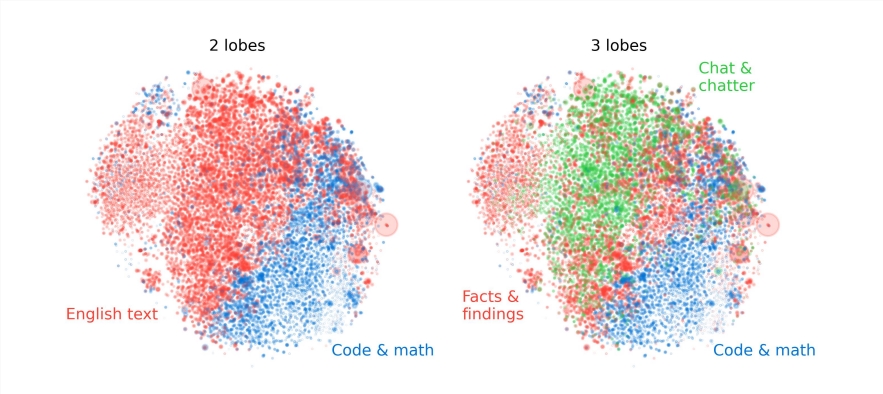

Во-вторых, на мезоуровне исследователи обнаружили, что пространство активации LLM имеет модульную структуру, аналогичную функциональному разделу человеческого мозга.

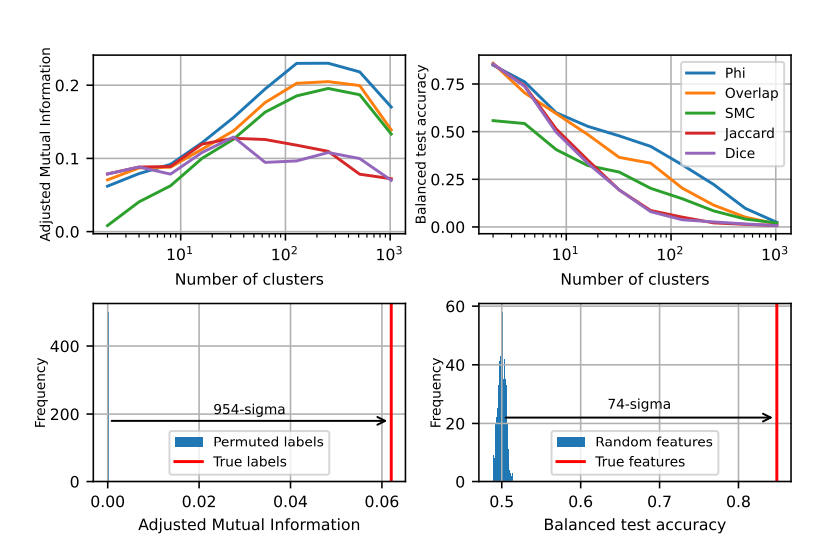

Например, функции, связанные с математикой и кодом, будут собираться вместе, чтобы сформировать «мозговую долю», аналогичную функциональной доле человеческого мозга. Благодаря количественному анализу по нескольким показателям исследователи подтвердили пространственную местность этих «доли мозга», что указывает на то, что совместные признаки также более пространственно сконцентрированы, что намного превышает ожидания случайного распределения.

На макроуровне исследователи обнаружили, что общая структура облака точек функций LLM не является изотропной, но показывает распределение собственного значения власти, и это распределение наиболее очевидно в промежуточном уровне.

Исследователи также определили количественно энтропию кластеризации на разных уровнях и обнаружили, что кластеризационная энтропия промежуточного слоя была ниже, что указывает на то, что представление признаков была более концентрированной, в то время как кластеризационная энтропия ранних и поздних слоев была выше, что указывает на то, что представление признака был более рассеян.

Это исследование дает нам новую перспективу, чтобы понять внутренние механизмы крупных языковых моделей и закладывает основу для будущего разработки более мощных и умных систем ИИ.

Это исследование не только показывает сходство между ИИ и человеческим мозгом, но также обеспечивает новое направление для будущего развития технологии ИИ, что указывает на то, что ИИ станет умнее и эффективнее.