2024/10/21 : 我们发布 Mini-InternVL 系列。这些模型以最小的尺寸实现了令人印象深刻的性能:4B 模型仅用 5% 的模型尺寸即可实现 90% 的性能。欲了解更多详情,请查看我们的项目页面和文档。

2024/08/01 :Chartmimic 团队根据其基准评估了 InternVL2 系列模型。 InternVL2-26B 和 76B 模型取得了开源模型中前两名的性能,其中 InternVL2 76B 模型超越了 GeminiProVision,并表现出与 Claude-3-opus 相当的结果。

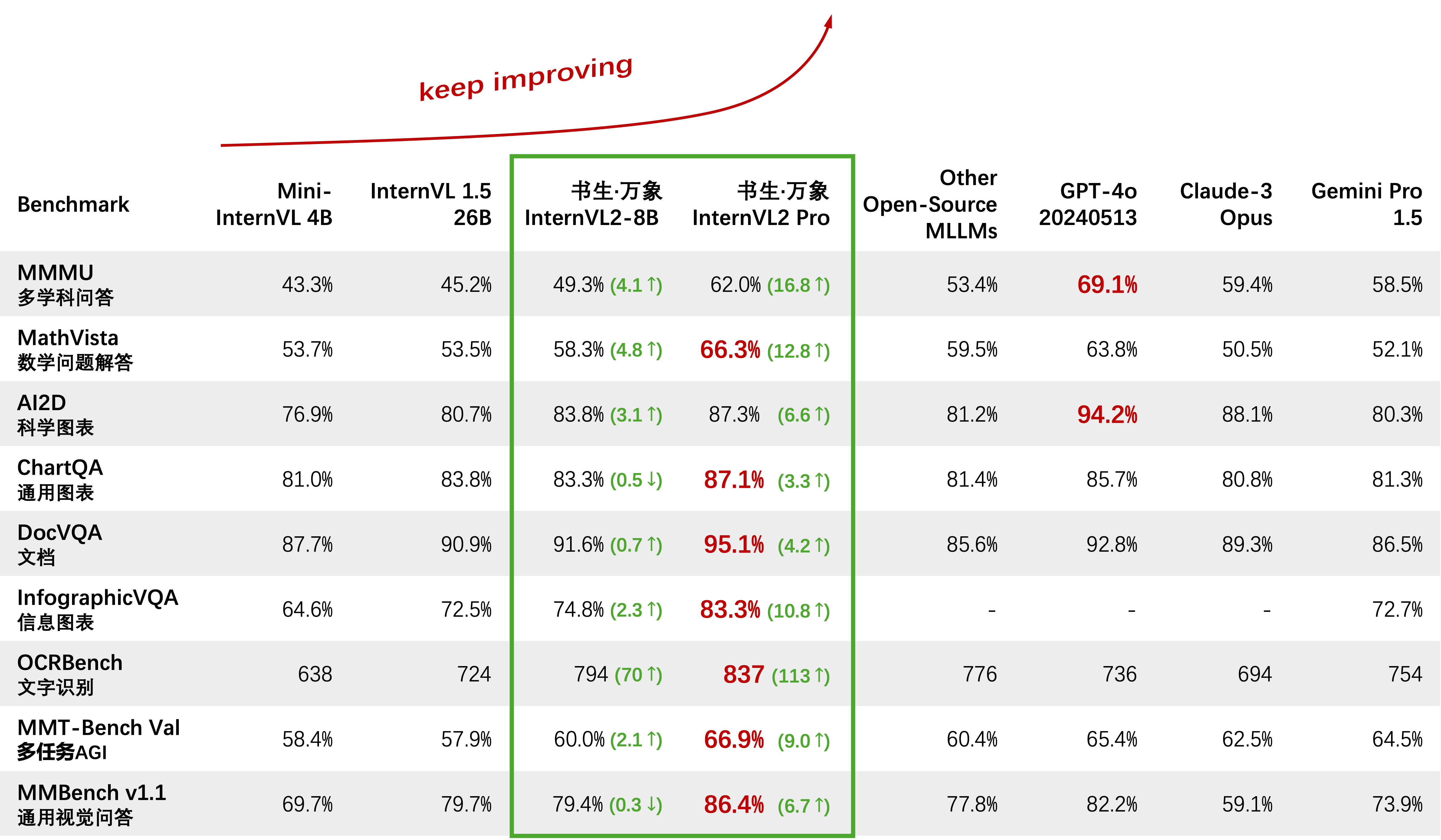

2024/08/01 : InternVL2-Pro 在 CharXiv 数据集上实现了开源模型中的 SOTA 性能,超越了 GPT-4V、Gemini 1.5 Flash、Claude 3 Sonnet 等众多闭源模型。

2024/07/24 :MLVU 团队根据其基准评估了 InternVL-1.5。多项选择任务的平均成绩为 50.4%,而生成任务的平均成绩为 4.02。在多项选择任务上的表现在所有开源 MLLM 中排名第一。

2024/07/18 : ?? InternVL2-40B 在 Video-MME 数据集上的开源模型中实现了 SOTA 性能,输入 16 帧时得分为 61.2,输入 32 帧时得分为 64.4。它显着优于其他开源模型,是最接近 GPT-4o mini 的开源模型。

2024/07/18 : ? InternVL2-Pro 在 DocVQA 和 InfoVQA 基准测试中实现了 SOTA 性能。

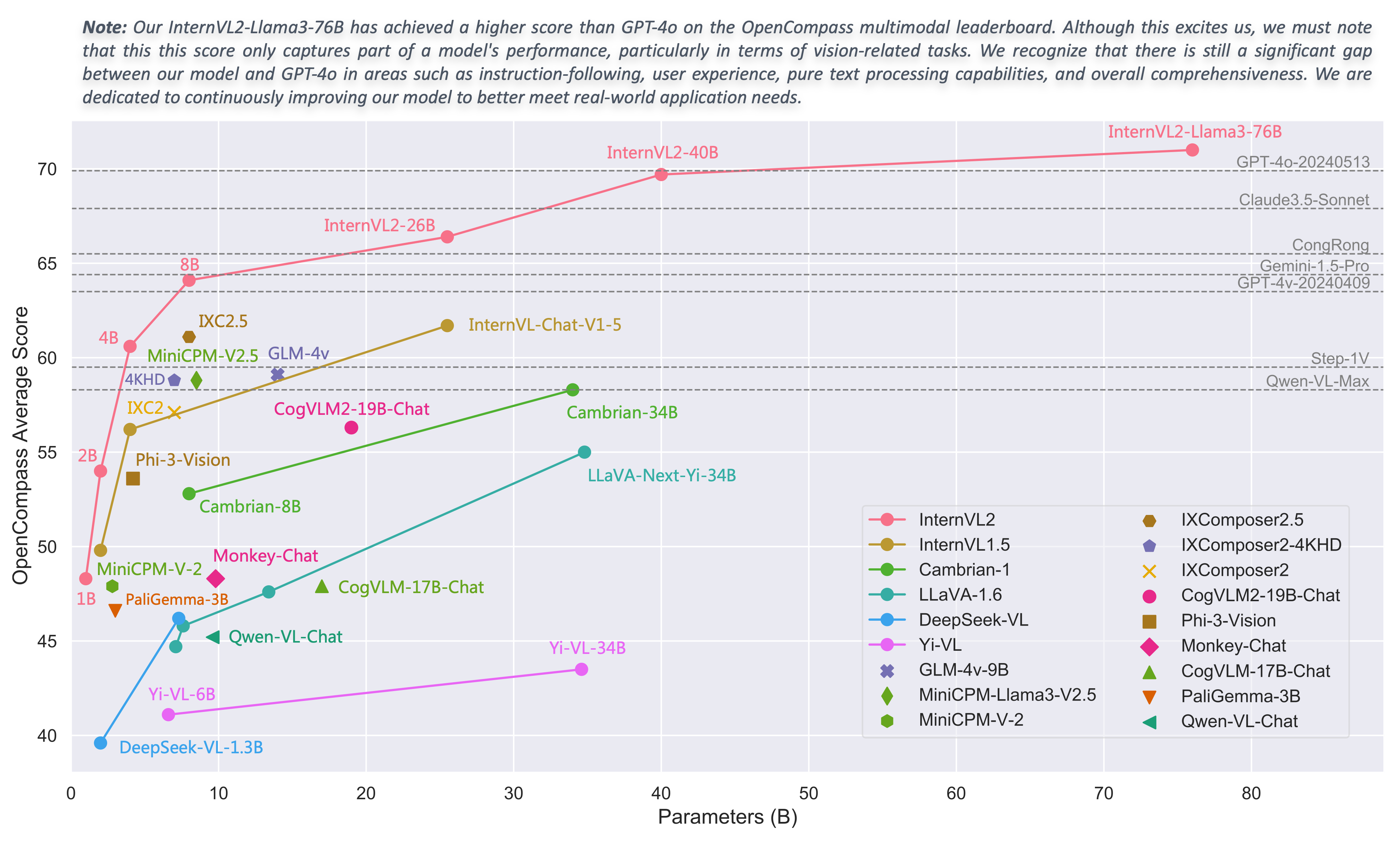

2024/07/04 : ?我们发布了 InternVL2 系列。 InternVL2-Pro 在 MMMU 基准测试中达到了 62.0% 的准确率,与 GPT-4o 等领先的闭源商业模型的性能相当。该模型的免费API可以通过填写(申请表)/(申请表)来申请。其他型号可在 HF link 上购买。

2024/06/19 :我们提出了多模态大海捞针(MM-NIAH),这是第一个旨在系统评估现有 MLLM 理解长多模态文档的能力的基准。

2024/05/30 :我们发布了 ShareGPT-4o,这是一个大规模数据集,我们计划开源该数据集,其中包含 200K 图像、10K 视频和 10K 音频以及详细描述。

2024/05/28 :感谢lmdeploy团队提供AWQ量化支持。 4 位模型可从 OpenGVLab/InternVL-Chat-V1-5-AWQ 获取。

2024/05/13 :InternVL 1.0 现在可以用作扩散模型的文本编码器,以支持全球 110 多种语言的多语言生成。更多详情请参见《花木兰》。

2024/04/18 : InternVL-Chat-V1-5 已在 HF link 发布,在 MMMU、DocVQA、ChartQA、MathVista 等各种基准测试上接近 GPT-4V 和 Gemini Pro 的性能。

2024/02/27 : InternVL 被 CVPR 2024 (Oral) 接收! ?

2024/02/21 : InternVL-Chat-V1-2-Plus 在 MathVista (59.9)、MMBench (83.8) 和 MMVP (58.7) 上实现了 SOTA 性能。请参阅我们的博客了解更多详细信息。

2024/02/12 : InternVL-Chat-V1-2 已发布。它在 MMMU val 上达到 51.6,在 MMBench 测试上达到 82.3。欲了解更多详情,请参阅我们的博客和SFT数据。该模型现已在 HuggingFace 上提供,并且训练/评估数据和脚本都是开源的。

2024/01/24 : InternVL-Chat-V1-1 发布,支持中文,OCR 能力更强,见这里。

2024/01/16 : 我们发布了定制的 mmcv/mmsegmentation/mmdetection 代码,与 DeepSpeed 集成,可用于训练大规模检测和分割模型。

支持vLLM和Ollama

使用 readthedocs 重建文档

支持使用 LoRA 微调不同的 LLM

在线演示支持视频和PDF输入

发布带有 VisionLLMv2 集成的 InternVL2

InternVL2 的发布requirements.txt

发布InternVL2系列培训/评估代码

发布适用于 InternVL1.5 和 InternVL2 的 Streamlit Web UI

开始使用

安装:[环境][requirements.txt]

评估数据准备:【InternVL评估】

聊天数据格式:[元文件][纯文本][单图][多图][视频]

InternVL-聊天 API:[InternVL2-Pro]

本地聊天演示:[Streamlit 演示] [Gradio 演示] [LMDeploy 演示]

教程:[使用 LoRA 微调增强 COCO 字幕上的 InternVL2]

实习生VL家族

InternVL 2.0:[简介][快速入门][Finetune][评估][部署]

InternVL 1.5:[简介][快速入门][Finetune][评估][部署]

InternVL 1.2:[简介][快速入门][Finetune][评估]

InternVL 1.1:[简介][快速入门][评估]

InternVL 1.0:[分类] [CLIP-Benchmark] [分段] [InternVL-Chat-LLaVA] [InternVL-G]

| 型号名称 | 愿景部分 | 语言部分 | 高频链路 | 女士链接 | 文档 |

|---|---|---|---|---|---|

| 实习生VL2-1B | InternViT-300M-448px | Qwen2-0.5B-指令 | ?关联 | ?关联 | ?文档 |

| 实习生VL2-2B | InternViT-300M-448px | internlm2-chat-1-8b | ?关联 | ?关联 | ?文档 |

| 实习生VL2-4B | InternViT-300M-448px | Phi-3-mini-128k-指令 | ?关联 | ?关联 | ?文档 |

| 实习生VL2-8B | InternViT-300M-448px | internlm2_5-7b-聊天 | ?关联 | ?关联 | ?文档 |

| 实习生VL2-26B | InternViT-6B-448px-V1-5 | internlm2-chat-20b | ?关联 | ?关联 | ?文档 |

| 实习生VL2-40B | InternViT-6B-448px-V1-5 | Nous-Hermes-2-Yi-34B | ?关联 | ?关联 | ?文档 |

| 实习生VL2-Llama3-76B | InternViT-6B-448px-V1-5 | Hermes-2-Theta- 骆驼-3-70B | ?关联 | ?关联 | ?文档 |

我们欢迎大家使用我们的 API 进行研究。为了更好的管理,请提交(申请表)/(申请表)以获得免费的API访问权限。

| 模型 | 日期 | 高频链路 | 女士链接 | 笔记 |

|---|---|---|---|---|

| Mini-InternVL-Chat-4B-V1-5 | 2024年5月28日 | ?关联 | ?关联 | ?? 16% 的模型大小,90% 的性能 |

| Mini-InternVL-Chat-2B-V1-5 | 2024年5月19日 | ?关联 | ?关联 | ? 8% 的模型大小,80% 的性能 |

| 实习生VL-Chat-V1-5 | 2024年4月18日 | ?关联 | ?关联 | 支持4K图像;超强OCR;在 MMMU、DocVQA、ChartQA、MathVista 等各种基准上接近 GPT-4V 和 Gemini Pro 的性能。 |

| 实习生VL-Chat-V1-2-Plus | 2024年2月21日 | ?关联 | ?关联 | SFT数据更多更强 |

| 实习生VL-Chat-V1-2 | 2024年2月11日 | ?关联 | ?关联 | LLM 升级至 34B |

| 实习生VL-Chat-V1-1 | 2024年1月24日 | ?关联 | ?关联 | 支持中文,OCR更强大 |

| 实习生VL-Chat-19B | 2023年12月25日 | ?关联 | ?关联 | 英语多模态对话 |

| 实习生VL-Chat-13B | 2023年12月25日 | ?关联 | ?关联 | 英语多模态对话 |

| 模型 | 日期 | 高频链路 | 女士链接 | 笔记 |

|---|---|---|---|---|

| InternViT-300M-448px | 2024年5月25日 | ?关联 | ?关联 | 具有 300M 参数的精炼小视觉基础模型(?新) |

| InternViT-6B-448px-V1-5 | 2024年4月20日 | ?关联 | ?关联 | 通过增量预训练支持动态分辨率和超强OCR特征提取能力(?新) |

| InternViT-6B-448px-V1-2 | 2024年2月11日 | ?关联 | ?关联 | 通过增量预训练支持448分辨率 |

| InternViT-6B-448px-V1-0 | 2024年1月30日 | ?关联 | ?关联 | 通过增量预训练支持448分辨率 |

| InternViT-6B-224px | 2023年12月22日 | ?关联 | ?关联 | InternViT-6B 的第一个版本,摘自 InternVL-14B-224px |

| 模型 | 日期 | 高频链路 | 女士链接 | 笔记 |

|---|---|---|---|---|

| 实习生VL-14B-224px | 2023年12月22日 | ?关联 | ?关联 | 视觉语言基础模型InternViT-6B + QLLaMA,可用于像CLIP一样的图文检索 |

线性探针图像分类[查看详情]

ViT-22B 使用私有 JFT-3B 数据集。

| 方法 | #参数 | IN-1K | 现实中 | IN-V2 | IN-A | 内R | 草图内 |

|---|---|---|---|---|---|---|---|

| OpenCLIP-G | 1.8B | 86.2 | 89.4 | 77.2 | 63.8 | 87.8 | 66.4 |

| DINov2-g | 1.1B | 86.5 | 89.6 | 78.4 | 75.9 | 78.8 | 62.5 |

| EVA-01-CLIP-g | 1.1B | 86.5 | 89.3 | 77.4 | 70.5 | 87.7 | 63.1 |

| MAWS-ViT-6.5B | 6.5B | 87.8 | - | - | - | - | - |

| ViT-22B* | 21.7B | 89.5 | 90.9 | 83.2 | 83.8 | 87.4 | - |

| InternViT-6B(我们的) | 5.9B | 88.2 | 90.4 | 79.9 | 77.5 | 89.8 | 69.1 |

语义分割【查看详情】

| 方法 | 解码器 | #param(训练/总计) | 作物尺寸 | 米卢 |

|---|---|---|---|---|

| OpenCLIP-G(冻结) | 线性 | 0.3M/1.8B | 第512章 | 39.3 |

| ViT-22B(冷冻) | 线性 | 0.9M/21.7B | 504 | 34.6 |

| InternViT-6B(冷冻) | 线性 | 0.5M/5.9B | 504 | 47.2 (+12.6) |

| ViT-22B(冷冻) | 上网 | 0.8B/22.5B | 504 | 52.7 |

| InternViT-6B(冷冻) | 上网 | 0.4B / 6.3B | 504 | 54.9(+2.2) |

| ViT-22B | 上网 | 22.5B / 22.5B | 504 | 55.3 |

| 实习生ViT-6B | 上网 | 6.3B / 6.3B | 504 | 58.9(+3.6) |

零样本图像分类【查看详情】

| 方法 | IN-1K | IN-A | 内R | IN-V2 | 草图内 | 对象网 |

|---|---|---|---|---|---|---|

| OpenCLIP-G | 80.1 | 69.3 | 92.1 | 73.6 | 68.9 | 73.0 |

| EVA-02-CLIP-E+ | 82.0 | 82.1 | 94.5 | 75.7 | 71.6 | 79.6 |

| ViT-22B* | 85.9 | 90.1 | 96.0 | 80.9 | - | 87.6 |

| 实习生VL-C(我们的) | 83.2 | 83.8 | 95.5 | 77.3 | 73.9 | 80.6 |

多语言零样本图像分类[查看详情]

EN:英语、ZH:中文、JP:日语、Ar:阿拉伯语、IT:意大利语

| 方法 | IN-1K(英语) | IN-1K (ZH) | IN-1K(日本) | IN-1K (AR) | IN-1K(意大利) |

|---|---|---|---|---|---|

| 太乙-CLIP-ViT-H | - | 54.4 | - | - | - |

| 悟空-ViT-LG | - | 57.5 | - | - | - |

| CN-CLIP-ViT-H | - | 59.6 | - | - | - |

| AltCLIP-ViT-L | 74.5 | 59.6 | - | - | - |

| EVA-02-CLIP-E+ | 82.0 | - | - | - | 41.2 |

| OpenCLIP-XLM-RH | 77.0 | 55.7 | 53.1 | 37.0 | 56.8 |

| 实习生VL-C(我们的) | 83.2 | 64.5 | 61.5 | 44.9 | 65.7 |

零样本视频分类

| 方法 | #框架 | K400 | K600 | K700 |

|---|---|---|---|---|

| OpenCLIP-G | 1 | 65.9 | 66.1 | 59.2 |

| EVA-02-CLIP-E+ | 1 | 69.8 | 69.3 | 63.4 |

| 实习生VL-C(我们的) | 1 | 71.0 | 71.3 | 65.7 |

| 维CLIP | 8 | 75.7 | 73.5 | 66.4 |

| 实习生VL-C(我们的) | 8 | 79.4 | 78.8 | 71.5 |

英文零样本图文检索【查看详情】

| 模型 | Flickr30K | 可可 | 平均 | ||||||||||

| 图像到文本 | 文本到图像 | 图像到文本 | 文本到图像 | ||||||||||

| R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | ||

| OpenCLIP-G | 92.9 | 99.3 | 99.8 | 79.5 | 95.0 | 97.1 | 67.3 | 86.9 | 92.6 | 51.4 | 74.9 | 83.0 | 85.0 |

| EVA-02-CLIP-E+ | 93.9 | 99.4 | 99.8 | 78.8 | 94.2 | 96.8 | 68.8 | 87.8 | 92.8 | 51.1 | 75.0 | 82.7 | 85.1 |

| EVA-CLIP-8B | 95.6 | 99.6 | 99.9 | 80.8 | 95.5 | 97.6 | 70.3 | 89.3 | 93.9 | 53.0 | 76.0 | 83.4 | 86.2 |

| 实习生VL-C(我们的) | 94.7 | 99.6 | 99.9 | 81.7 | 96.0 | 98.2 | 70.6 | 89.0 | 93.5 | 54.1 | 77.3 | 84.6 | 86.6 |

| 实习生VL-G(我们的) | 95.7 | 99.7 | 99.9 | 85.0 | 97.0 | 98.6 | 74.9 | 91.3 | 95.2 | 58.6 | 81.3 | 88.0 | 88.8 |

中文零样本图文检索【查看详情】

| 模型 | Flickr30K-CN | COCO-CN | 平均 | ||||||||||

| 图像到文本 | 文本到图像 | 图像到文本 | 文本到图像 | ||||||||||

| R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | R@1 | R@5 | 电阻@10 | ||

| CN-CLIP-ViT-H | 81.6 | 97.5 | 98.8 | 71.2 | 91.4 | 95.5 | 63.0 | 86.6 | 92.9 | 69.2 | 89.9 | 96.1 | 86.1 |

| OpenCLIP-XLM-RH | 86.1 | 97.5 | 99.2 | 71.0 | 90.5 | 94.9 | 70.0 | 91.5 | 97.0 | 66.1 | 90.8 | 96.0 | 87.6 |

| 实习生VL-C(我们的) | 90.3 | 98.8 | 99.7 | 75.1 | 92.9 | 96.4 | 68.8 | 92.0 | 96.7 | 68.9 | 91.9 | 96.5 | 89.0 |

| 实习生VL-G(我们的) | 92.9 | 99.4 | 99.8 | 77.7 | 94.8 | 97.3 | 71.4 | 93.9 | 97.7 | 73.8 | 94.4 | 98.1 | 90.9 |

XTD上的多语言零样本图文检索[查看详情]

| 方法 | CN | ES | FR | ZH | 它 | KO | 鲁 | 太平绅士 | 平均的 |

|---|---|---|---|---|---|---|---|---|---|

| 替代剪辑 | 95.4 | 94.1 | 92.9 | 95.1 | 94.2 | 94.4 | 91.8 | 91.7 | 93.7 |

| OpenCLIP-XLM-RH | 97.3 | 96.1 | 94.5 | 94.7 | 96.0 | 90.2 | 93.9 | 94.0 | 94.6 |

| 实习生VL-C(我们的) | 97.3 | 95.7 | 95.1 | 95.6 | 96.0 | 92.2 | 93.3 | 95.5 | 95.1 |

| 实习生VL-G(我们的) | 98.6 | 97.7 | 96.5 | 96.7 | 96.9 | 95.1 | 94.8 | 96.1 | 96.6 |

请参阅“与 SOTA VLLM 比较”部分。

导入 torchfrom PIL 导入 Imagefrom 变压器导入 AutoModel, CLIPImageProcessormodel = AutoModel.from_pretrained('OpenGVLab/InternViT-6B-448px-V1-5',torch_dtype=torch.bfloat16,low_cpu_mem_usage=True,trust_remote_code=True).cuda().eval( )image = Image.open('./examples/image1.jpg').convert('RGB')image_processor = CLIPImageProcessor.from_pretrained('OpenGVLab/InternViT-6B-448px-V1-5')pixel_values = image_processor(images=图像, return_tensors='pt').pixel_valuespixel_values = Pixel_values.to(torch.bfloat16).cuda()outputs = model(pixel_values)导入 torchfrom PIL 导入 Imagefrom 变压器 导入 AutoModel, CLIPImageProcessorfrom 变压器 导入 AutoTokenizermodel = AutoModel.from_pretrained('OpenGVLab/InternVL-14B-224px',torch_dtype=torch.bfloat16,low_cpu_mem_usage=True,trust_remote_code=True).cuda().eval() image_processor = CLIPImageProcessor.from_pretrained('OpenGVLab/InternVL-14B-224px')tokenizer = AutoTokenizer.from_pretrained('OpenGVLab/InternVL-14B-224px', use_fast=False, add_eos_token=True)tokenizer.pad_token_id = 0 # 将 pad_token_id 设置为 0images = [Image.open('./examples/image1.jpg').convert('RGB'),Image.open('./examples/image2.jpg').convert('RGB'),Image.open( './examples/image3.jpg').convert('RGB')

]prefix = 'summarize:'texts = [prefix + '一张小熊猫的照片', # Englishprefix + '一张熊猫的照片', # Chineseprefix + '二匹の猫の写真' # Japanese]pixel_values = image_processor( images=images, return_tensors='pt').pixel_valuespixel_values = Pixel_values.to(torch.bfloat16).cuda()input_ids = tokenizer(texts, return_tensors='pt', max_length=80, truncation=True, padding='max_length' ).input_ids.cuda()# InternVL-Clogits_per_image, logits_per_text = model(image=pixel_values, text=input_ids, mode='InternVL-C')probs = logits_per_image.softmax(dim=-1)# 张量([[9.9609e -01, 5.2185e-03, 6.0070e-08],# [2.2949e-02, 9.7656e-01, 5.9903e-06],# [3.2932e-06, 7.4863e-05, 1.0000e+00]] , device='cuda:0',# dtype=torch.bfloat16, grad_fn=)# InternVL-Glogits_per_image, logits_per_text = model(image=pixel_values, text=input_ids, mode='InternVL-G')probs = logits_per_image .softmax(dim=-1)# 张量([[9.9609e-01, 3.1738e-03, 3.6322e-08],# [8.6060e-03, 9.9219e-01, 2.8759e-06],# [1.7583 e-06, 3.1233e-05, 1.0000e+00]], device='cuda:0',# dtype=torch.bfloat16, grad_fn=)# 请为 Generationtokenizer 将 add_eos_token 设置为 False.add_eos_token = Falseimage = Image.open('./examples/image1.jpg').convert('RGB')pixel_values = image_processor(images=image, return_tensors='pt').pixel_valuespixel_values = Pixel_values.to(torch.bfloat16).cuda() tokenized = tokenizer("英文字幕:", return_tensors='pt')pred = model.generate(pixel_values=pixel_values,input_ids=tokenized.input_ids.cuda(),attention_mask=tokenized.attention_mask.cuda(),num_beams=5, min_new_tokens=8,

)caption = tokenizer.decode(pred[0].cpu(),skip_special_tokens=True).strip()# 英文字幕:一只小熊猫坐在木制平台上 这里,我们以较小的OpenGVLab/InternVL2-8B为例:

导入numpy为np导入torchimport torchvision.transforms为Tfromdecord导入VideoReader,cpufromPIL导入Imagefromtorchvision.transforms.function导入InterpolationModefrom变压器导入AutoModel,AutoTokenizerIMAGENET_MEAN =(0.485,0.456,0.406)IMAGENET_STD =(0.229,0.224,0.225)def build_transform( input_size):MEAN, STD = IMAGENET_MEAN, IMAGENET_STDtransform = T.Compose([T.Lambda(lambda img: img.convert('RGB') if img.mode != 'RGB' else img),T.Resize((input_size) , input_size), 插值=InterpolationMode.BICUBIC),T.ToTensor(),T.Normalize(平均值=MEAN, std=STD)

])return transformdef find_closest_aspect_ratio(aspect_ratio, target_ratios, width, height, image_size):best_ratio_diff = float('inf')best_ratio = (1, 1)area = width * heightfor target_ratios 中的比率:target_aspect_ratio =ratio[0] /ratio[ 1]ratio_diff = abs(aspect_ratio - target_aspect_ratio)ifratio_diff < best_ratio_diff:best_ratio_diff =ratio_diffbest_ratio =ratioelifratio_diff == best_ratio_diff:if面积> 0.5 * image_size * image_size *ratio[0] *ratio[1]:best_ratio =ratioreturn best_ratiodefdynamic_preprocess( image, min_num=1, max_num=12, image_size=448, use_thumbnail=False):orig_width, orig_height = image.sizeaspect_ratio = orig_width / orig_height#计算现有图像长宽比target_ratios = set(

(i, j) for n in range(min_num, max_num + 1) for i in range(1, n + 1) for j in range(1, n + 1) ifi * j <= max_num and i * j >= min_num)target_ratios =排序(target_ratios, key=lambda x: x[0] * x[1])#找到与目标最接近的宽高比target_aspect_ratio = find_closest_aspect_ratio(aspect_ratio, target_ratios, orig_width, orig_height, image_size)#计算目标宽度and heighttarget_width = image_size * target_aspect_ratio[0]target_height = image_size * target_aspect_ratio[1]blocks = target_aspect_ratio[0] * target_aspect_ratio[1]# 调整图像大小resized_img = image.resize((target_width, target_height))processed_images = []for i in范围(块):框=(

(i % (目标宽度 // 图像大小)) * 图像大小,

(i // (目标宽度 // 图像大小)) * 图像大小,

((i % (目标宽度 // 图像大小)) + 1) * 图像大小,

((i // (target_width // image_size)) + 1) * image_size)# 分割图像 split_img = resized_img.crop(box)processed_images.append(split_img)assert