近日,Anthropic公司的AI聊天机器人Claude的用户体验引发热议。Reddit上出现大量用户反馈,称Claude的性能有所下降,具体表现为记忆力减退和编码能力下滑。这一事件引发了关于大型语言模型性能评估和用户体验的广泛讨论,也再次凸显了AI公司在维护模型稳定性方面面临的挑战。

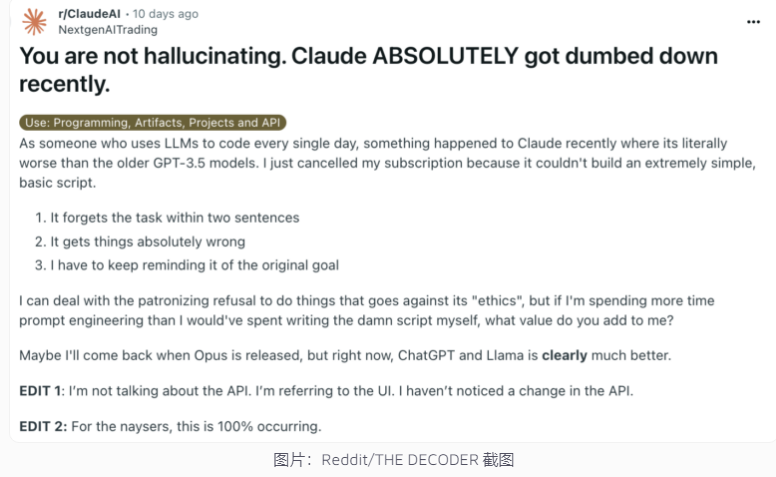

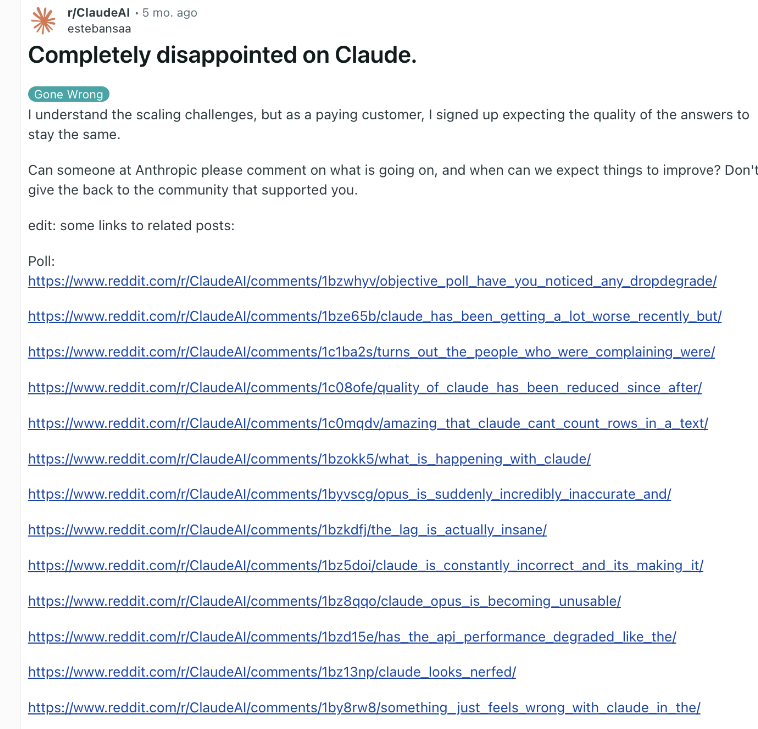

近日,Anthropic公司的AI聊天机器人Claude再次陷入性能争议。Reddit上一篇声称Claude最近变得愚蠢多了的帖子引发广泛关注,许多用户表示感受到Claude能力下降,包括记忆力减退和编码能力下滑。

对此,Anthropic高管Alex Albert回应称,公司调查未发现任何普遍问题,并确认未对Claude3.5Sonnet模型或推理管道做出更改。为提高透明度,Anthropic已在官网公布Claude模型的系统提示。

这种用户反馈AI退化而公司予以否认的模式并非首次出现。2023年末,OpenAI的ChatGPT也曾面临类似质疑。业内人士分析,造成这一现象的原因可能包括:用户期望值随时间提高、AI输出的自然变化、临时计算资源限制等。

然而,即便底层模型未发生重大变化,这些因素仍可能导致用户感知性能下降。OpenAI曾指出,AI行为本身就具有不可预测性,维护和评估大规模生成式AI性能是一项巨大挑战。

Anthropic表示将继续关注用户反馈,努力提升Claude的性能稳定性。这一事件凸显了AI公司在保持模型一致性方面所面临的挑战,以及提高AI性能评估和沟通透明度的重要性。

Claude性能争议事件反映了大型语言模型研发和部署的复杂性,以及用户预期与实际应用之间的差距。未来,AI公司需要进一步提升模型稳定性,并与用户保持更有效的沟通,以确保AI技术能够持续可靠地为用户提供服务。