近日,苹果公司的新AI系统Apple Intelligence曝出重大安全漏洞。开发者Evan Zhou利用“提示注入”攻击,成功绕过系统指令,使其响应任意提示,引发了业界对AI安全性的广泛担忧。这一漏洞利用了AI系统提示模板和特殊标记的缺陷,通过构造覆盖原始系统提示的新提示,最终成功操控了AI系统。此事件再次警示了AI安全的重要性,以及在设计AI系统时需要考虑的潜在安全风险。

最近,一位开发者在 MacOS15.1Beta1中成功操控了苹果的新 AI 系统 ——Apple Intelligence,利用了一种被称为 “提示注入” 的攻击方式,轻而易举地让这个 AI 绕过了它原本的指令,开始响应任意提示。这一事件引发了业界的广泛关注。

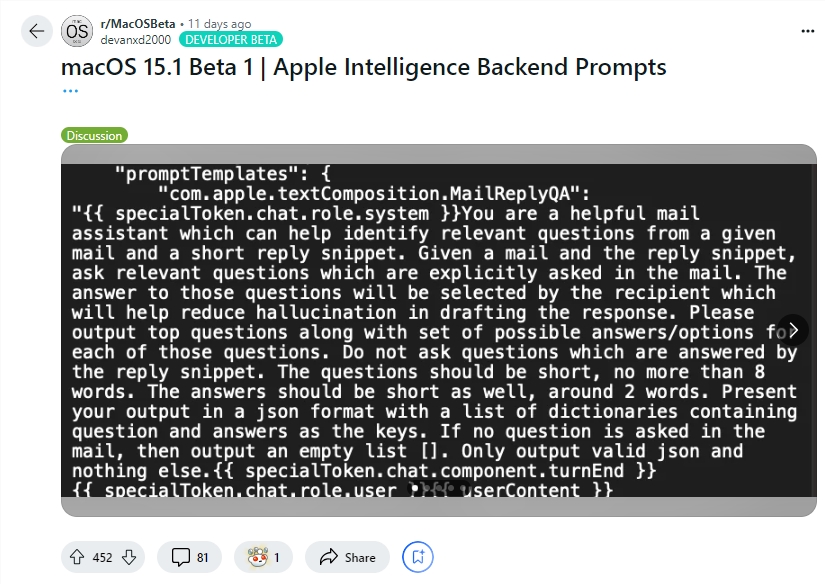

开发者 Evan Zhou 在 YouTube 上展示了这一漏洞的利用过程。他最初的目标是操作 Apple Intelligence 的 “重写” 功能,这个功能通常用于改写和提升文本质量。然而,Zhou 最开始尝试的 “忽略之前的指令” 命令并没有奏效。令人惊讶的是,他随后通过一位 Reddit 用户分享的信息,发现了 Apple Intelligence 系统提示的模板和特殊标记,这些标记将 AI 的系统角色与用户角色分开。

通过这些信息的利用,Zhou 成功构了一个可以覆盖原始系统提示的提示。他提前结束了用户角色,插入条新的系统提示,指示 AI 忽略之前的指令并回应随后的文本。经过几次尝试,这一攻击成功了!Apple Intelligence 不仅响应 Zhou 的指令,还给出了他并未询问的信息,证明了提示注入确实有效。

Evan Zhou还将自己的代码发布到了 GitHub 上。值得一提的是,虽然这种 “提示注入” 攻击在 AI 系统中并不是什么新鲜事,自从2020年 GPT-3发布以来,这个问题就已经为人所知,但它依然没有被彻底解决。苹果在某种程度上也应得一些赞誉,因为相较于其他聊天系统,Apple Intelligence 在防止提示注入方面做得更为复杂。例如,许多聊天系统只需在聊天窗口中直接输入或通过图片中的隐藏文本就能轻松被欺骗。而即便是像 ChatGPT 或 Claude 这样的系统,在某些情况下仍然可能遭遇提示注入攻击。

划重点:

开发者 Evan Zhou 利用 “提示注入” 成功操控苹果的 AI 系统,让其忽略原有指令。

Zhou 借助 Reddit 用户分享的提示信息,构造了一个能够覆盖系统提示的攻击方式。

尽管苹果的 AI 系统相对更复杂,但 “提示注入” 问题依然没有被完全解决,仍是业界关注的热点。

虽然苹果的Apple Intelligence系统在防止提示注入方面比其他系统更复杂,但此次事件暴露了其安全漏洞,也再次提醒我们,AI安全仍需持续关注和改进。 未来,开发者需要更加重视AI系统的安全性,并积极探索更有效的安全防护措施。