Meta首席执行官马克·扎克伯格在SIGGRAPH大会上发布了Segment Anything 2 (SA2),这是其图像分割模型的重大升级,将AI驱动的分割技术拓展至视频领域。SA2的开源策略,正如扎克伯格所言,旨在构建一个围绕该技术的强大生态系统,从而提升模型本身以及Meta其他产品的质量。这体现了Meta在开放AI领域的持续投入和对行业发展的贡献。

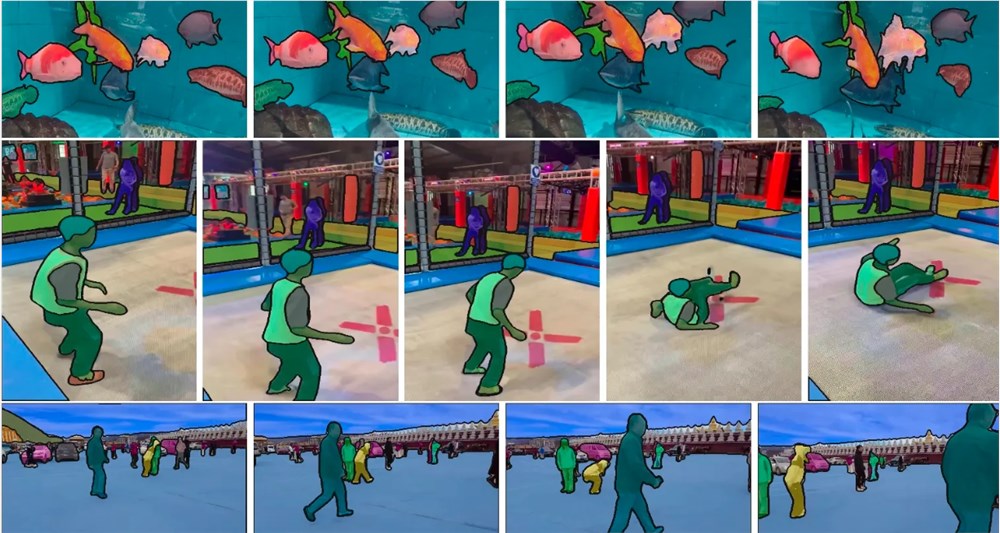

在本周举行的SIGGRAPH大会上,Meta首席执行官马克·扎克伯格首次展示了Segment Anything2(SA2),这是该公司去年推出的突破性图像分割模型的升级版本。新模型将AI驱动的分割技术扩展到了视频领域,展示了该技术在过去一年中取得的惊人进展。

扎克伯格在谈话中解释了Meta坚持开源策略的原因:这不仅仅是一个你可以构建的软件——你需要一个围绕它的生态系统。如果我们不开源它,它几乎就不会那么好用。他坦言,这一策略不仅有利于整个生态系统,也有助于提升Meta自身产品的质量。

SA2的发布再次彰显了Meta在开放AI领域的领导地位。尽管其开放性程度仍存在争议,但像LLaMa、Segment Anything等模型已成为AI性能的重要参考标准。

随着SA2的推出,AI视频分析技术将在科研、环境监测等诸多领域发挥更大作用。这一进展不仅展示了AI技术的快速发展,也为未来的应用开辟了新的可能性。

SA2的发布标志着AI视频分析技术的新里程碑,其开源策略也为AI社区的共同发展提供了有力支持。未来,我们可以期待SA2在更多领域展现其强大的应用潜力,推动人工智能技术的持续进步。