谷歌近日重磅发布第六代人工智能加速器芯片Trillium,其性能提升和能效优化令人瞩目。 Trillium芯片在Gemini 2.0 AI模型训练中展现出卓越实力,训练性能是前代产品的四倍,同时能耗大幅降低,每美元训练性能提升2.5倍,这将深刻改变人工智能发展的经济学,并推动机器学习领域迈向新的高度。谷歌已将超过10万颗Trillium芯片连接到单一网络中,构建了全球最强大的AI超级计算机之一,其在AI基础设施领域的综合整合能力令人印象深刻。

谷歌近日发布了其第六代人工智能加速器芯片Trillium,声称这一突破性的技术进步将可能从根本上改变人工智能发展的经济学,并推动机器学习的边界。 Trillium 芯片在谷歌新发布的Gemini2.0AI 模型的训练过程中展现了显着的性能提升,其训练性能是前一代产品的四倍,同时能耗大幅降低。

谷歌首席执行官桑达尔・皮查伊在发布会上强调,Trillium 芯片是公司AI 战略的核心,Gemini2.0的训练和推理均完全依赖于这一芯片。谷歌已经在单一网络中连接了超过10万颗Trillium 芯片,构建了全球最强大的AI 超级计算机之一。

Trillium 芯片的技术规格在多个维度上取得了显着进步。与其前代产品相比,Trillium 在单颗芯片的峰值计算性能上提高了4.7倍,同时高带宽内存容量和芯片间连接带宽均实现了翻倍。更重要的是,芯片的能效提升了67%,这是在数据中心面临巨大的能耗压力下,尤其重要的指标。

在经济层面,Trillium 的表现也颇具影响力。谷歌表示,与前一代芯片相比,Trillium 在训练性能上的每美元投入提升了2.5倍,可能会重塑AI 开发的经济模型。 AI21Labs 作为Trillium 的早期用户,已经报告了显着的提升。该公司的首席技术官巴拉克・伦茨表示,规模、速度和成本效益方面的进展都十分显着。

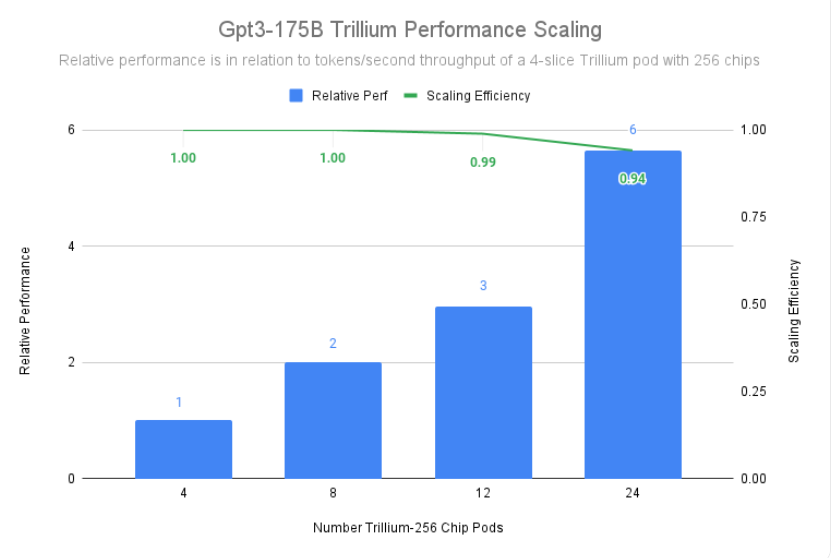

谷歌在AI 超级计算机架构中部署Trillium,展示了其对AI 基础设施的综合整合方法。这一系统结合了超过10万颗Trillium 芯片和每秒13拍比特的Jupiter 网络,能够支持单个分布式训练任务在数十万个加速器之间的扩展。

Trillium 的发布将进一步加剧AI 硬件领域的竞争,尤其是在Nvidia 主导的市场中。尽管Nvidia 的GPU 仍是许多AI 应用的行业标准,但谷歌的定制芯片方案在特定工作负载中可能具备优势。行业分析师指出,谷歌在定制芯片开发上的巨大投资,体现了其对AI 基础设施日益重要性的战略判断。

随着技术的不断进步,Trillium 不仅仅意味着性能的提升,还预示着AI 计算将变得更加普及和经济。谷歌表示,拥有合适的硬件和软件基础设施将是推动AI 持续进步的关键。未来,随着AI 模型日益复杂,基础硬件的需求将不断增加,谷歌显然意图在这一领域保持领先地位。

官方博客:https://cloud.google.com/blog/products/compute/trillium-tpu-is-ga

Trillium芯片的发布,标志着谷歌在AI硬件领域的重大突破,其在性能、能效和经济效益上的显着提升,将对人工智能产业产生深远影响,并预示着未来AI计算将更加普及和经济高效。这不仅是谷歌在AI领域的又一次领先,更代表着整个行业技术进步的方向。