Meta公司近日发布了名为Meta3D Gen (3DGen) 的全新文本生成3D模型技术,该技术能够快速高效地创建高质量的3D模型,并具有逼真的纹理和材质。这项突破性的技术结合了Meta3D AssetGen和Meta3D TextureGen两大核心组件,显着提升了3D模型生成的效率和质量,为用户带来了前所未有的体验。 3DGen在速度和质量上均超越了现有解决方案,为游戏开发、虚拟现实以及元宇宙等领域带来了新的可能性。

近日,研究人员发布了一项名为Meta3D Gen(3D Gen)的全新、快速的文本生成3D 模型的技术,3D Gen 通过高效的方式创建3D 模型,具有高质量的纹理和材质,为用户带来了全新的体验。

这一新系统结合了两个关键部分:Meta 3D AssetGen 用于创建3D 网格,Meta 3D TextureGen 用于生成纹理。这些技术共同作用,产生了具有高分辨率纹理和基于物理的渲染(PBR)材质的3D 资产。据Meta 称,该过程比现有解决方案快三到十倍。

Meta3D AssetGen

其中,Meta3D AssetGen(AssetGen)是一项在文本生成3D 领域的重大突破,可实现高质量3D资产生成,仅需不到1分钟。 AssetGen 生成了基于物理渲染(PBR)材质,实现真实光照效果强大的文本到3D和文本到纹理生成能力。

AssetGen 首先生成对象的几个视图,包括阴影和反射通道的外观信息,然后在3D 空间中重建颜色、金属度和粗糙度,使用延迟着色损失进行高效监督。它还使用符号距离函数更可靠地表示3D 形状,并引入相应的损失进行直接形状监督。为了提高内存效率,该方法使用了融合的卷积核。在提取网格后,一种在UV 空间中进行纹理细化的变换器显着提高了纹理的清晰度和细节。

与最佳竞争方法相比,AssetGen 在Chamfer Distance 方面的改进达到了17%,在LPIPS 方面的改进达到了40%;同时,在与同等速度的最佳行业竞争者的人类偏好测试中,获得了72% 的青睐。

Meta3D TextureGen

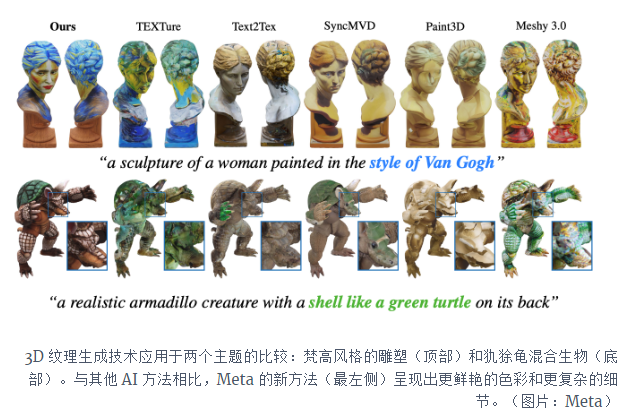

研究人员还推出了Meta3D TextureGen,这是一种新的前向方法,由两个连续网络组成,旨在在不到20秒的时间内为任意复杂程度的几何体生成高质量和全局一致的纹理。

该方法通过在2D 空间中将文本生成图像模型与3D 语义条件结合,并将它们融合成完整且高分辨率的UV 纹理映射,实现了质量和速度方面的最新成果。

研究人员还引入了一种纹理增强网络,能够按任意比例放大任何纹理,生成4K 像素分辨率的纹理。

官方博客:https://ai.meta.com/research/publications/meta-3d-gen/

划重点:

-Meta 3D Gen 系统可以在不到一分钟内创建高质量的3D 资产

- Meta3D Gen 集成了Meta3D AssetGen和Meta3DTextureGen两大核心技术。

- AssetGen 支持生成基于物理渲染的材质,具有真实的再光照效果。

- Meta3D TextureGen 是一种快速生成高质量纹理的方法,可适用于任意复杂度的几何体。

Meta3D Gen的出现,标志着文本生成3D模型技术取得了重大进展,其高效性、高品质以及易用性将极大地推动3D内容创作领域的发展,为各行各业带来无限可能。未来,我们可以期待Meta3D Gen在更多领域的应用和进一步的优化。