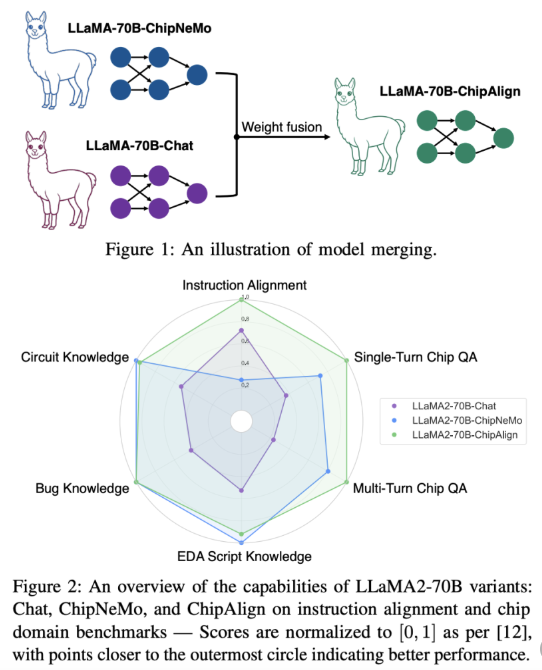

大型语言模型(LLM)在各个领域展现出巨大的潜力,但在专业领域,如芯片设计,其应用仍面临挑战。 NVIDIA 推出的ChipAlign 是一种创新的解决方案,它巧妙地结合了通用指令对齐的LLM 和芯片特定LLM 的优势,有效提升了模型在芯片设计领域的性能。 ChipAlign 采用独特的模型合并策略,无需额外训练,即可实现两种模型能力的融合,显着降低了计算资源需求。

在当今科技迅速发展的背景下,大型语言模型(LLM)在多个行业中扮演着重要角色,帮助自动化任务和提升决策效率。然而,在芯片设计等专业领域,这些模型面临着独特的挑战。 NVIDIA 最近推出的ChipAlign 正是为了应对这些挑战而设计,旨在将通用指令对齐的LLM 与芯片特定的LLM 的优势相结合。

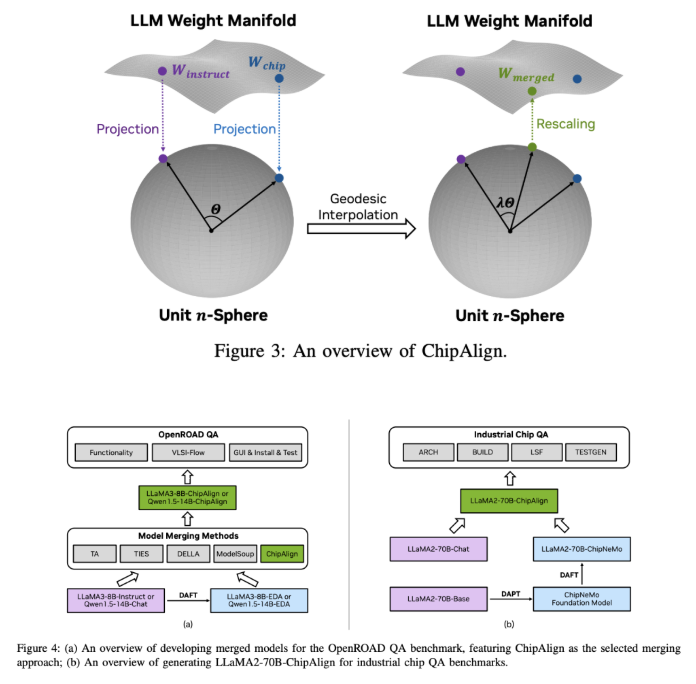

ChipAlign 采用了一种新的模型合并策略,这一策略无需进行繁琐的训练过程,借助几何空间中的测地线插值方法,能够顺畅地将两种模型的能力融合在一起。与传统的多任务学习方式相比,ChipAlign 直接将预训练的模型结合,避免了对大量数据集和计算资源的需求,从而有效保留了两种模型的优点。

具体而言,ChipAlign 通过一系列精心设计的步骤来实现效果。首先,它将芯片特定和指令对齐的LLM 的权重投影到一个单位n 球面上,接着沿着最短路径进行测地线插值,最后对融合后的权重进行重新缩放,以确保其原有特性得以保持。这一创新方法带来了显着的提升,包括在指令跟随基准测试中提升了26.6% 的表现。

在实际应用中,ChipAlign 在多个基准测试中展现了其出色的性能。在IFEval 基准测试中,它实现了26.6% 的指令对齐提升;在OpenROAD QA 基准测试中,较其他模型合并技术,ChipAlign 的ROUGE-L 分数提高了6.4%。此外,在工业芯片质量保证(QA)中,ChipAlign 也以8.25% 的优势超越了基线模型,表现出色。

NVIDIA 的ChipAlign 不仅解决了芯片设计领域的痛点,还展示了如何通过创新的技术手段来缩小大型语言模型能力的差距。该技术的应用不仅限于芯片设计,未来有望推动更多专业领域的进步,展现出可适应且高效的AI 解决方案的巨大潜力。

划重点:

**ChipAlign 的创新合并策略**:NVIDIA 推出的ChipAlign 通过无训练的模型合并策略,成功结合了通用和专业领域的LLM 优势。

** 显着的性能提升**:在指令跟随和领域特定任务中,ChipAlign 分别实现了26.6% 和6.4% 的性能提升。

** 广泛的应用潜力**:这一技术不仅解决了芯片设计中的挑战,还有望应用于其他专业领域,推动AI 技术的进步。

总而言之,NVIDIA 的ChipAlign 为大型语言模型在专业领域的应用提供了新的方向,其高效的模型合并策略和显着的性能提升,预示着AI技术在更多专业领域应用的广阔前景,值得期待其未来发展。