你是否好奇ChatGPT、文心一言等AI是如何工作的?它们都基于大型语言模型(LLM)。本文将用简单易懂的方式,即使你只有小学二年级的数学水平,也能理解LLM的运行原理。我们将从神经网络的基本概念出发,逐步讲解文字数字化、模型训练、进阶技巧以及GPT和Transformer架构等核心技术,带你揭开LLM的神秘面纱。

神经网络:数字的魔法

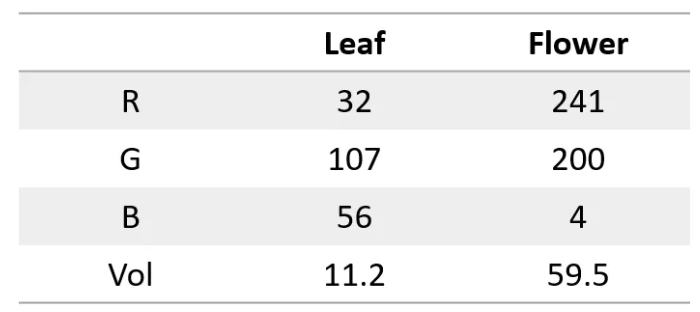

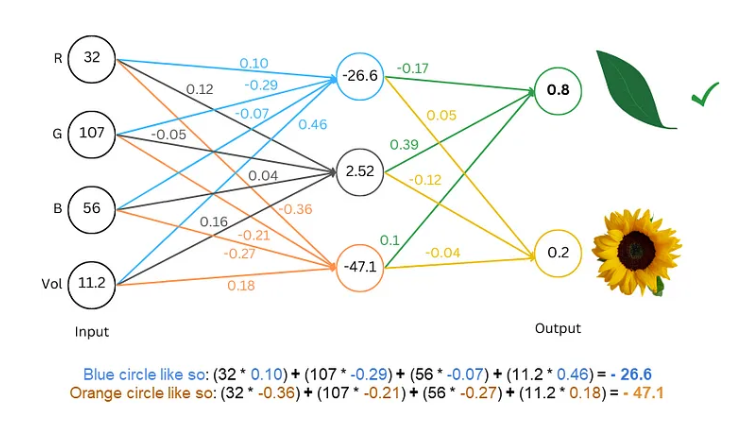

首先,我们要知道,神经网络就像一个超级计算器,它只能处理数字。无论是输入还是输出,都必须是数字。那我们要怎么让它理解文字呢?

秘诀就在于把文字转化成数字! 比如,我们可以把每个字母用一个数字代表,比如a=1,b=2,以此类推。这样一来,神经网络就能“读懂”文字了。

训练模型:让网络“学会”语言

有了数字化的文字,接下来就要训练模型,让神经网络“学会”语言的规律。

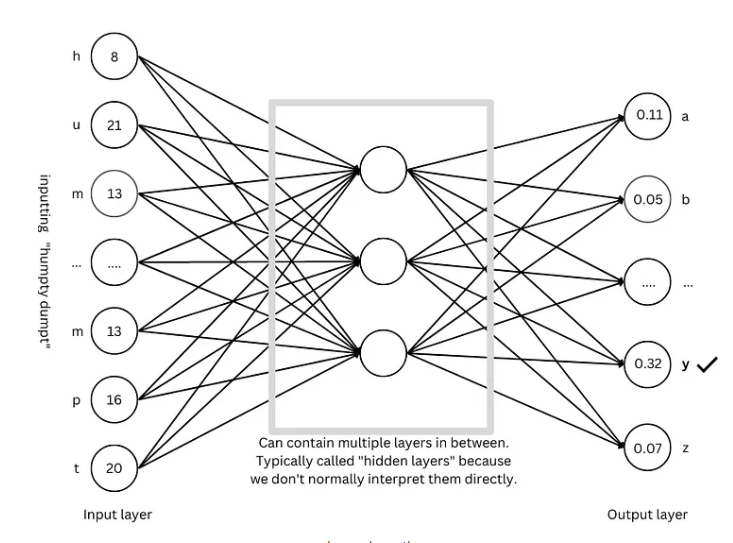

训练的过程就像玩猜谜游戏。 我们给网络看一些文字,比如“Humpty Dumpty”,然后让它猜下一个字母是什么。如果它猜对了,我们就给它奖励;如果猜错了,就给它惩罚。通过不断地猜谜和调整,网络就能越来越准确地预测下一个字母,最终生成完整的句子,比如“Humpty Dumpty sat on a wall”。

进阶技巧:让模型更“聪明”

为了让模型更“聪明”,研究人员发明了许多进阶技巧,比如:

词嵌入: 我们不再用简单的数字代表字母,而是用一组数字(向量)来代表每个词,这样可以更全面地描述词语的含义。

子词分词器: 把单词拆分成更小的单位(子词),比如把“cats”拆成“cat”和“s”,这样可以减少词汇量,提高效率。

自注意力机制: 模型在预测下一个词时,会根据上下文中的所有词语来调整预测的权重,就像我们在阅读时会根据上下文理解词义一样。

残差连接: 为了避免网络层数过多导致训练困难,研究人员发明了残差连接,让网络更容易学习。

多头注意力机制: 通过并行运行多个注意力机制,模型可以从不同的角度理解上下文,提高预测的准确性。

位置编码: 为了让模型理解词语的顺序,研究人员会在词嵌入中加入位置信息,就像我们在阅读时会注意词语的顺序一样。

GPT 架构:大型语言模型的“蓝图”

GPT 架构是目前最流行的大型语言模型架构之一,它就像一个“蓝图”,指引着模型的设计和训练。GPT 架构巧妙地组合了上述的各种进阶技巧,让模型能够高效地学习和生成语言。

Transformer 架构:语言模型的“革命”

Transformer 架构是近年来语言模型领域的一项重大突破,它不仅提高了预测的准确性,还降低了训练的难度,为大型语言模型的发展奠定了基础。GPT 架构也是基于 Transformer 架构演变而来的。

参考资料:https://towardsdatascience.com/understanding-llms-from-scratch-using-middle-school-math-e602d27ec876

通过本文的讲解,相信你对大型语言模型已经有了一个初步的了解。虽然LLM的内部机制非常复杂,但其核心原理并不神秘,希望本文能帮助你更好地理解这项令人惊叹的技术。