字节跳动重磅推出全新豆包大模型1.5Pro,在多个基准测试中超越GPT-4o和Claude3.5Sonnet,标志着其在人工智能领域的显着进步。该模型采用创新的稀疏MoE架构,以更少的激活参数实现了与7倍参数Dense模型相当的性能,效率提升约3倍。除了核心模型升级外,还同步发布了豆包视觉理解模型和实时语音模型,进一步增强了多模态处理能力和语音交互体验。

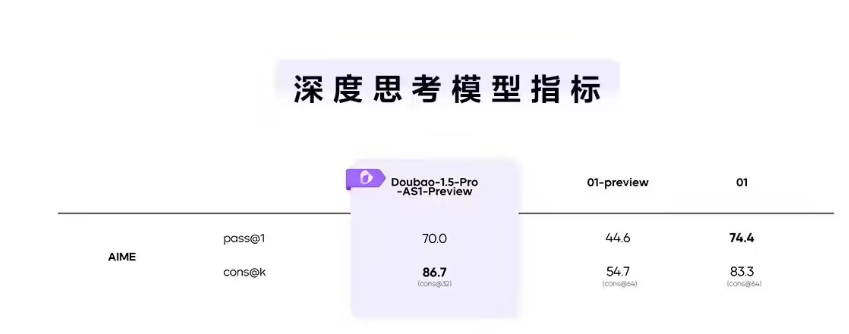

字节跳动正式推出其最新的豆包大模型1.5Pro(Doubao-1.5-pro),这一新模型在多个领域的综合能力上表现出色,成功超越了行业内知名的GPT-4o 和Claude3.5Sonnet 。该模型的发布标志着字节跳动在人工智能领域又向前迈出了重要一步。

豆包1.5Pro 采用了新型的稀疏MoE(混合专家)架构,使用较小的激活参数进行预训练。这种设计的创新之处在于其可以提供等效于7倍激活参数的Dense 模型性能,使其在效率上远超行业常规的MoE 架构,带来了约3倍的效率提升。这样的设计使得豆包大模型在知识、代码、推理和中文等多个测评基准上的得分更加出色。

除了主要模型的升级,字节跳动还同时发布了豆包视觉理解模型Doubao-1.5-vision-pro 和豆包实时语音模型Doubao-1.5-realtime-voice-pro。新款视觉理解模型在多模态数据处理、动态分辨率和细粒度信息理解等方面进行了全面技术升级,进一步提升了其在视觉推理和文本理解方面的能力。同时,实时语音模型的推出使得豆包App 能够实现更加流畅的语音对话体验,具备低延迟和对话中随时打断的能力。

字节跳动官方表示,豆包大模型在训练过程中未使用任何外部模型生成的数据,确保了模型的独立性与可靠性。此外,所有新产品的定价将保持不变,用户可在豆包App 中直接体验新功能。

这次发布会不仅展示了字节跳动在AI 领域的持续创新能力,也为开发者提供了强大的API 支持,进一步推动了人工智能技术的普及与应用。

豆包大模型1.5Pro的推出,以及配套的视觉和语音模型,展现了字节跳动在AI领域的雄厚实力和技术创新。其高效率、高性能以及对用户体验的重视,预示着未来AI应用将更加便捷和强大。