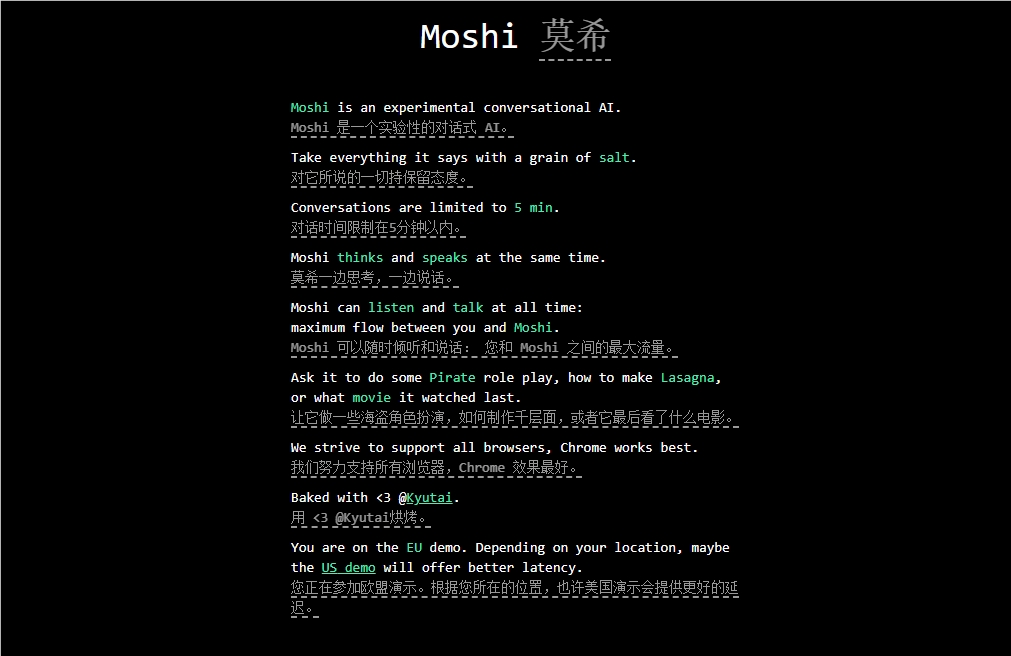

法国独立非盈利AI研究实验室Kyutai近日发布了一款名为Moshi的语音助理,这款产品标志着实时本机多模态基础模型技术的一次重大突破。作为一款革命性的AI模型,Moshi在某些核心功能上不仅模仿了OpenAI的GPT-4o,更实现了显着的超越,为语音交互技术开辟了新的发展方向。

产品入口:https://top.aibase.com/tool/moshi-chat

Moshi最引人注目的特点在于其卓越的情感理解与表达能力。这款语音助理能够以多种口音进行自然对话,其中包括法语在内的多种语言变体。更令人惊叹的是,Moshi可以同时处理音频输入和语音输出,在保持文本思维流畅传达的同时,展现出70种不同的人类情绪和说话风格,极大地提升了人机交互的自然度和亲和力。

在技术实现方面,Moshi采用了独特的双音频流处理机制,使其能够实现真正的实时互动。这一突破性功能得益于Kyutai开发的70亿参数语言模型Helium的强力支持,通过混合文本和音频的联合预训练,Moshi在语音交互的流畅性和准确性上都达到了新的高度。

为了确保Moshi的语音质量和使用体验,Kyutai团队进行了严格的微调过程。通过文本转语音(TTS)技术,团队转换了10万个"口语风格"的合成对话,并利用另一个TTS模型生成的合成数据进行训练。这些努力最终使Moshi实现了令人惊叹的200毫秒端到端延迟时间,为用户提供了近乎即时的响应体验。

考虑到不同用户的需求,Kyutai还开发了Moshi的轻量化版本。这个优化后的版本可以在MacBook或消费者级GPU上流畅运行,大大降低了使用门槛,使更广泛的用户群体能够体验到这一先进的语音交互技术。

作为Kyutai实验室的最新成果,Moshi不仅展示了AI语音技术的巨大潜力,更为未来的人机交互方式提供了新的可能性。从情感理解到多语言支持,从实时交互到轻量化部署,Moshi的每一个特性都体现了Kyutai在AI研究领域的创新精神和技术实力。