中文 | English

CodeFuse-ChatBot: Development by Private Knowledge Augmentation

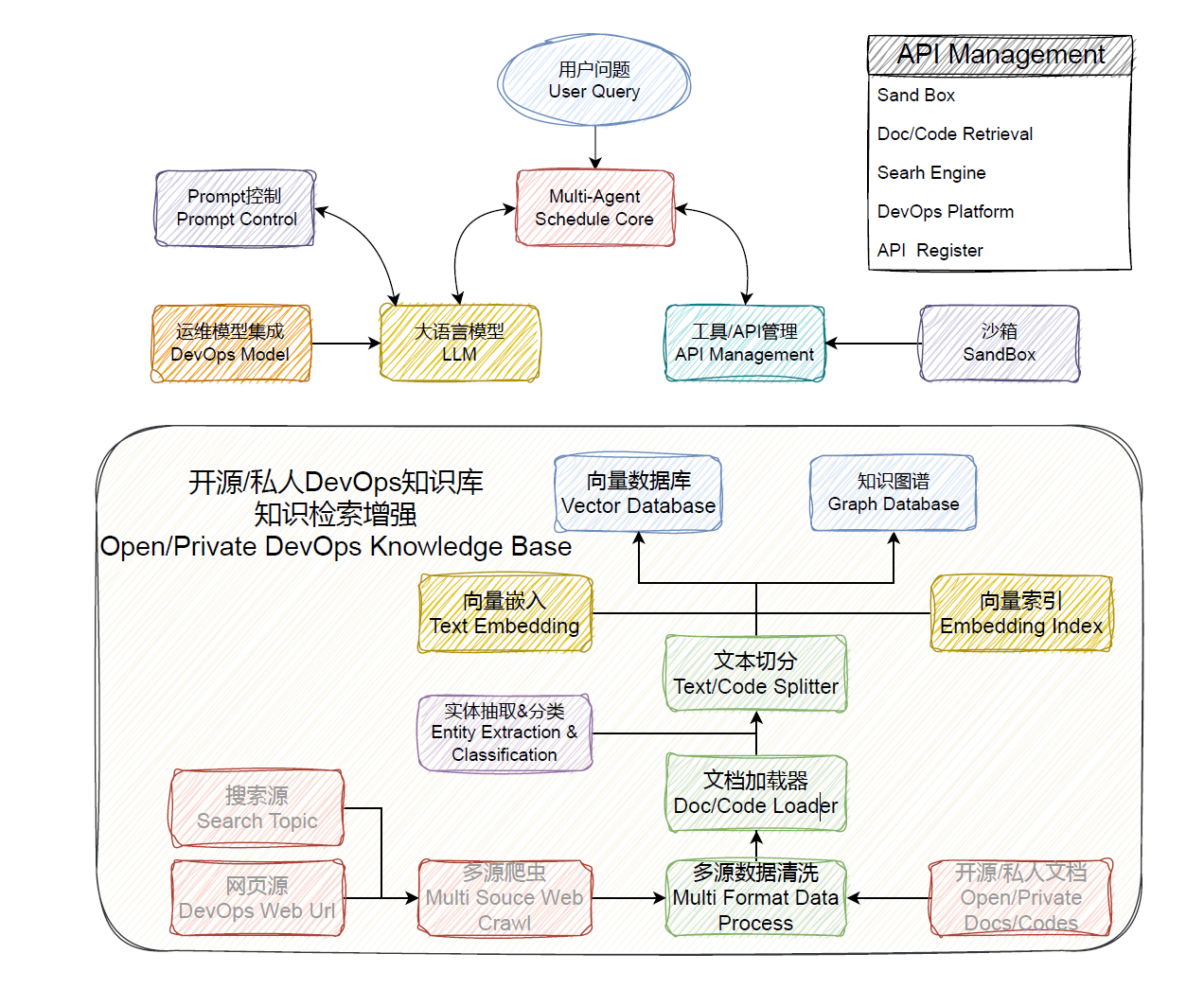

CodeFuse-ChatBot是由螞蟻CodeFuse團隊開發的開源AI智慧助手,致力於簡化和優化軟體開發生命週期中的各個環節。該專案結合了Multi-Agent的協同調度機制,並整合了豐富的工具庫、程式碼庫、知識庫和沙盒環境,使得LLM模型能夠在DevOps領域內有效執行和處理複雜任務。

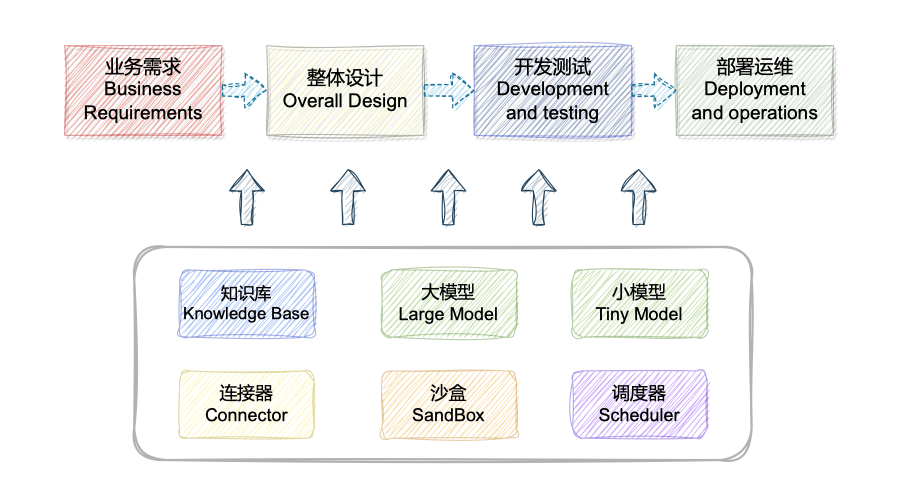

本專案旨在透過檢索增強生成(Retrieval Augmented Generation,RAG)、工具學習(Tool Learning)和沙盒環境來建立軟體開發全生命週期的AI智慧助手,涵蓋設計、編碼、測試、部署和維運等階段。 逐漸從各處資料查詢、獨立分散平台操作的傳統開發維運模式轉變到大模型問答的智慧化開發維運模式,改變人們的開發維運習慣。

本專案核心差異技術、功能點:

? 依託於開源的LLM 與Embedding 模型,本專案可實現基於開源模型的離線私有部署。此外,本專案也支援OpenAI API 的呼叫。接入Demo

核心研發團隊長期專注於AIOps + NLP 領域的研究。我們發起了Codefuse-ai 項目,希望大家廣泛貢獻高品質的開發和維運文檔,共同完善這套解決方案,以實現「讓天下沒有難做的開發」的目標。

為了幫助您更直觀地了解Codefuse-ChatBot 的功能和使用方法,我們錄製了一系列示範影片。您可以透過觀看這些視頻,快速了解本項目的主要特性和操作流程。

具體實現明細見:技術路線明細專案計畫跟進見:Projects

如果您需要整合特定的模型,請透過提交issue來告知我們您的需求。

| model_name | model_size | gpu_memory | quantize | HFhub | ModelScope |

|---|---|---|---|---|---|

| chatgpt | - | - | - | - | - |

| codellama-34b-int4 | 34b | 20g | int4 | coming soon | link |

完整文件請見:CodeFuse-muAgent

pip install codefuse-muagent

請自行安裝nvidia 驅動程序,本專案已在Python 3.9.18,CUDA 11.7 環境下,Windows、X86 架構的macOS 系統中完成測試。

Docker安裝、民營化LLM接入及相關啟動問題請見:快速使用明細

對於Apple Silicon(蘋果M系列晶片),您可能需要先通過brew install qpdf。

1、python 環境準備

# 准备 conda 环境

conda create --name devopsgpt python=3.9

conda activate devopsgpt cd codefuse-chatbot

# python=3.9,notebook用最新即可,python=3.8用notebook=6.5.6

pip install -r requirements.txt2、啟動服務

# 完成server_config.py配置后,可一键启动

cd examples

bash start.sh

# 开始在页面进行相关配置,然后打开`启动对话服务`即可

或透過start.py進行啟動舊版啟動方式更多LLM接入方法見更多細節...

非常感謝您對Codefuse 專案感興趣,我們非常歡迎您對Codefuse 專案的各種建議、意見(包括批評)、評論和貢獻。

您對Codefuse 的各種建議、意見、評論可以直接透過GitHub 的Issues 提出。

參與Codefuse 專案並為其貢獻的方法有很多:程式碼實作、測試編寫、流程工具改進、文件完善等等。任何貢獻我們都會非常歡迎,並將您加入貢獻者名單。詳見Contribution Guide...

本專案基於langchain-chatchat和codebox-api,在此深深感謝他們的開源貢獻!