微軟近期推出的螢幕內容解析工具OmniParser,本週躍居人工科技開源平台HuggingFace最受歡迎模式榜首。根據HuggingFace聯合創辦人兼執行長Clem Delangue表示,這是該領域首個獲此殊榮的解析工具。

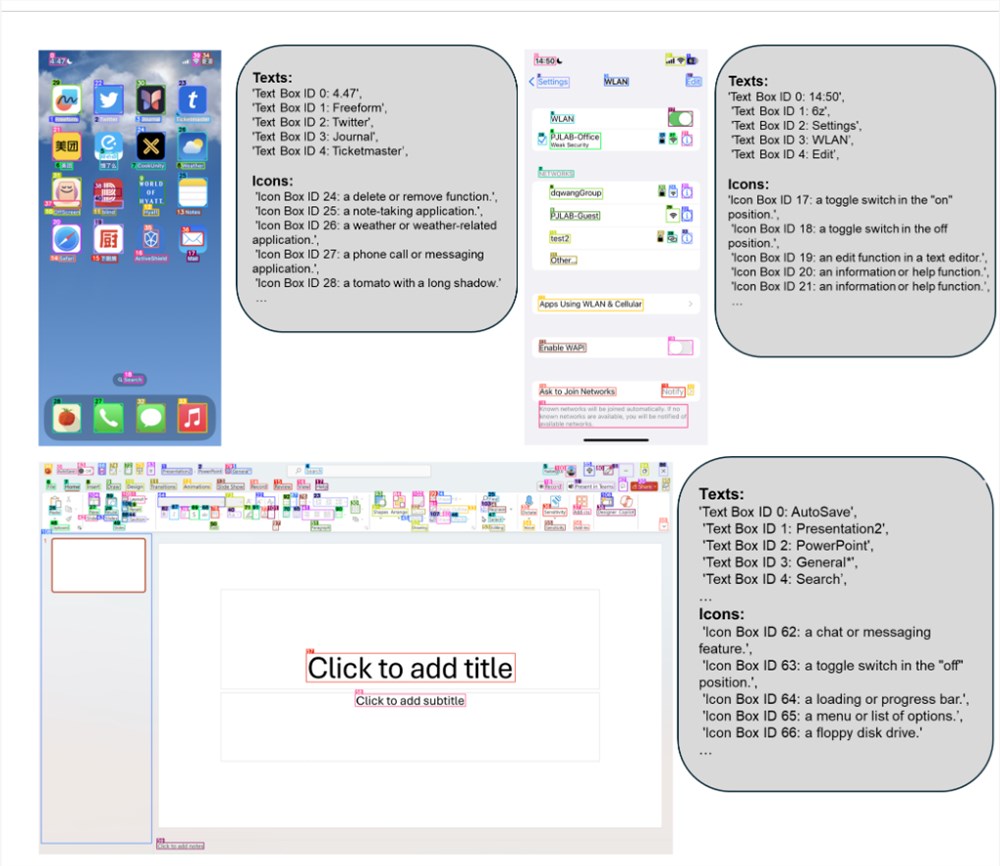

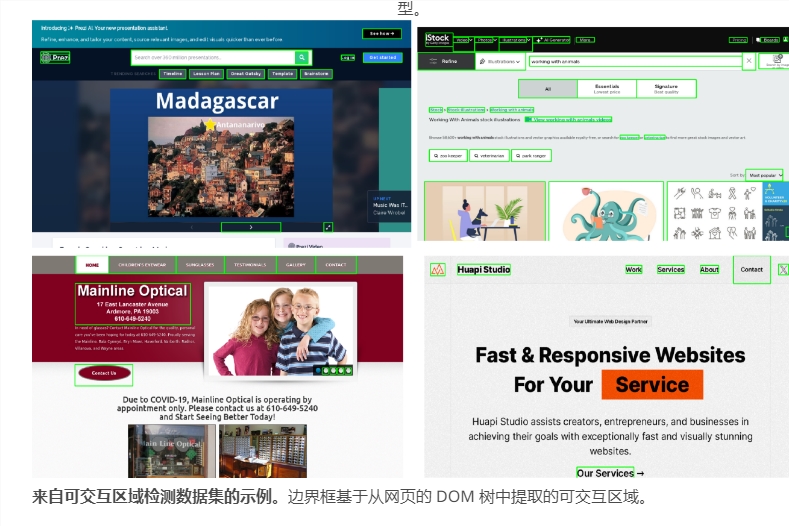

OmniParser主要用於將螢幕截圖轉換為結構化數據,幫助其他系統更好地理解和處理圖形使用者介面。該工具採用多模型協同工作方式:YOLOv8負責檢測可交互元素位置,BLIP-2分析元素用途,同時配備光學字符識別模組提取文本信息,最終實現對界面的全面解析。

這款開源工具具有廣泛的兼容性,可支援多種主流視覺模型。微軟合作夥伴研究經理Ahmed Awadallah強調,開放合作對推動科技發展至關重要,OmniParser正是實踐此理念的產物。

目前,科技巨頭紛紛佈局螢幕互動領域。 Anthropic發布了名為Computer Use的閉源解決方案,蘋果則推出了針對行動介面的Ferret-UI。相較之下,OmniParser憑藉其跨平台通用性,展現出獨特優勢。

不過,OmniParser仍面臨一些技術挑戰,例如重複圖示辨識和文字重疊場景下的精確定位等問題。但開源社群普遍認為,隨著更多開發者參與改進,這些問題有望得到解決。

OmniParser的快速走紅,顯示出開發者對通用型螢幕互動工具的迫切需求,也預示著這一領域可能迎來快速發展。

網址:https://microsoft.github.io/OmniParser/