Downcodes小編為您帶來最新科技資訊!西雅圖新創公司Moondream推出了令人驚豔的緊湊型視覺語言模型moondream2,它以其小巧的體積和強大的性能在業界掀起波瀾。這款開源模型在各項基準測試中表現出色,甚至在某些方面超越了參數量更大的競爭對手,為智慧型手機上的本地影像辨識帶來了新的可能性。讓我們一起深入了解moondream2的獨特之處及其背後的技術創新。

最近,西雅圖的一家新創公司Moondream 推出了名為moondream2的緊湊型視覺語言模型。儘管體積小巧,但該模型在各項基準測試中表現出色,備受關注。作為一個開源模型,moondream2有望在智慧型手機上實現本地影像辨識功能。

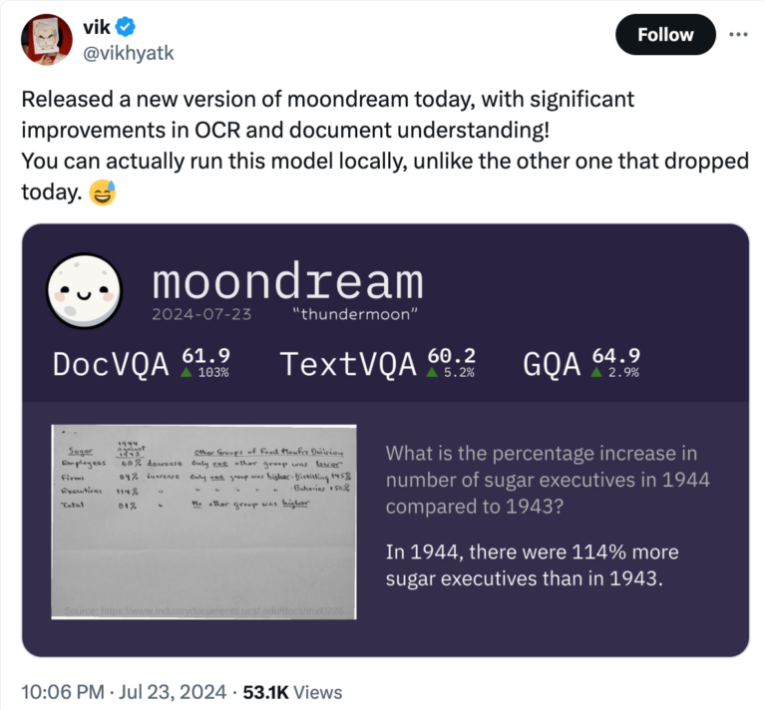

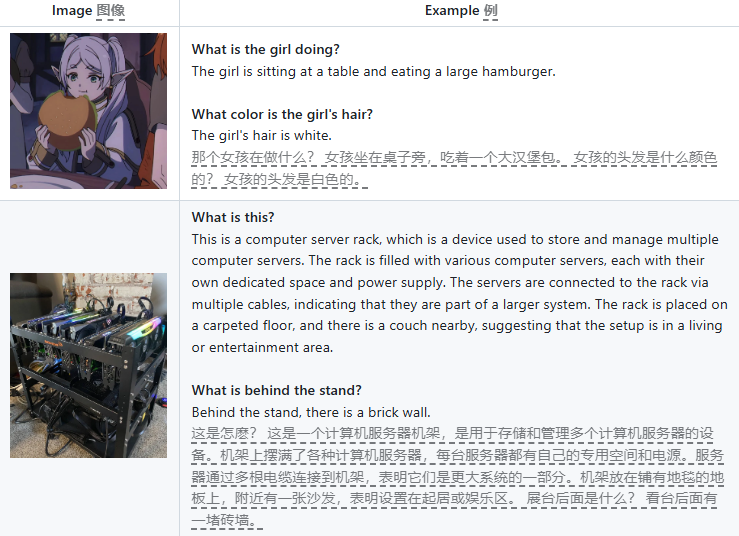

moondream2於三月正式發布,該模型能夠處理文字和圖像輸入,具備回答問題、文字擷取(OCR)、物件計數和物品分類等能力。自發布以來,Moondream 團隊持續更新該模型,不斷提升其基準效能。 7月份的版本在OCR 和文件理解方面顯示出顯著進步,尤其是在對歷史經濟數據的分析中表現出色。該模型在DocVQA、TextVQA 和GQA 的得分均超過60%,顯示其在本地執行時的強大能力。

moondream2的一個顯著特點是其緊湊的尺寸:僅有16億個參數,這使得它不僅能夠在雲端伺服器上運行,也可以在本地電腦甚至一些效能較低的裝置如智慧型手機或單板電腦上運行。

儘管體積小,但其性能卻與一些參數量達數十億的競爭模型相當,甚至在某些基準測試中表現優於這些較大模型。

在對行動裝置視覺語言模型的比較中,研究人員指出,儘管moondream2的參數量僅為1.7億,但其表現與7億參數的模型相當,僅在SQA 資料集的表現稍遜一籌。這表明,儘管小型模型表現出色,但在理解特定上下文方面仍面臨挑戰。

該模型的開發者Vikhyat Korrapati 表示,moondream2是基於其他模型如SigLIP、微軟的Phi-1.5和LLaVA 訓練資料集所建構的。該開源模型現已在GitHub 上免費提供下載,並在Hugging Face 上展示了其演示版本。在編碼平台上,moondream2也引起了開發者社群的廣泛關注,獲得了超過5000個星級評價。

這次成功吸引了投資者的目光:在由Felicis Ventures、微軟的M12GitHub 基金和Ascend 領投的種子輪融資中,Moondream 成功籌集了450萬美元。該公司的CEO Jay Allen 曾在亞馬遜網路服務(AWS)工作多年,並領導這家不斷發展的新創公司。

moondream2的推出標誌著一系列經過專業優化的開源模型的誕生,這些模型在提供與更大、更舊模型相似的性能時,所需的資源更少。目前市場上雖然已有一些小型的本地模型,例如蘋果的智慧助理和Google的Gemini Nano,但這兩家廠商仍將更複雜的任務外包給雲端解決。

huggingface:https://huggingface.co/vikhyatk/moondream2

github:https://github.com/vikhyat/moondream

moondream2的出現,預示著輕量級AI模型的蓬勃發展,為本地化AI應用提供了新的可能性。其開源特性也促進了開發者社群的積極參與,為AI技術的發展注入了新的活力。未來,我們期待更多類似的創新成果湧現!