隨著人工智慧生成內容的爆炸性成長,社群媒體平檯面臨前所未有的挑戰:如何確保用戶能夠辨別真偽訊息? Instagram負責人亞當·莫塞里近期在Threads上發表了一系列帖子,表達了他對AI生成內容的擔憂,並闡述了Instagram和Meta應對這一挑戰的策略。他強調使用者需要提高警惕,學會辨識AI生成內容,並呼籲平台加強內容監管,提升訊息的透明度和可信度。

在最近的一系列Threads 貼文中,Instagram 的負責人亞當・莫塞里(Adam Mosseri)強調了社群媒體用戶在面對日益增長的AI 生成內容時應提高警惕。

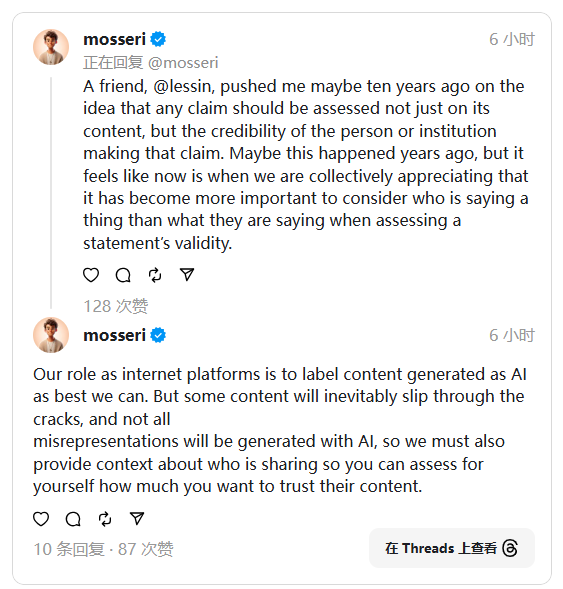

他指出,使用者在網路上看到的圖像和資訊可能並不真實,因為AI 技術已經能夠產生與現實極為相似的內容。為了幫助使用者更好地判斷資訊的真實性,莫塞里提到,使用者應該考慮內容的來源,而社群平台也有責任對此提供支援。

莫塞里表示,社群媒體平台的角色是盡可能為產生的AI 內容貼上標籤,幫助用戶辨識。然而,他也承認,有些內容可能會被遺漏,無法及時標註。為此,他強調,平台還需提供有關分享內容的用戶背景信息,以便用戶能夠更好地決定對這些內容的信任程度。他的觀點反映了對社群媒體訊息可信度的深刻擔憂。

在現階段,Meta(Instagram 的母公司)尚未提供足夠的上下文資訊來幫助用戶判斷內容的真實性。儘管如此,該公司最近暗示,可能會對其內容規則進行重大調整。這項改變有望提高使用者對資訊的信任度,並幫助他們更好地應對AI 技術帶來的挑戰。

莫塞里提到,用戶在信任AI 驅動的搜尋引擎之前,應該先確認聊天機器人所提供的資訊是否可靠。這一點與檢查發布聲明或圖像的來源類似,只有來自信譽良好的帳戶的資訊才能更值得信賴。

莫塞里所描述的內容監管方式更接近用戶主導的審核系統,例如Twitter 上的社群筆記和YouTube 的內容過濾器。雖然目前尚不清楚Meta 是否會引入類似的功能,但考慮到該公司過去有借鑒其他平台的經驗,未來的內容管理政策值得關注。

總而言之,面對AI生成內容帶來的挑戰,Instagram和Meta正在積極探索解決方案,這不僅需要平臺本身的努力,也需要使用者提升自身辨別能力,共同維護網路資訊的可信度和安全性。未來的內容監管模式將會如何演變,值得我們持續關注。