大型語言模式(LLM)的開源推動了AI技術的發展,但也帶來了智慧財產權保護的挑戰。 「套殼」模型的出現,使得辨識模型來源成為一個迫切需要解決的問題。本文將探討現有模型指紋辨識方法的不足,並介紹一種新型的、穩健性更強的模型指紋辨識方法——REEF,它如何有效地解決「套殼」問題,並保護LLM的智慧財產權。

在AI 時代,大型語言模型(LLM)就像武林秘籍,其訓練過程耗費巨大算力、數據,就像閉關修練多年的武林高手。而開源模型的發布,就像高手將秘籍公之於眾,但會附帶一些許可證(如Apache2.0和LLaMA2社區許可證)來保護其知識產權(IP)。

然而,江湖險惡,總有「套殼」事件發生。一些開發者聲稱自己訓練了新的LLM,實際上卻是在其他基礎模型(如Llama-2和MiniCPM-V)上進行包裝或微調。 這就好像偷學了別人的武功,卻對外宣稱是自己原創的。為了防止這種情況發生,模型所有者和第三方迫需要一種方法來識別「套殼」模型。

現有的模型指紋辨識方法主要有兩類:

注入式指紋: 這就像是在秘技中偷偷做上標記,例如水印方法。 這種方法會人為地在模型訓練或微調過程中添加一些“觸發器”,讓模型在特定條件下產生特定的內容,從而識別模型來源。 但是,這種方法會增加訓練成本,影響模型效能,甚至可能被移除。 而且,對於已經發布的模型,這種方法就無法應用了。

內在式指紋: 這就像是從秘籍本身的內容和風格來判斷其來源。 這種方法利用模型本身的屬性來進行識別,包括模型權重和特徵表示。 其中,基於權重的指紋方法是透過計算模型權重的相似度來進行辨識。 但是,這種方法容易受到權重變化的影響,例如權重排列、剪枝和微調。 而基於語意分析的方法則透過統計分析模型產生的文本來進行辨識。 但是,這兩種方法都存在著穩健性不足的問題。

那麼,有沒有一種方法既能有效辨識「套殼」模型,又不影響模型性能,還能抵抗各種「花式」改造呢?

上海人工智慧實驗室等機構的研究人員提出了一種新的模型指紋辨識方法—REEF。

REEF 的工作原理是:

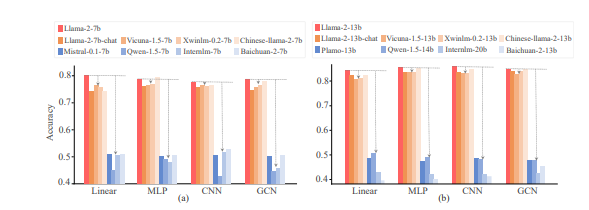

REEF 是一種基於特徵表示的指紋辨識方法。 它不依賴任何特定層的表示,而是利用LLM 強大的表示建模能力,可以從各個層提取特徵進行識別。

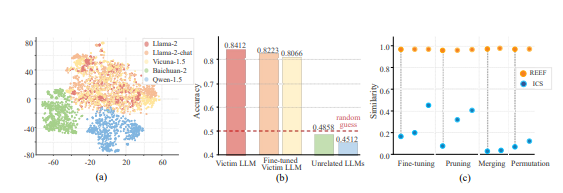

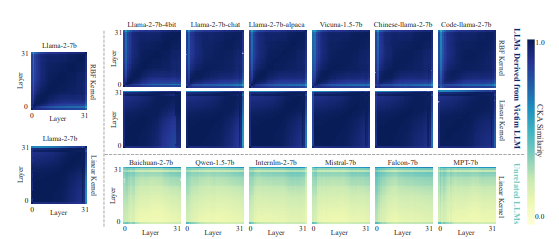

它會比較兩個模型在相同樣本上的特徵表示的中心核對齊(CKA) 相似度。 CKA 是一種基於Hilbert-Schmidt 獨立性準則(HSIC) 的相似度指標,它可以衡量兩組隨機變數之間的獨立性。

如果相似度高,表示嫌疑模型很可能是從受害模型衍生出來的;反之,則不太可能。

REEF 有哪些優點呢?

無需訓練: 這意味著它不會影響模型的性能,也不會增加額外的訓練成本。

穩健性強: 它對模型剪枝、微調、合併、排列和縮放變換等各種後續開發都具有穩健性。 即使嫌疑模型經過了大規模的微調(高達700B token 的資料量),REEF 仍然可以有效地識別出它是否源自受害模型。

理論保證: 研究人員從理論上證明了CKA 對列排列和縮放變換具有不變性。

實驗結果表明,REEF 在識別「套殼」模型方面表現出色,優於現有的基於權重和語義分析的方法。

REEF 的出現,為保護LLM 的智慧財產權提供了一種新的利器,有助於打擊未經授權使用或複製模型等不道德或非法行為。

論文網址:https://arxiv.org/pdf/2410.14273

總而言之,REEF 方法為解決LLM開源模型的智慧財產權保護問題提供了一個有效、穩健且高效的解決方案,為建構更健康的AI生態環境貢獻力量。