流暢的人機對話是人工智慧領域的重要目標,然而,AI 常常在「輪次結束」的判斷上出現問題,導致對話體驗不佳。 使用者經常遇到AI打斷或遲遲不回應的情況,嚴重影響了人機互動的效率和自然度。傳統的語音活動偵測(VAD)方法過於簡單,容易受到環境噪音和使用者停頓的影響,無法準確判斷對話的結束。

在人機對話的世界裡,最讓人頭痛的莫過於--「你到底說完沒」! 這句話看似簡單,卻成了無數語音助理和客服機器人邁不過去的一道坎兒。 你是不是也常常遇到這種情況:你只是停頓了一下,想思考接下來要說什麼,結果AI 就迫不及待地蹦出來回應;或者你明明已經講完了,AI 卻還在傻傻地等著,直到你忍不住再說一句「我講完了」它才反應過來, 這體驗簡直讓人抓狂。

這並非AI 故意搗亂,而是因為它們在判斷“輪次結束”(End of Turn, EOT)時,就像一個“睜眼瞎”,只能聽到有沒有聲音,卻搞不清你到底有沒有說完。傳統的方法主要依賴語音活動檢測(VAD),就像一個“聲控開關”,只關注有沒有語音信號,只要沒聲音就判定你說完了,這能不被停頓和背景噪音給迷惑嗎?簡直太「單純」了!

不過,最近有一家叫Livekit 的公司,他們看不下去了,決定要給AI 裝上一顆更聰明的「大腦」。他們開發了一個開源的精準語音輪次偵測模型,這個模型就像一個真正的「讀心術」高手,能夠精準地判斷你到底有沒有說完話。這可不是簡單的“聲控開關”,而是能夠理解你說話意圖的“智能助手”!

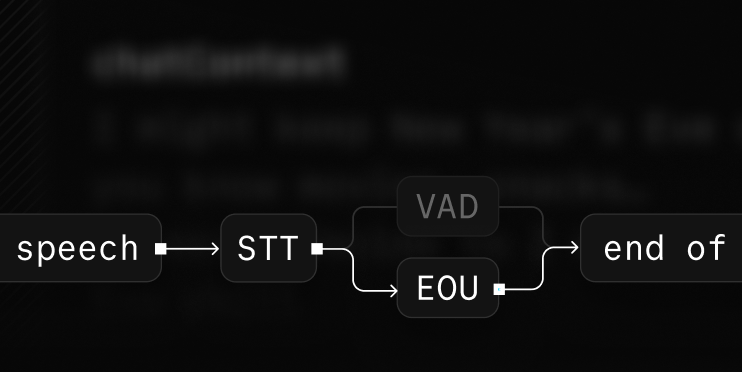

Livekit 的這個模型,厲害之處就在於它不是單純地依賴“有沒有聲音”,而是把Transformer 模型和傳統的語音活動檢測(VAD)結合起來。這就好比給AI 配上了一個「超級大腦」和一個「順風耳」。 「順風耳」負責監聽有沒有聲音,而「超級大腦」則負責分析這些聲音的語義,理解你的話是否完整,有沒有未盡之意。 這二者強強聯合,才能真正實現精準的「輪次結束偵測」。

這個模型能幹啥?它可以讓語音助理、客服機器人這些AI 夥伴們更準確地判斷你是否已經說完,然後才開始回應你,這無疑會大大提高人機對話的流暢度和自然度。以後和AI 聊天,再也不用擔心被它「搶話」或「裝聾作啞」了!

為了證明自己的實力,Livekit 也亮出了他們的測試結果:他們的新模型,能夠讓AI 的「錯誤打斷」減少85%! 這意味著,AI 變得更加自然和不容易誤判,人機對話也變得更加順暢愉快了。想想看,以後你打電話給客服,再也不用被AI 的機械回復給弄得心煩意亂,而是能像跟真人聊天一樣自如,這體驗,簡直不要太棒!

而且,這個模型尤其適合那些需要人機對話的場景,例如語音客服、智慧問答機器人等等。 Livekit 也特別貼心地展示了一段演示視頻,視頻中的AI 代理,在接收到用戶的提問後,會耐心等待用戶說完所有信息,然後再給出相應的回答。 這就像一個真正理解你需求的“知心人”,不會在你還沒說完的時候就“插嘴”,也不會在你已經說完的時候還“呆若木雞”。

當然,這個模型目前還是在開源階段,還有很大的進步空間。但我們有理由相信,隨著科技的不斷發展,未來的人機對話一定會更加自然、流暢、更有智慧。也許有一天,我們真的會忘記和自己對話的,是一個冰冷的機器,而是一個真正懂你的「AI夥伴」。

專案地址:https://github.com/livekit/agents/tree/main/livekit-plugins/livekit-plugins-turn-detector

Livekit 的開源模型為解決人機對話中的「輪次結束」問題提供了新的思路,標誌著人機互動體驗邁向更自然、更流暢的階段。期待未來模型的進一步完善與應用,為用戶帶來更便利、更智慧的人機對話體驗。