隨著多裝置時代的來臨,影像和影片的跨平台適配成為迫切需求。如何自動且有效率地調整影像大小,以適應不同螢幕尺寸並保持最佳顯示效果,成為影像處理領域的研究熱點。阿聯酋沙迦大學的研究團隊為此提供了一個基於深度學習的創新解決方案,該方案能夠自動預測影像的最佳尺寸,並選擇最合適的重新導向技術,有效減少資訊損失,提升使用者體驗。

隨著數位裝置的快速普及,如何將影像和影片完美適應各種螢幕尺寸,成為了一個亟待解決的問題。阿聯酋沙迦大學的科學研究團隊最近發表了一項研究,利用深度學習模式開發出一種全新的技術,能夠自動預測影像的最佳尺寸,從而實現不同裝置間的無縫顯示。

這項研究的核心是採用了轉移學習技術,使用了Resnet18、DenseNet121和InceptionV3等深度學習模型。研究人員表示,現有的影像重新導向技術雖然已經很多,但往往無法自動調整影像尺寸,仍需手動介入。這導致在不同螢幕上,影像可能出現裁剪或失真的情況。因此,研究團隊希望透過自動化手段,找到最佳的影像重定向方法,以減少資訊損失,保持影像品質。

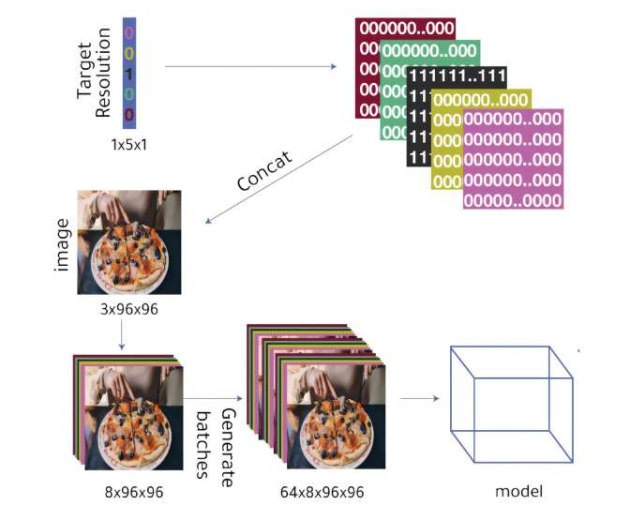

為了實現這一目標,研究者們建構了一個包含46,716張不同解析度的圖像資料集,涉及六個類別的重定向技術。透過實驗,他們將類別資訊作為第三個輸入,同時將解析度資訊編碼為影像的一個額外通道。經過評估,結果顯示,他們的方法在選擇合適的重定向技術方面取得了90% 的最佳F1分數,顯示此方法的有效性。

研究團隊認為,深度學習可以自動提取影像特徵,有效捕捉複雜關係,使影像重定向方法的分類變得更加準確。雖然目前尚未透露新技術的商業化時間表,但他們強調需要進一步研究,以開發出完全自動化選擇最佳技術和重定向影像的模型。此外,他們計劃擴充資料集,增加更多樣本和重定向方法,以提高模型的準確性和適應性。

這項研究為影像處理領域提供了新的解決方案,期待未來能實現更有效率和智慧的影像重定向。

論文:https://ieeexplore.ieee.org/document/10776979

劃重點:

研究團隊開發出基於深度學習的自動影像重新導向技術,能夠無縫適配不同螢幕。

採用Resnet18、DenseNet121和InceptionV3等模型,顯著提升影像處理的準確性。

透過擴展資料集和進一步研究,團隊希望實現更全面的自動化影像處理方案。

這項研究成果為解決影像適配問題提供了新的思路,其高準確率和自動化程度為未來的影像處理技術發展帶來了新的可能性。 研究團隊後續的努力,特別是資料集的擴展和模型的完善,將進一步提昇技術的實用性和普及性。