Hugging Face 團隊發布了兩款輕量級AI模型:SmolVLM-256M和SmolVLM-500M,它們的參數分別為2.56億和5億,是目前體積最小可同時處理圖像、視頻和文本數據的AI模型。 這兩款模型尤其適合內存小於1GB的設備,為開發者提供了低成本、高效率的數據處理方案。其高效性能在各種基準測試中超越了許多更大規模的模型,尤其在處理小學生科學圖表方面表現突出,展現了其在教育和研究領域的巨大潛力。

近期,人工智能開發平台Hugging Face 團隊發布了兩款新型AI 模型,SmolVLM-256M 和SmolVLM-500M。他們自信地聲稱,這兩款模型是目前為止體積最小的AI 模型,能夠同時處理圖像、短視頻和文本數據,尤其適合內存少於1GB 的設備如筆記本電腦。這一創新讓開發者在處理大量數據時,能夠以更低的成本實現更高的效率。

這兩款模型的參數分別為256百萬和500百萬,這意味著它們在解決問題的能力上也相應有所提升,參數越多,模型的表現通常越好。 SmolVLM 系列能夠執行的任務包括對圖像或視頻片段進行描述,以及回答關於PDF 文檔及其內容的問題,比如掃描文本和圖表。這使得它們在教育、研究等多個領域具備了廣泛的應用前景。

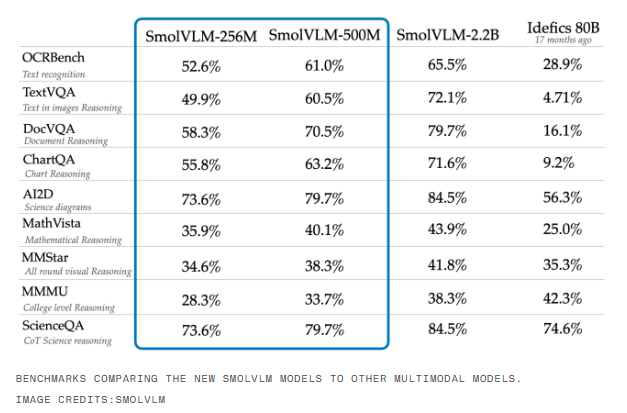

在模型的訓練過程中,Hugging Face 團隊利用了名為“The Cauldron” 的50個高質量圖像和文本數據集,以及名為Docmatix 的文件掃描和詳細說明配對的數據集。這兩個數據集均由Hugging Face 的M4團隊開發,專注於多模態AI 技術的發展。值得注意的是,SmolVLM-256M 和SmolVLM-500M 在各類基準測試中表現優於許多更大模型,如Idefics80B,尤其是在AI2D 測試中,它們在分析小學生科學圖表的能力上表現突出。

然而,小型模型雖然價格親民且多才多藝,但它們在復雜推理任務上的表現可能不如大型模型。一項來自Google DeepMind、微軟研究院以及魁北克Mila 研究所的研究顯示,許多小型模型在這些複雜任務上的表現令人失望。研究人員推測,這可能是由於小型模型傾向於識別數據的表面特徵,而在新情境中應用這些知識時則顯得力不從心。

Hugging Face 的SmolVLM 系列模型不僅是體積小巧的AI 工具,而且在處理各種任務時展現出了令人矚目的能力。對於希望以低成本實現高效數據處理的開發者而言,這無疑是一個不錯的選擇。

SmolVLM 系列模型的出現,為輕量級AI應用帶來了新的可能性,其在資源受限設備上的出色表現,為未來AI技術發展提供了新的方向。雖然在復雜任務上仍有提升空間,但其低門檻和高效率使其成為眾多開發者值得關注的選擇。 未來,期待看到SmolVLM系列模型在更多領域的應用和進一步的優化。