腾讯今日宣布开源其名为Hunyuan-large的大语言模型,参数规模达到398B,激活参数量52B。该模型在多个权威基准测试中表现出色,超越了Llama 3.1和Mixtral等同类开源模型。 其技术创新包括高质量合成数据的应用,有效解决了自然数据不足的问题,并支持高达256K的文本序列,显著提升了长文本处理能力。 此外,腾讯还开源了名为“企鹅卷轴”的评测数据集,旨在弥补行业内缺乏高质量长文本评测集的现状,推动大模型技术发展。

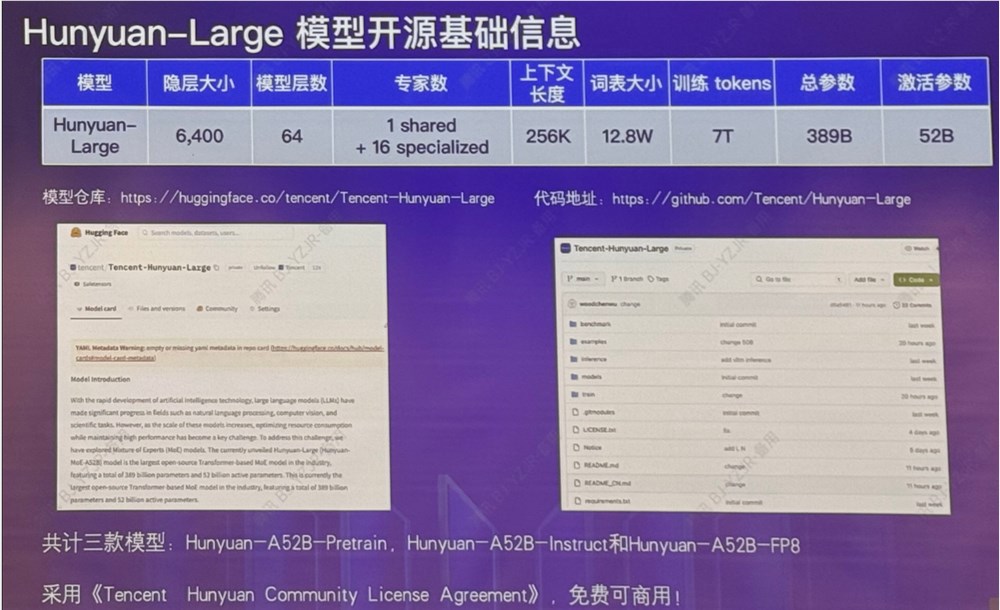

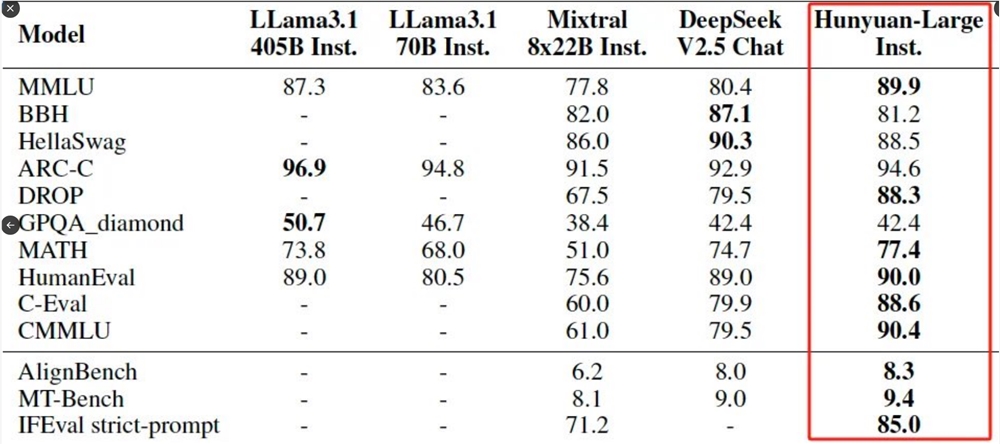

腾讯今日发布开源MOE大语言模型Hunyuan-large,总参数量达398B,激活参数量52B。公开测评结果显示,腾讯混元Large在CMMLU、MMLU、CEva1、MATH等多学科综合评测集以及中英文NLP任务、代码和数学等9大维度全面领先,超过Llama3.1、Mixtral等一流的开源大模型。

据了解,该模型在技术创新上可实现高质量合成数据,通过使用合成数据增强训练,有效应对自然数据的不足。在上下文处理能力方面,预训练模型支持高达256K的文本序列,显著增强了处理长上下文任务的能力。

同时,腾讯混元宣布,为填补行业真实长文评测集不足,腾讯混元即将开源企鹅卷轴评测集助力业界应用研究。自研企鹅卷轴(PenguinScrolls)基于公开金融、法律、学术论文等多种自然长文本,长度范围达1K-128K,覆盖各种深度阅读理解、长文推理任务。

腾讯混元Large大语言模型的发布和企鹅卷轴评测集的开源,将为业界提供更强大的语言模型和评测工具,推动自然语言处理和人工智能领域的发展。

官网地址:https://llm.hunyuan.tencent.com

Hunyuan-large的开源,以及企鹅卷轴评测集的同步发布,标志着腾讯在大型语言模型领域的又一重大突破,为学术研究和产业应用提供了强有力的支撑,值得期待其在未来人工智能发展中的作用。