Meta AI的研究人員與學術夥伴共同開發了一種創新系統——MILS(多模態迭代LLM求解器),該系統能在無需經過專門訓練的情況下,教大型語言模型處理圖像、視頻和音頻。 MILS依賴於語言模型的自然問題解決能力,而非大量的數據訓練,展現了其獨特的優勢。

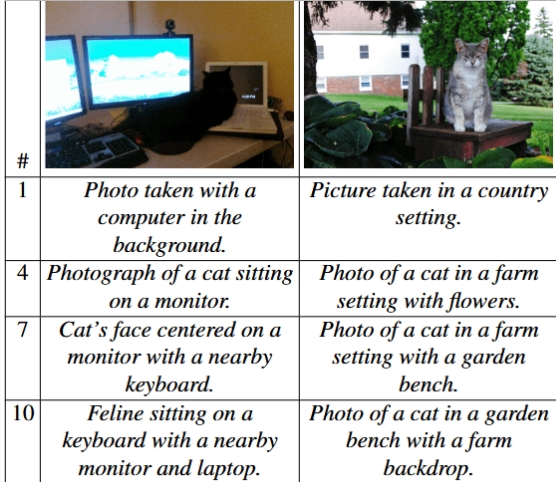

MILS的工作原理是通過將兩個AI模型配對來進行任務解決:一個是“生成器”,負責提出任務解決方案,另一個是“評分器”,用來評估生成方案的效果。評分器提供的反饋可以幫助生成器不斷優化答案,直到達到令人滿意的結果。舉例來說,在圖像描述任務中,MILS能夠逐步細化圖像描述,從而準確地描述不同層次的圖像細節。

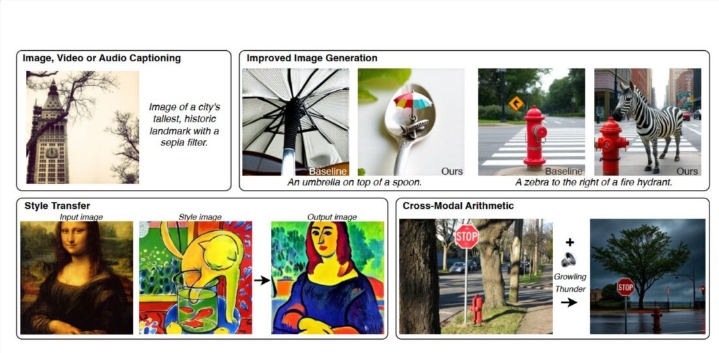

在圖像描述方面,MILS表現尤為出色。通過將Llama-3.1-8B模型作為生成器,CLIP模型作為評分器,MILS能夠創建出與當前領先方法相當甚至更為詳細的圖像描述,儘管CLIP並未專門針對圖像描述任務進行訓練。此外,MILS還通過微調文本提示增強了文本到圖像的生成能力,並且能將AI生成的提示與圖像處理工具相結合,處理如風格轉換等圖像編輯任務。

圖像描述的準確性隨著生成器和評分器之間的步驟數而增加。 | 圖片:Ashutosh 等人

MILS的功能不僅限於圖像,它也擴展到了視頻和音頻領域。在使用MSR-VTT視頻數據集進行測試時,MILS在視頻內容描述方面的表現優於現有模型。由於MILS在運行過程中不修改模型參數,它可以將不同類型的數據轉換為可讀文本,支持將來自圖像、音頻等多個來源的信息合併並轉化為所需格式,從而為多模態信息融合應用開闢了新的可能。

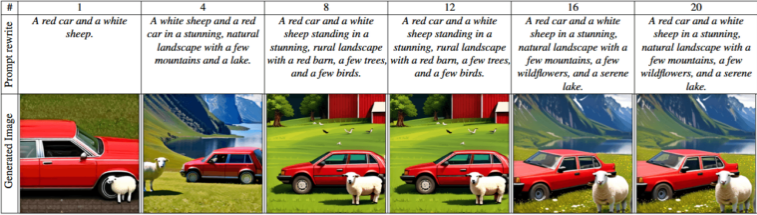

測試表明,使用更大的生成器和評分模型可以產生更準確的結果,增加潛在解決方案數量能顯著提高性能。研究人員還發現,擴展到更大的語言模型不僅提升了結果的質量,還使得性能表現得到了明顯改進。

風景從簡單的基本描述演變為具有更精確細節和更多自然元素的複雜景觀表述。 | 圖片:Ashutosh 等人

MILS所採取的這一創新策略,符合當前人工智能領域朝著更智能推理能力發展的趨勢。 Meta團隊還表示,MILS在未來可能在3D數據處理等領域展現出巨大潛力,進一步推動多模態AI的發展。

隨著OpenAI的GPT-4和其他開源替代方案的快速發展,如Meta的Llama3.2、Mistral的Pixtral以及DeepSeek的Janus Pro等,這些新興的多模態AI系統正在加速其對日常生活的應用,並為人工智能的未來發展奠定了重要基礎。