كسيرفي

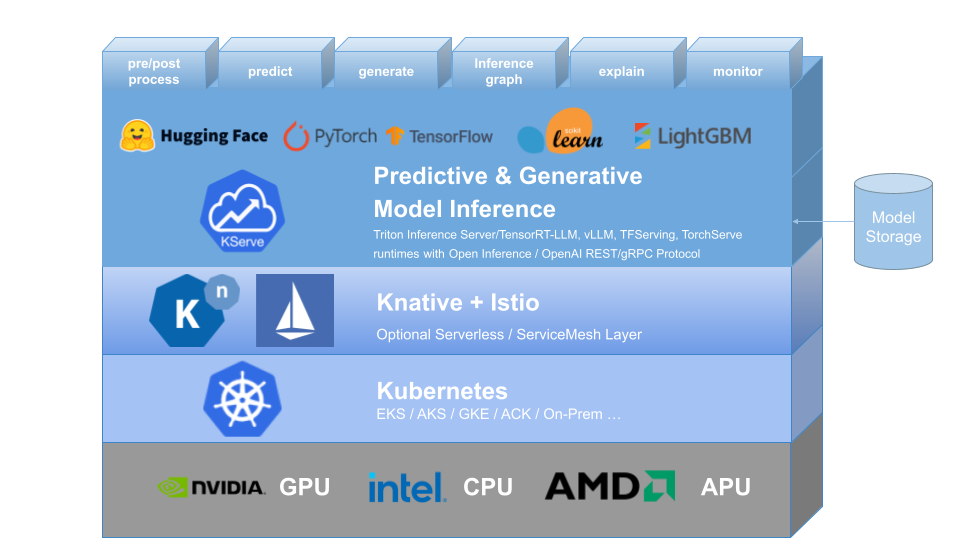

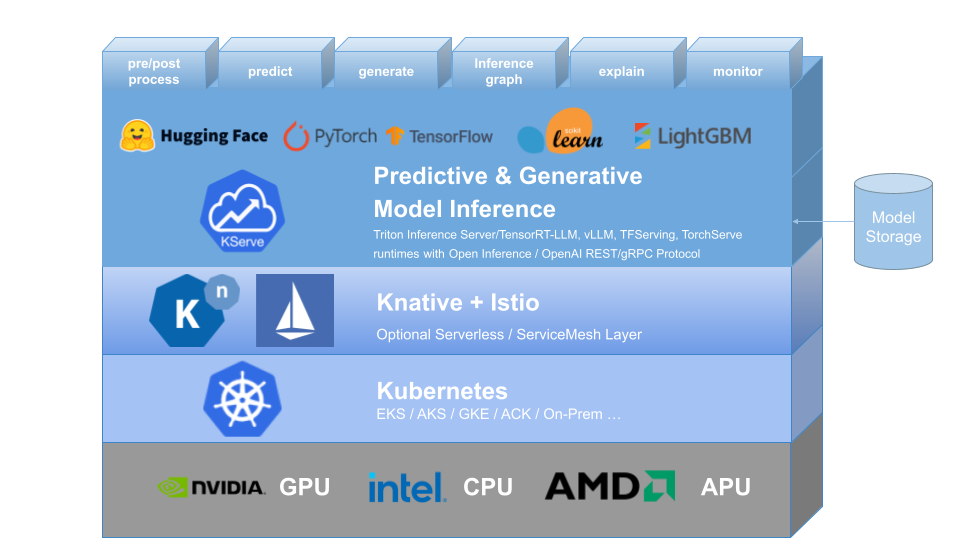

يوفر KServe تعريفًا مخصصًا للموارد من Kubernetes لخدمة نماذج التعلم الآلي التنبؤية والمولدة (ML). ويهدف إلى حل نموذج الإنتاج الذي يخدم حالات الاستخدام من خلال توفير واجهات تجريد عالية لنماذج Tensorflow وXGBoost وScikitLearn وPyTorch وHuggingface Transformer/LLM باستخدام بروتوكولات مستوى البيانات الموحدة.

إنه يتضمن تعقيد القياس التلقائي والشبكات والتحقق من الصحة وتكوين الخادم لتوفير ميزات الخدمة المتطورة مثل GPU Autoscaling وScale to Zero وCanary Rollouts إلى عمليات نشر ML لديك. إنه يتيح قصة بسيطة وقابلة للتوصيل وكاملة لخدمة الإنتاج الآلي بما في ذلك التنبؤ والمعالجة المسبقة والمعالجة اللاحقة وقابلية الشرح. يتم استخدام KServe عبر مختلف المؤسسات.

لمزيد من التفاصيل، قم بزيارة موقع KServe.

تمت إعادة تسمية KFServing إلى KServe منذ الإصدار 0.7.

لماذا كي سيرف؟

- KServe عبارة عن منصة استدلال نموذجية قياسية وغير سحابية لخدمة نماذج الذكاء الاصطناعي التنبؤية والمولدة على Kubernetes، وهي مصممة لحالات الاستخدام القابلة للتطوير بشكل كبير.

- يوفر بروتوكول استدلال موحد عالي الأداء عبر أطر تعلم الآلة بما في ذلك مواصفات OpenAI للنماذج التوليدية.

- دعم عبء عمل الاستدلال الحديث بدون خادم من خلال التوسع التلقائي القائم على الطلب بما في ذلك القياس إلى الصفر على وحدة المعالجة المركزية ووحدة معالجة الرسومات .

- يوفر قابلية تطوير عالية وتعبئة كثيفة وتوجيهًا ذكيًا باستخدام ModelMesh .

- إنتاج بسيط وقابل للتوصيل يخدم في الاستدلال والمعالجة المسبقة واللاحقة والمراقبة وقابلية الشرح .

- عمليات النشر المتقدمة لطرح الكناري وخطوط الأنابيب والمجموعات باستخدام InferenceGraph .

يتعلم أكثر

لمعرفة المزيد حول KServe، وكيفية استخدام الميزات المدعومة المتنوعة، وكيفية المشاركة في مجتمع KServe، يرجى اتباع وثائق موقع KServe الإلكتروني. بالإضافة إلى ذلك، قمنا بتجميع قائمة من العروض التقديمية والعروض التوضيحية للتعمق في التفاصيل المختلفة.

تثبيت

التثبيت المستقل

- التثبيت بدون خادم : يقوم KServe افتراضيًا بتثبيت Knative للنشر بدون خادم لـ InferenceService.

- تثبيت النشر الأولي : بالمقارنة مع التثبيت بدون خادم، يعد هذا تثبيتًا خفيف الوزن . ومع ذلك، لا يدعم هذا الخيار نشر Canary والقياس التلقائي المستند إلى الطلب باستخدام مقياس إلى الصفر.

- تثبيت ModelMesh : يمكنك اختياريًا تثبيت ModelMesh لتمكين حالات استخدام النماذج ذات النطاق العالي والكثافة والمتغيرة بشكل متكرر.

- التثبيت السريع : قم بتثبيت KServe على جهازك المحلي.

تركيب كوبيفلو

يعد KServe مكونًا إضافيًا مهمًا في Kubeflow، يرجى معرفة المزيد من وثائق Kubeflow KServe. راجع الأدلة التالية للتشغيل على AWS أو على OpenShift Container Platform.

؟ قم بإنشاء خدمة الاستدلال الأولى الخاصة بك

خريطة الطريق

مرجع واجهة برمجة تطبيقات InferenceService

؟ دليل المطور

✍️ دليل المساهمين

؟ المتبنون