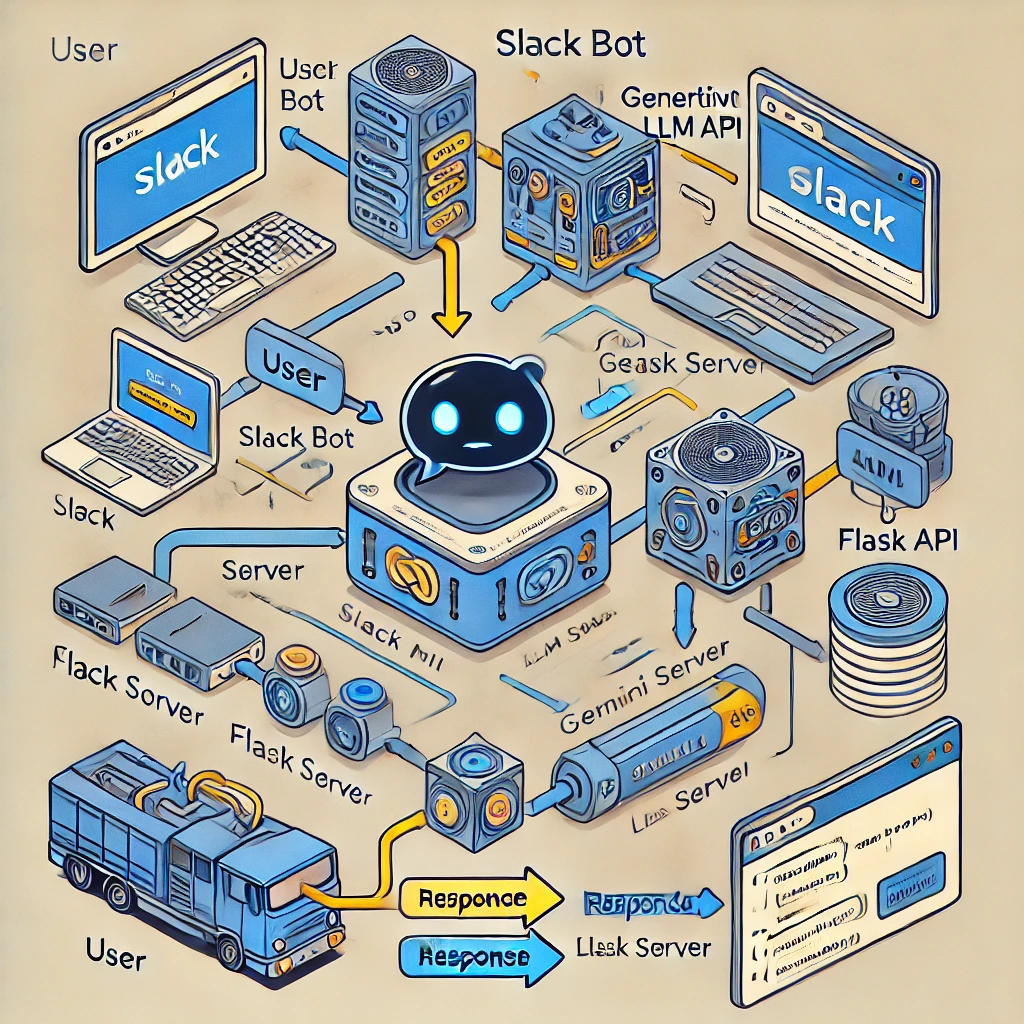

يوضح هذا المشروع كيفية دمج برنامج Slack bot مع برنامج الدردشة الآلي المستند إلى نموذج اللغة الكبير (LLM) باستخدام نموذج Gemini من Google. يسمح التكامل بالاتصال الذكي والمدرك للسياق مباشرة داخل Slack.

تم تصميم Slack bot باستخدام Python وFlask وهو مدمج مع chatbot مدعوم من LLM باستخدام نموذج Gemini. يمكّن هذا الإعداد الروبوت من معالجة مدخلات المستخدم في قنوات Slack والاستجابة بذكاء بناءً على أحدث معلومات هندسة البيانات.

المكتبات المستخدمة: slack_sdk، slack_bolt الوظيفة: يستمع الروبوت إلى أحداث app_mention التي يتم تشغيلها عندما يذكر شخص ما الروبوت في قناة Slack. التكوين: يتم تحميل الرموز المميزة والأسرار بشكل آمن من ملف .env باستخدام متغيرات البيئة

Flask App: The Flask app handles incoming HTTP requests from Slack.

Event Processing: Slack events are processed through Flask using SlackRequestHandler from the slack_bolt.adapter.flask module.

Gemini Model: The Gemini model, provided by Google's Generative AI platform, processes and responds to queries.

Python Package: The google.generativeai package is used to interact with the Gemini model, allowing for prompt-based queries.

Configuration: Tokens are securely loaded from a .env file using environment variables for geminiai api.

استخدام ngrok: يوفر ngrok عنوان URL عامًا يعيد توجيه الطلبات إلى تطبيق Flask المحلي، مما يمكّن Slack من التواصل مع الروبوت. أمر الإعداد: يتم استخدام ngrok http 6060 لعرض تطبيق Flask على الإنترنت.

يؤدي التكامل إلى روبوت Slack قادر على إجراء تحليل متقدم للبيانات والاستجابة بذكاء لاستفسارات المستخدم داخل Slack.