مترجم أكواد الذكاء الاصطناعي للبيانات الحساسة، مدعوم بـ GPT-4 أو Code Llama / Llama 2.

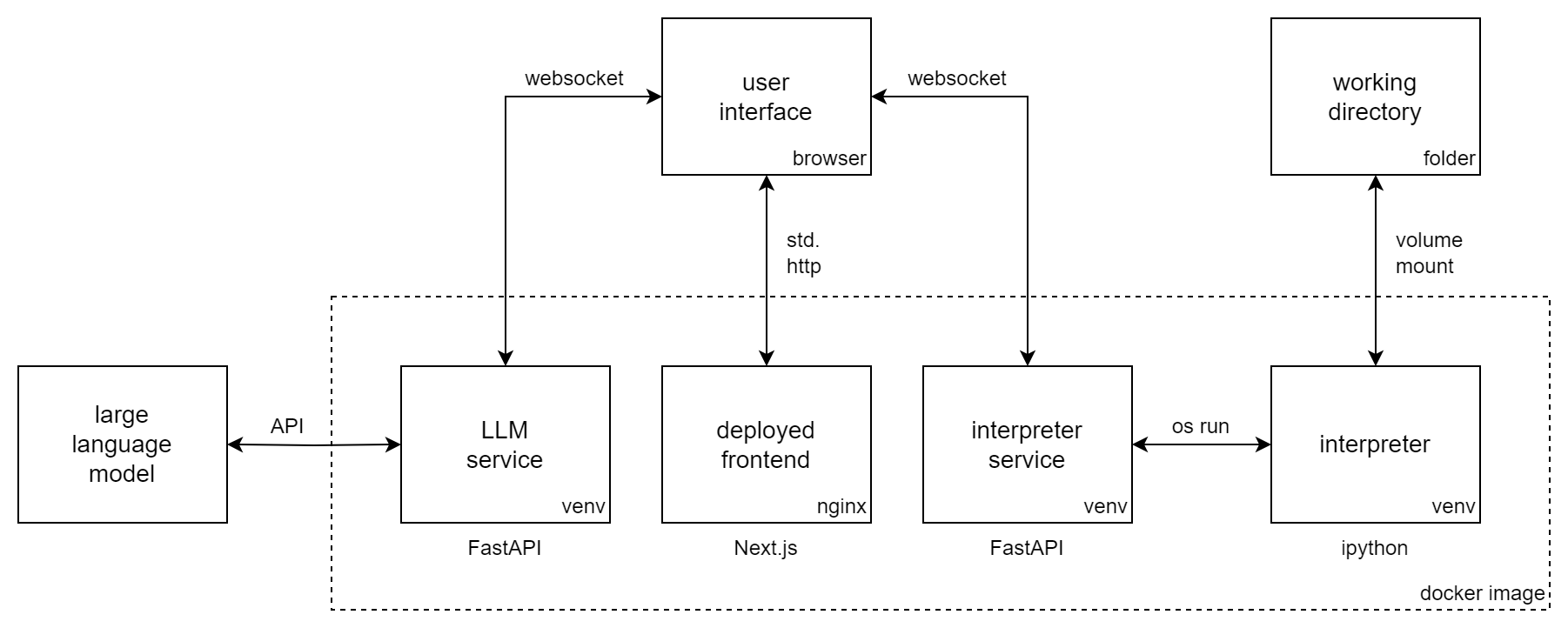

يجمع برنامج Incognito Pilot بين نموذج لغة كبير (LLM) ومترجم Python، حتى يتمكن من تشغيل التعليمات البرمجية وتنفيذ المهام نيابةً عنك. إنه مشابه لـ ChatGPT Code Interpreter ، لكن المترجم الفوري يعمل محليًا ويمكنه استخدام نماذج مفتوحة المصدر مثل Code Llama / Llama 2 .

يتيح لك برنامج Incognito Pilot العمل مع البيانات الحساسة دون تحميلها على السحابة. إما أن تستخدم LLM محليًا (مثل Llama 2)، أو واجهة برمجة التطبيقات (مثل GPT-4). بالنسبة للحالة الأخيرة، توجد آلية موافقة في واجهة المستخدم، والتي تفصل بياناتك المحلية عن الخدمات البعيدة.

مع برنامج التصفح المتخفي ، يمكنك:

وأكثر من ذلك بكثير!

يُظهر الفيديو وضع التصفح المتخفي مع GPT-4. أثناء إرسال محادثتك ونتائج التعليمات البرمجية المعتمدة إلى واجهة برمجة تطبيقات OpenAI، يتم الاحتفاظ ببياناتك محليًا على جهازك. يعمل المترجم محليًا أيضًا ويعالج بياناتك هناك. ويمكنك الذهاب إلى أبعد من ذلك واستخدام Code Llama / Llama 2 لتشغيل كل شيء على جهازك.

يوضح هذا القسم كيفية تثبيت Incognito Pilot باستخدام نموذج GPT عبر واجهة برمجة تطبيقات OpenAI. ل

اتبع الخطوات التالية:

docker run -i -t

-p 3030:80

-e OPENAI_API_KEY= " sk-your-api-key "

-e ALLOWED_HOSTS= " localhost:3030 "

-v /home/user/ipilot:/mnt/data

silvanmelchior/incognito-pilot:latest-slimفي وحدة التحكم، يجب أن تشاهد الآن عنوان URL. افتحه وسترى واجهة Incognito Pilot .

من الممكن أيضًا تشغيل Incognito Pilot باستخدام أرصدة النسخة التجريبية المجانية من OpenAI، دون إضافة بطاقة ائتمان. في الوقت الحالي، لا يشمل هذا GPT-4، لذا انظر أدناه كيفية تغيير النموذج إلى GPT-3.5.

في واجهة Incognito Pilot ، سترى واجهة دردشة يمكنك من خلالها التفاعل مع النموذج. دعونا نجربها!

يجب أن تكون الآن جاهزًا لاستخدام Incognito Pilot لمهامك الخاصة. فقط تذكر:

شيء آخر: الإصدار الذي استخدمته للتو لا يحتوي تقريبًا على أي حزم يتم شحنها مع مترجم Python. وهذا يعني أن أشياء مثل قراءة الصور أو ملفات Excel لن تعمل. لتغيير ذلك، عد إلى وحدة التحكم واضغط على Ctrl-C لإيقاف الحاوية. الآن أعد تشغيل الأمر، ولكن قم بإزالة اللاحقة -slim من الصورة. سيؤدي هذا إلى تنزيل نسخة أكبر بكثير ومجهزة بالعديد من الحزم.

لاستخدام نموذج آخر غير النموذج الافتراضي (GPT-4)، قم بتعيين متغير البيئة LLM . تحتوي نماذج GPT الخاصة بـ OpenAI على البادئة gpt: لذا لاستخدام GPT-3.5 على سبيل المثال (ChatGPT الأصلي)، أضف ما يلي إلى أمر docker run:

-e LLM= " gpt-openai:gpt-3.5-turbo "يرجى ملاحظة أن GPT-4 أفضل بكثير في إعداد المترجم الفوري من GPT-3.5.

لخدمة واجهة المستخدم في منفذ مختلف عن 3030، يمكنك تعريض المنفذ الداخلي 80 لمنفذ مختلف، على سبيل المثال 8080. يجب عليك أيضًا تغيير متغير المضيف المسموح به في هذه الحالة:

docker run -i -t

-p 8080:80

-e ALLOWED_HOSTS= " localhost:8080 "

...

silvanmelchior/incognito-pilotافتراضيًا، يتم إنشاء رمز المصادقة المميز، والذي يعد جزءًا من عنوان URL الذي تفتحه، بشكل عشوائي عند بدء التشغيل. وهذا يعني أنه كلما قمت بإعادة تشغيل الحاوية، ستحتاج إلى إعادة نسخ عنوان URL. إذا كنت تريد منع ذلك، يمكنك أيضًا تثبيت الرمز المميز على قيمة معينة، عن طريق إضافة ما يلي إلى أمر docker run:

-e AUTH_TOKEN= " some-secret-token " بمجرد فتح عنوان URL باستخدام الرمز المميز الجديد، سيتذكره المتصفح. وبالتالي، من الآن فصاعدًا، يمكنك الوصول إلى Incognito Pilot بمجرد فتح http://localhost:3030، دون الحاجة إلى إضافة رمز مميز إلى عنوان URL.

افتراضيًا، يتوقف مترجم Python بعد 30 ثانية. لتغيير ذلك، قم بتعيين متغير البيئة INTERPRETER_TIMEOUT . لمدة دقيقتين على سبيل المثال، قم بإضافة ما يلي إلى أمر docker run:

-e INTERPRETER_TIMEOUT= " 120 " لبدء تشغيل Incognito Pilot تلقائيًا باستخدام docker / عند بدء التشغيل، قم بإزالة -i -t من أمر التشغيل وأضف ما يلي:

--restart alwaysبالإضافة إلى الإشارة المرجعية لعنوان URL لواجهة المستخدم، سيكون لديك تطبيق Incognito Pilot في متناول يدك عندما تحتاج إليه. وبدلاً من ذلك، يمكنك استخدام docker-compose.

هل أنت غير راضٍ عن الحزم المثبتة مسبقًا للإصدار الكامل (المعروف أيضًا باسم غير النحيف)؟ هل تريد إضافة المزيد من حزم Python (أو Debian) إلى المترجم؟

يمكنك بسهولة تخزين تبعياتك الخاصة باستخدام Incognito Pilot . للقيام بذلك، قم بإنشاء ملف Dockerfile مثل هذا:

FROM silvanmelchior/incognito-pilot:latest-slim

SHELL [ "/bin/bash" , "-c" ]

# uncomment the following line, if you want to install more packages

# RUN apt update && apt install -y some-package

WORKDIR /opt/app

COPY requirements.txt .

RUN source venv_interpreter/bin/activate &&

pip3 install -r requirements.txtضع تبعياتك في ملف require.txt وقم بتشغيل الأمر التالي:

docker build --tag incognito-pilot-custom .ثم قم بتشغيل الحاوية مثل هذا:

docker run -i -t

...

incognito-pilot-customلا، لها حدودها. إن المقايضة بين الخصوصية والقدرات ليست بالأمر السهل في هذه الحالة. بالنسبة لأشياء مثل الصور، فهي قوية مثل مترجم أكواد ChatGPT، لأنها لا تحتاج إلى معرفة محتوى الصورة لتحريرها. لكن بالنسبة لأشياء مثل جداول البيانات، إذا لم يتمكن ChatGPT من رؤية المحتوى، فيجب عليه تخمين تنسيق البيانات على سبيل المثال من الرأس، وهو ما قد يحدث خطأ.

ومع ذلك، في بعض الجوانب، فهو أفضل من مترجم أكواد ChatGPT: يتمتع المترجم بإمكانية الوصول إلى الإنترنت، مما يسمح بمجموعة من المهام الجديدة التي لم تكن ممكنة من قبل. يمكنك أيضًا تشغيل المترجم الفوري على أي جهاز، بما في ذلك الأجهزة القوية جدًا، حتى تتمكن من حل مهام أكبر بكثير من مترجم أكواد ChatGPT.

يمكنك بالطبع القيام بذلك. ومع ذلك، هناك بعض المزايا لاستخدام Incognito Pilot :

أيًا كان ما تكتبه وجميع نتائج التعليمات البرمجية التي توافق عليها ليست خاصة في الواقع، بمعنى أنه يتم إرسالها إلى واجهة برمجة التطبيقات السحابية. ومع ذلك تظل بياناتك محلية. يعمل المترجم محليًا أيضًا، ويقوم بمعالجة بياناتك أينما كانت. بالنسبة لأشياء معينة، سيتعين عليك إخبار النموذج بشيء عن بياناتك (على سبيل المثال، اسم الملف الخاص بالبنية)، ولكن عادةً ما تكون البيانات التعريفية هي التي توافق عليها بنشاط في واجهة المستخدم، وليست البيانات الفعلية. في كل خطوة من خطوات التنفيذ، يمكنك فقط رفض إرسال شيء ما إلى واجهة برمجة التطبيقات.

هل تريد المساهمة في برنامج التصفح المتخفي ؟ أو مجرد تثبيته دون عامل ميناء؟ تحقق من تعليمات المساهمة والمبادئ التوجيهية.