L2C

1.0.0

استراتيجية التجميع مع الشبكات العصبية العميقة. توفر مقالة المدونة هذه نظرة عامة عامة.

يوفر هذا المستودع تطبيق PyTorch لخطط نقل التعلم (L2C) ومعايير تعلم مفيدة للتجميع العميق:

* تمت إعادة تسميته من CCL

ويشتمل هذا المستودع على المراجع التالية:

@inproceedings{Hsu19_MCL,

title = {Multi-class classification without multi-class labels},

author = {Yen-Chang Hsu, Zhaoyang Lv, Joel Schlosser, Phillip Odom, Zsolt Kira},

booktitle = {International Conference on Learning Representations (ICLR)},

year = {2019},

url = {https://openreview.net/forum?id=SJzR2iRcK7}

}

@inproceedings{Hsu18_L2C,

title = {Learning to cluster in order to transfer across domains and tasks},

author = {Yen-Chang Hsu and Zhaoyang Lv and Zsolt Kira},

booktitle = {International Conference on Learning Representations (ICLR)},

year = {2018},

url = {https://openreview.net/forum?id=ByRWCqvT-}

}

@inproceedings{Hsu16_KCL,

title = {Neural network-based clustering using pairwise constraints},

author = {Yen-Chang Hsu and Zsolt Kira},

booktitle = {ICLR workshop},

year = {2016},

url = {https://arxiv.org/abs/1511.06321}

}

يدعم هذا المستودع PyTorch 1.0 وpython 2.7 و3.6 و3.7.

pip install -r requirements.txt # A quick trial:

python demo.py # Default Dataset:MNIST, Network:LeNet, Loss:MCL

python demo.py --loss KCL

# Lookup available options:

python demo.py -h

# For more examples:

./scripts/exp_supervised_MCL_vs_KCL.sh # Learn the Similarity Prediction Network (SPN) with Omniglot_background and then transfer to the 20 alphabets in Omniglot_evaluation.

# Default loss is MCL with an unknown number of clusters (Set a large cluster number, i.e., k=100)

# It takes about half an hour to finish.

python demo_omniglot_transfer.py

# An example of using KCL and set k=gt_#cluster

python demo_omniglot_transfer.py --loss KCL --num_cluster -1

# Lookup available options:

python demo_omniglot_transfer.py -h

# Other examples:

./scripts/exp_unsupervised_transfer_Omniglot.sh| مجموعة البيانات | جي تي #class | بوكل (ك = 100) | MCL (ك = 100) | بوكل (ك = GT) | مكل (ك = جي تي) |

|---|---|---|---|---|---|

| ملائكي | 20 | 73.2% | 82.2% | 89.0% | 91.7% |

| Atemayar_Qelisayer | 26 | 73.3% | 89.2% | 82.5% | 86.0% |

| الأطلنطي | 26 | 65.5% | 83.3% | 89.4% | 93.5% |

| اوريك_بيش | 26 | 88.4% | 92.8% | 91.5% | 92.4% |

| أفستا | 26 | 79.0% | 85.8% | 85.4% | 86.1% |

| جييز | 26 | 77.1% | 84.0% | 85.4% | 86.6% |

| جلاجوليتيك | 45 | 83.9% | 85.3% | 84.9% | 87.4% |

| الغورموخي | 45 | 78.8% | 78.7% | 77.0% | 78.0% |

| الكانادا | 41 | 64.6% | 81.1% | 73.3% | 81.2% |

| كيبل | 26 | 91.4% | 95.1% | 94.7% | 94.3% |

| المالايالامية | 47 | 73.5% | 75.0% | 72.7% | 73.0% |

| مانيبوري | 40 | 82.8% | 81.2% | 85.8% | 81.5% |

| المنغولية | 30 | 84.7% | 89.0% | 88.3% | 90.2% |

| الكنيسة_القديمة_السلافونية_السيريلية | 45 | 89.9% | 90.7% | 88.7% | 89.8% |

| أوريا | 46 | 56.5% | 73.4% | 63.2% | 75.3% |

| سيلهيتي | 28 | 61.8% | 68.2% | 69.8% | 80.6% |

| السريانية_سيرتو | 23 | 72.1% | 82.0% | 85.8% | 89.8% |

| تنغوار | 25 | 67.7% | 76.4% | 82.5% | 85.5% |

| التبتية | 42 | 81.8% | 80.2% | 84.3% | 81.9% |

| ULOG | 26 | 53.3% | 77.1% | 73.0% | 89.1% |

| --متوسط-- | 75.0% | 82.5% | 82.4% | 85.7% |

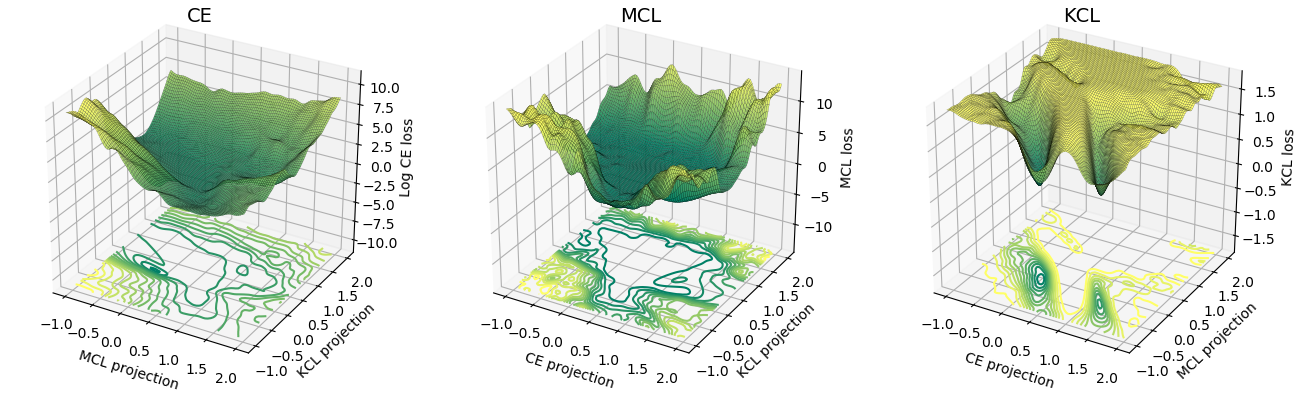

يشبه سطح الخسارة لـ MCL الانتروبيا المتقاطعة (CE) أكثر من KCL. من الناحية التجريبية، تقاربت MCL بشكل أسرع من KCL. لمزيد من التفاصيل، يرجى الرجوع إلى ورقة ICLR.

@article{Hsu18_InsSeg,

title = {Learning to Cluster for Proposal-Free Instance Segmentation},

author = {Yen-Chang Hsu, Zheng Xu, Zsolt Kira, Jiawei Huang},

booktitle = {accepted to the International Joint Conference on Neural Networks (IJCNN)},

year = {2018},

url = {https://arxiv.org/abs/1803.06459}

}

تم دعم هذا العمل من قبل مؤسسة العلوم الوطنية والمبادرة الوطنية للروبوتات (منحة # IIS-1426998) وبرنامج آلات التعلم مدى الحياة (L2M) التابع لـ DARPA، بموجب الاتفاقية التعاونية HR0011-18-2-001.