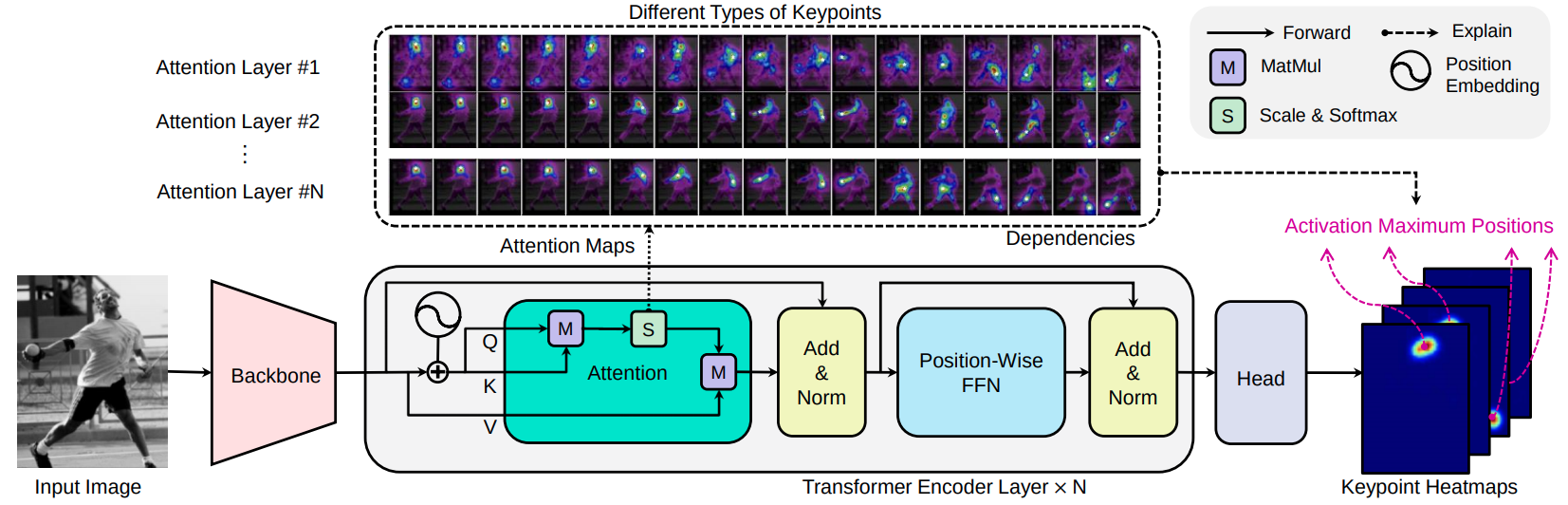

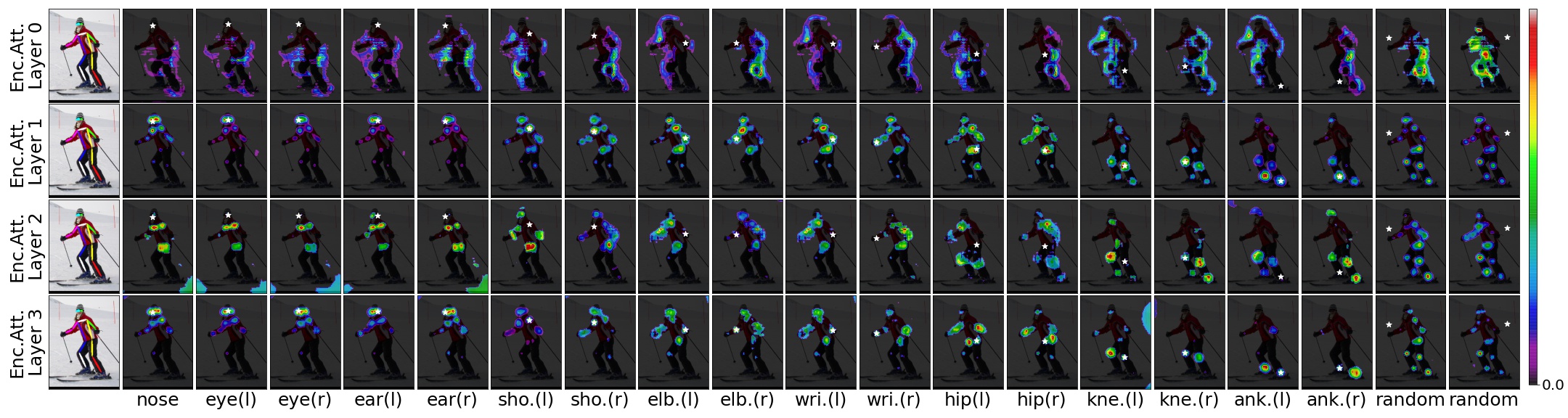

Transpose هو نموذج تقدير تشكل الإنسان يعتمد على مستخرج ميزة CNN ، وشرف محول ، ورأس تنبؤ. بالنظر إلى الصورة ، يمكن لطبقات الانتباه المدمجة في المحول أن تلتقط علاقات مكانية طويلة المدى بكفاءة بين نقاط المفاتيح وشرح التبعيات التي تعتمد عليها مواقع Keypoints المتوقعة.

[Arxiv 2012.14214] [ورقة] [Notebook التجريبي]

transposph: توطين Keypoint عبر Transformer ، Sen Yang ، Zhibin Quan ، Mu Nie ، Wankou Yang ، ICCV 2021

نختار نوعين من CNNs كمرشحين للعمود الفقري: Resnet و HRNET. الكتل التلافيفية المشتقة هي Resnet-Small و Hrnet-Small-W32 و Hrnet-Small-W48.

| نموذج | العمود الفقري | #طبقات | د | ح | #الرؤوس | #Params | AP (Coco Val GT Bbox) | تحميل |

|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | resnet-s | 3 | 256 | 1024 | 8 | 5.2 ميغابايت | 73.8 | نموذج |

| Transpose-R-A4 | resnet-s | 4 | 256 | 1024 | 8 | 6.0MB | 75.1 | نموذج |

| Transpose-HS | Hrnet-S-W32 | 4 | 64 | 128 | 1 | 8.0 ميغابايت | 76.1 | نموذج |

| Transpose-H-A4 | Hrnet-S-W48 | 4 | 96 | 192 | 1 | 17.3 ميجابايت | 77.5 | نموذج |

| Transpose-H-A6 | Hrnet-S-W48 | 6 | 96 | 192 | 1 | 17.5 ميجابايت | 78.1 | نموذج |

جرب عرض الويب:

يمكنك تحميل طرز Transposphose-R-A4 مباشرة أو نقل الأوزان ذات الأوزان المسبقة على مجموعة بيانات Coco Train2017 من Torch Hub ، ببساطة بواسطة:

import torch

tpr = torch . hub . load ( 'yangsenius/TransPose:main' , 'tpr_a4_256x192' , pretrained = True )

tph = torch . hub . load ( 'yangsenius/TransPose:main' , 'tph_a4_256x192' , pretrained = True )| نموذج | حجم الإدخال | FPS* | gflops | AP | AP .5 | AP .75 | AP (M) | AP (L) | AR | AR .5 | AR .75 | ذراع) | AR (ل) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | 256x192 | 141 | 8.0 | 0.717 | 0.889 | 0.788 | 0.680 | 0.786 | 0.771 | 0.930 | 0.836 | 0.727 | 0.835 |

| Transpose-R-A4 | 256x192 | 138 | 8.9 | 0.726 | 0.891 | 0.799 | 0.688 | 0.798 | 0.780 | 0.931 | 0.845 | 0.735 | 0.844 |

| Transpose-HS | 256x192 | 45 | 10.2 | 0.742 | 0.896 | 0.808 | 0.706 | 0.810 | 0.795 | 0.935 | 0.855 | 0.752 | 0.856 |

| Transpose-H-A4 | 256x192 | 41 | 17.5 | 0.753 | 0.900 | 0.818 | 0.717 | 0.821 | 0.803 | 0.939 | 0.861 | 0.761 | 0.865 |

| Transpose-H-A6 | 256x192 | 38 | 21.8 | 0.758 | 0.901 | 0.821 | 0.719 | 0.828 | 0.808 | 0.939 | 0.864 | 0.764 | 0.872 |

ملحوظة:

| نموذج | حجم الإدخال | #Params | gflops | AP | AP .5 | AP .75 | AP (M) | AP (L) | AR | AR .5 | AR .75 | ذراع) | AR (ل) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transpose-HS | 256x192 | 8.0m | 10.2 | 0.734 | 0.916 | 0.811 | 0.701 | 0.793 | 0.786 | 0.950 | 0.856 | 0.745 | 0.843 |

| Transpose-H-A4 | 256x192 | 17.3 م | 17.5 | 0.747 | 0.919 | 0.822 | 0.714 | 0.807 | 0.799 | 0.953 | 0.866 | 0.758 | 0.854 |

| Transpose-H-A6 | 256x192 | 17.5 م | 21.8 | 0.750 | 0.922 | 0.823 | 0.713 | 0.811 | 0.801 | 0.954 | 0.867 | 0.759 | 0.859 |

Jupyter Notebook Demo

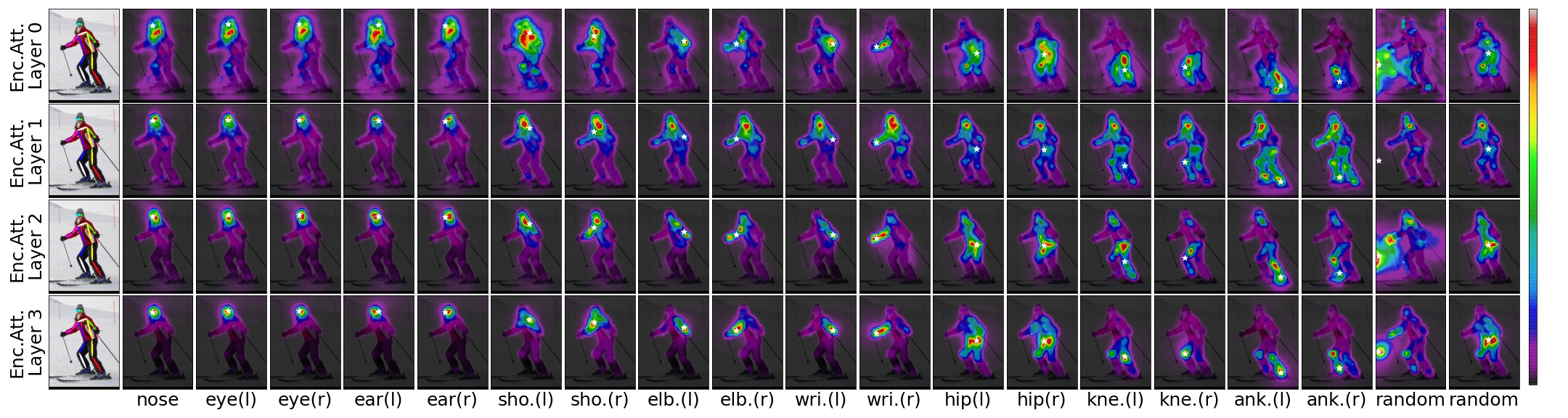

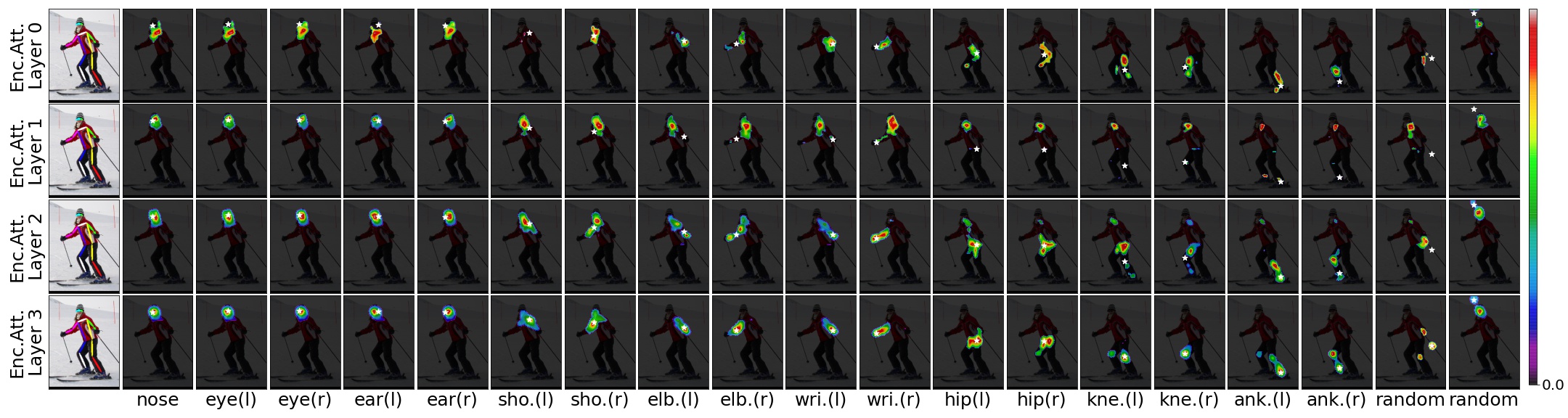

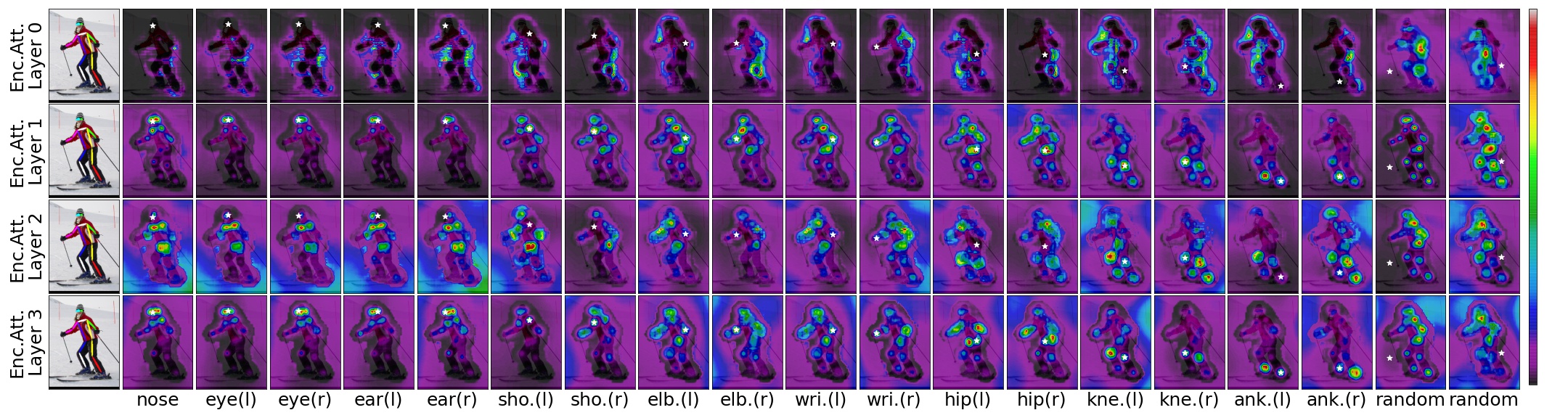

بالنظر إلى صورة الإدخال ، ونموذج transpose المسبق ، والمواقع المتوقعة ، يمكننا تصور التبعيات المكانية للمواقع المتوقعة مع عتبة درجات الانتباه.

TransPose-R-A4 مع threshold=0.00

TransPose-R-A4 مع threshold=0.01

TransPose-H-A4 مع threshold=0.00

TransPose-H-A4 مع threshold=0.00075

استنساخ هذا المستودع ، وسنتصل بالدليل الذي استنساخه على أنه $ {pose_root}

git clone https://github.com/yangsenius/TransPose.gitتثبيت pytorch> = 1.6 و torchvision> = 0.7 من موقع Pytorch الرسمي

تثبيت تبعيات الحزمة. تأكد من بيئة بيثون> = 3.7

pip install -r requirements.txtاجعل الإخراج (نماذج التدريب والملفات) ودليل سجل (سجل tensorboard) تحت $ {pose_root} وجعل libs

mkdir output log

cd ${POSE_ROOT} /lib

makeقم بتنزيل النماذج المسبقة من إصدارات هذا الريبو إلى الدليل المحدد

$ {POSE_ROOT}

`-- models

`-- pytorch

|-- imagenet

| |-- hrnet_w32-36af842e.pth

| |-- hrnet_w48-8ef0771d.pth

| |-- resnet50-19c8e357.pth

|-- transpose_coco

| |-- tp_r_256x192_enc3_d256_h1024_mh8.pth

| |-- tp_r_256x192_enc4_d256_h1024_mh8.pth

| |-- tp_h_32_256x192_enc4_d64_h128_mh1.pth

| |-- tp_h_48_256x192_enc4_d96_h192_mh1.pth

| |-- tp_h_48_256x192_enc6_d96_h192_mh1.pth نحن نتبع خطوات HRNET لإعداد مجموعة بيانات Coco/Val/اختبار وشروحات. يتم تنزيل نتائج الشخص المكتشف من OneDrive أو GoogleRive. يرجى تنزيلها أو ربطها بـ $ {pose_root}/data/coco/، وجعلها تبدو هكذا:

$ {POSE_ROOT}/data/coco/

| -- annotations

| |-- person_keypoints_train2017.json

| `-- person_keypoints_val2017.json

| -- person_detection_results

| |-- COCO_val2017_detections_AP_H_56_person.json

| `-- COCO_test-dev2017_detections_AP_H_609_person.json

`-- images

|-- train2017

| |-- 000000000009.jpg

| |-- ...

`-- val2017

|-- 000000000139.jpg

|-- ... python tools/test.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yaml TEST.USE_GT_BBOX Truepython tools/train.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yamlشكر رائع على هذه الأوراق ورموزها المفتوحة المصدر : hrnet ، detr ، darkpose

يتم إصدار هذا المستودع بموجب ترخيص معهد ماساتشوستس للتكنولوجيا.

إذا وجدت هذا المستودع مفيدًا ، فالرجاء إعطائه نجمة؟ أو فكر في الاستشهاد بعملنا:

@inproceedings{yang2021transpose,

title={TransPose: Keypoint Localization via Transformer},

author={Yang, Sen and Quan, Zhibin and Nie, Mu and Yang, Wankou},

booktitle={IEEE/CVF International Conference on Computer Vision (ICCV)},

year={2021}

}