يعلق هذا الإجراء على القضايا وسحب الطلبات ، وتذكير المرسل إذا تم العثور على لغة مسيئة.

.github/workflows/ بإنشاء ملف سير العمل التالي mind-your-language.yml

name : Mind your language

on :

issues :

types :

- opened

- edited

issue_comment :

types :

- created

- edited

pull_request_review_comment :

types :

- created

- edited

jobs :

echo_issue_comment :

runs-on : ubuntu-latest

name : profanity check

steps :

- name : Checkout

uses : actions/checkout@v2

- name : Profanity check step

uses : tailaiw/[email protected]

env :

GITHUB_TOKEN : ${{ secrets.GITHUB_TOKEN }} كلما تم إنشاء تعليق على مشكلة أو طلب سحب ، فإن تدفق العمل سيؤدي فحص الألفاظ النابية مقابل نص التعليق وتلقي رد الفعل إذا تم العثور على لغة مسيئة.

أنا أستخدم حاليًا Bornity-Check ، وهي حزمة بيثون من اكتشاف الألفاظ النابية بناءً على التعلم الآلي ، لتحديد ما إذا كان التعليق مسيئًا أم لا. إنها ليست قوية للغاية ولكنها حساسة للغة الهجومية الواضحة. آمل أن أستخدم بعض خوارزميات NLP المتطورة للحصول على أداء أفضل. سأقوم بإنشاء ريبو منفصل لمتابعة بدائل أفضل قريبًا. إذا كنت مهتمًا به ، فاستشروا.

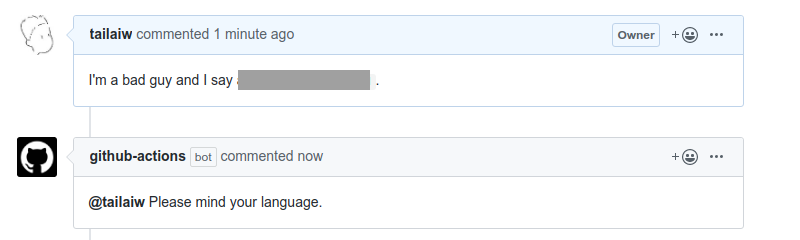

رد الفعل الآن هو بصراحة تلقائية من قبل Github-Actions Bot الذي يذكر مرسل التعليق الهجومي. انظر المثال على النحو التالي.

أنا مطور جديد لحركة GitHub ، لذا فإن الاقتراح والمساعدة أكثر من موضع ترحيب. بالطبع ، "مانع لغتك"؟