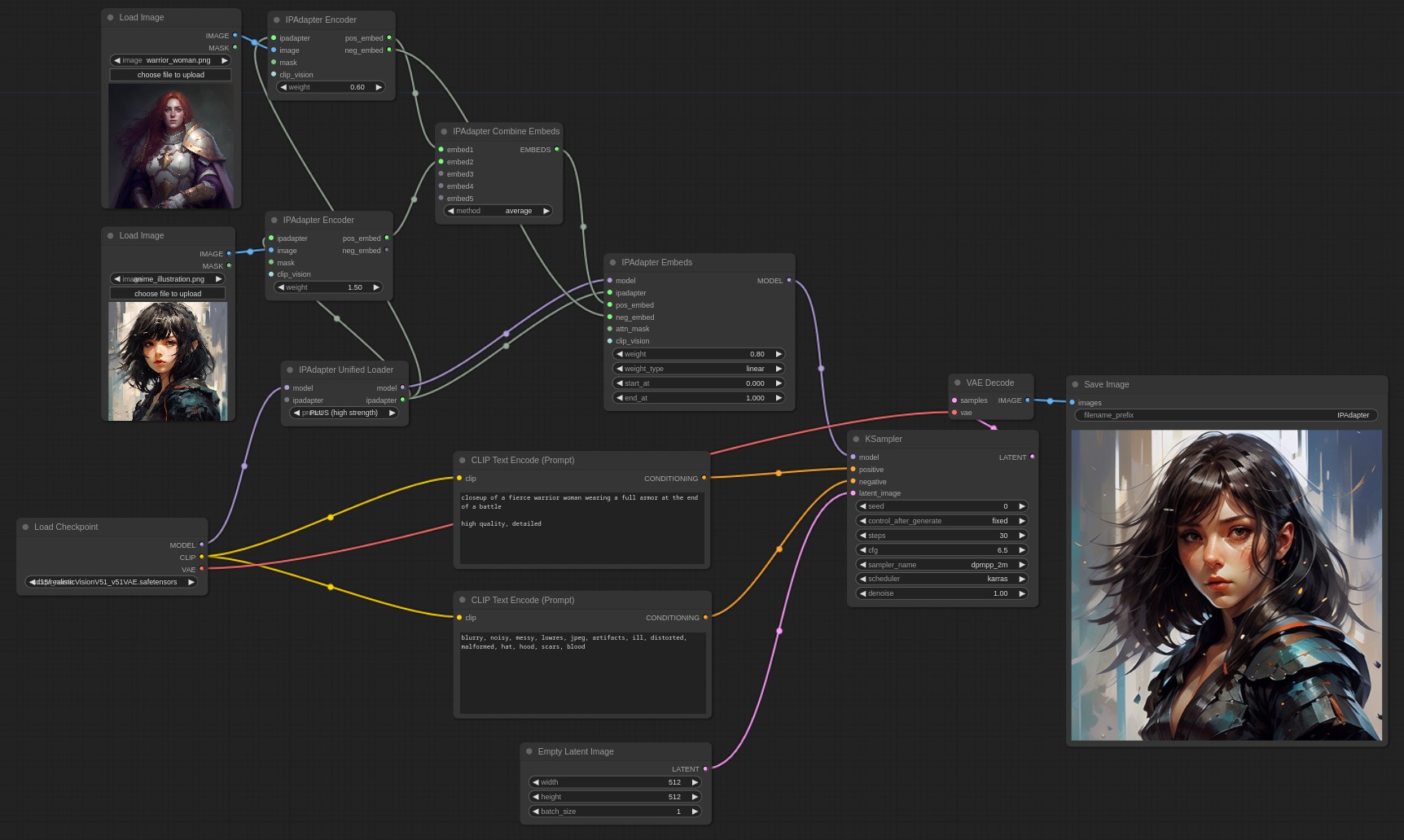

ComfyUI-Referenzimplementierung für IPAdapter-Modelle.

Die IPAdapter sind sehr leistungsstarke Modelle für die Bild-zu-Bild-Konditionierung. Das Thema oder auch nur der Stil der Referenzbilder lassen sich problemlos auf eine Generation übertragen. Betrachten Sie es als eine 1-Bild-Lora.

Github-Sponsor | Paypal

Wenn Ihnen meine Arbeit gefällt und Sie Updates und neue Funktionen sehen möchten, denken Sie bitte darüber nach, meine Projekte zu sponsern.

ComfyUI IPAdapter Plus

ComfyUI InstantID (nativ)

ComfyUI Essentials

ComfyUI FaceAnalysis

Ganz zu schweigen von der Dokumentation und den Video-Tutorials. Schauen Sie sich meine ComfyUI Advanced Understanding -Videos auf YouTube an, zum Beispiel Teil 1 und Teil 2

Die einzige Möglichkeit, den Code offen und frei zu halten, besteht darin, seine Entwicklung zu sponsern. Je mehr Sponsorings, desto mehr Zeit kann ich meinen Open-Source-Projekten widmen.

Bitte erwägen Sie ein Github-Sponsoring oder eine PayPal-Spende (Matteo „matt3o“ Spinelli). Lassen Sie mich für Sponsorings ab 50 $ wissen, ob Sie in dieser Readme-Datei erwähnt werden möchten. Sie finden mich auf Discord oder matt3o? gmail.com .

13.09.2024 : Ein böser Fehler im Patching des mittleren Blocks wurde behoben, den wir von Anfang an mit uns herumtragen. Leider werden die generierten Bilder nicht mehr genau die gleichen sein wie zuvor. Wie dem auch sei, der mittlere Block hat keine große Auswirkung, also sollte es keine große Sache sein. Es wirkt sich nicht auf die Stil- oder Kompositionsübertragung aus, sondern nur auf lineare Generationen. Ich berichte im Allgemeinen nicht über kleine Fehlerbehebungen, aber diese kann zu unterschiedlichen Ergebnissen führen, daher denke ich, dass sie erwähnenswert ist.

02.08.2024 : Unterstützung für Kolors FaceIDv2. Bitte überprüfen Sie den Beispiel-Workflow für Best Practices.

26.07.2024 : Unterstützung für Bildstapel und Animationen zum ClipVision Enhancer hinzugefügt.

18.07.2024 : Unterstützung für Kolors.

17.07.2024 : Experimenteller ClipVision Enhancer-Knoten hinzugefügt. Es wurde irgendwie vom Artikel „Scaling on Scales“ inspiriert, aber die Umsetzung ist etwas anders. Der neue IPAdapterClipVisionEnhancer versucht, kleine Details zu erfassen, indem er die Einbettungen kachelt (anstelle des Bildes im Pixelraum). Das Ergebnis ist eine visuelle Einbettung mit etwas höherer Auflösung ohne Leistungseinbußen.

11.07.2024 : Experimentelle Übertragung präziser Komposition (Layout) hinzugefügt. Es ist nicht so gut wie Stil. embeds_scaling hat einen großen Einfluss. Beginnen Sie mit einer Stärke von 0,8 und steigern Sie 0,3 in SDXL und 0,6 steigern Sie 0,35 in SD1,5.

28.06.2024 : Der IPAdapter Precise Style Transfer Knoten wurde hinzugefügt. Erhöhen Sie die Option style_boost um das Ausbluten der Kompositionsebene zu verringern. Wichtig: Funktioniert besser in SDXL, beginnen Sie mit einem style_boost von 2; Versuchen Sie für SD1.5, die Gewichtung etwas über 1,0 zu erhöhen und legen Sie style_boost auf einen Wert zwischen -1 und +1 fest, beginnend mit 0.

22.06.2024 : style transfer precise hinzugefügt, sorgt für weniger Ausbluten der Einbettungen zwischen den Stil- und Kompositionsebenen. Dies ist manchmal besser als die Standardstilübertragung, insbesondere wenn sich das Referenzbild stark vom generierten Bild unterscheidet. Funktioniert besser in SDXL als SD1.5.

21.05.2024 : Verbesserte Speicherzuweisung bei encode_batch_size . Nützlich vor allem für sehr lange Animationen.

02.05.2024 : encode_batch_size zum erweiterten Batch-Knoten hinzufügen. Dies kann bei Animationen mit vielen Frames nützlich sein, um die VRAM-Nutzung während der Bildkodierung zu reduzieren. Bitte beachten Sie, dass die Ergebnisse je nach Chargengröße leicht abweichen können.

27.04.2024 : Die IPAdapterWeights wurden überarbeitet, die vor allem für AnimateDiff-Animationen nützlich sind.

21.04.2024 : Regionale Konditionierungsknoten hinzugefügt, um Aufmerksamkeitsmaskierung und maskierte Textkonditionierung zu vereinfachen.

16.04.2024 : Unterstützung für das neue SDXL-Porträt-Unnorm-Modell hinzugefügt (Link unten). Es ist sehr stark und neigt dazu, die Textkonditionierung zu ignorieren. Senken Sie den CFG auf 3-4 oder verwenden Sie einen RescaleCFG-Knoten.

(Ältere Updates wurden aus Gründen der Lesbarkeit entfernt)

Das Beispielverzeichnis enthält viele Workflows, die alle IPAdapter-Funktionen abdecken.

Neue IPAdapter-Funktionen

IPAdapter-Stil und Zusammensetzung

Die folgenden Videos beziehen sich auf die Vorgängerversion von IPAdapter, enthalten aber dennoch wertvolle Informationen.

Grundlegendes Nutzungsvideo, ? Video zu erweiterten Funktionen, ? Achtung Maskierungsvideo, ? Video mit Animationsfunktionen

Laden Sie dieses Repository herunter oder klonen Sie es im Verzeichnis ComfyUI/custom_nodes/ oder verwenden Sie den Manager. IPAdapter erfordert immer die neueste Version von ComfyUI. Wenn etwas nicht funktioniert, führen Sie unbedingt ein Upgrade durch. Beachten Sie, dass die automatische Aktualisierung des Managers manchmal nicht funktioniert und Sie möglicherweise manuell aktualisieren müssen.

Es gibt jetzt einen Unified Model Loader . Damit er funktioniert, müssen Sie die Dateien genau wie unten beschrieben benennen. Die Legacy-Loader funktionieren mit jedem Dateinamen, Sie müssen sie jedoch manuell auswählen. Die Modelle können in Unterverzeichnissen abgelegt werden.

Denken Sie daran, dass Sie auch jede benutzerdefinierte Speicherorteinstellung als ipadapter Eintrag in der Datei extra_model_paths.yaml verwenden können.

/ComfyUI/models/clip_vision

CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors, herunterladen und umbenennen

CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors, herunterladen und umbenennen

clip-vit-large-patch14-336.bin, nur für Kolors-Modelle herunterladen und umbenennen

/ComfyUI/models/ipadapter , erstellen Sie es, falls nicht vorhanden

ip-adapter_sd15.safetensors, Basismodell, durchschnittliche Stärke

ip-adapter_sd15_light_v11.bin, Light-Impact-Modell

ip-adapter-plus_sd15.safetensors, Plus-Modell, sehr stark

ip-adapter-plus-face_sd15.safetensors, Gesichtsmodell, Porträts

ip-adapter-full-face_sd15.safetensors, Stärkeres Gesichtsmodell, nicht unbedingt besser

ip-adapter_sd15_vit-G.safetensors, Basismodell, erfordert BigG Clip Vision Encoder

ip-adapter_sdxl_vit-h.safetensors, SDXL-Modell

ip-adapter-plus_sdxl_vit-h.safetensors, SDXL plus-Modell

ip-adapter-plus-face_sdxl_vit-h.safetensors, SDXL-Gesichtsmodell

ip-adapter_sdxl.safetensors, Vit-G SDXL-Modell, erfordert BigG Clip Vision Encoder

Veraltetes ip-adapter_sd15_light.safetensors, v1.0 Light-Impact-Modell

Für FaceID -Modelle ist insightface erforderlich. Sie müssen es in Ihrer ComfyUI-Umgebung installieren. Überprüfen Sie dieses Problem, um Hilfe zu erhalten. Denken Sie daran, dass die meisten FaceID-Modelle auch eine LoRA benötigen.

Damit der Unified Loader funktioniert, müssen die Dateien genau so benannt werden, wie in der Liste unten gezeigt.

/ComfyUI/models/ipadapter

ip-adapter-faceid_sd15.bin, Basis-FaceID-Modell

ip-adapter-faceid-plusv2_sd15.bin, FaceID plus v2

ip-adapter-faceid-portrait-v11_sd15.bin, Textübertragung im Eingabeaufforderungsstil für Porträts

ip-adapter-faceid_sdxl.bin, SDXL-Basis-FaceID

ip-adapter-faceid-plusv2_sdxl.bin, SDXL plus v2

ip-adapter-faceid-portrait_sdxl.bin, Übertragung im SDXL-Textaufforderungsstil

ip-adapter-faceid-portrait_sdxl_unnorm.bin, sehr starke Stilübertragung, nur SDXL

Veraltete ip-adapter-faceid-plus_sd15.bin, FaceID plus v1

Veraltete ip-adapter-faceid-portrait_sd15.bin, v1 des Porträtmodells

Die meisten FaceID-Modelle erfordern eine LoRA. Wenn Sie die IPAdapter Unified Loader FaceID verwenden, wird diese automatisch geladen, wenn Sie die Namenskonvention befolgen. Andernfalls müssen Sie sie manuell laden. Achten Sie darauf, dass jedes FaceID-Modell mit seiner eigenen spezifischen LoRA gekoppelt werden muss.

/ComfyUI/models/loras

ip-adapter-faceid_sd15_lora.safetensors

ip-adapter-faceid-plusv2_sd15_lora.safetensors

ip-adapter-faceid_sdxl_lora.safetensors, SDXL FaceID LoRA

ip-adapter-faceid-plusv2_sdxl_lora.safetensors, SDXL plus v2 LoRA

Veraltete ip-adapter-faceid-plus_sd15_lora.safetensors, LoRA für das veraltete FaceID plus v1-Modell

Alle Modelle finden Sie auf Huggingface.

Die Community hat einige interessante IPAdapter-Modelle gebacken.

/ComfyUI/models/ipadapter

ip_plus_composition_sd15.safetensors, allgemeine Komposition ohne Berücksichtigung von Stil und Inhalt, mehr darüber hier

ip_plus_composition_sdxl.safetensors, SDXL-Version

Kolors-IP-Adapter-Plus.bin, IPAdapter Plus für das Kolors-Modell

Kolors-IP-Adapter-FaceID-Plus.bin, IPAdapter FaceIDv2 für Kolors-Modell. Hinweis: Kolors ist auf dem InsightFace antelopev2 -Modell trainiert. Sie müssen es manuell herunterladen und im Verzeichnis models/inisghtface ablegen.

Wenn Sie andere Modelle kennen, lassen Sie es mich bitte wissen und ich werde sie dem Unified Loader hinzufügen.

Im Beispielverzeichnis sind viele Workflows enthalten. Bitte überprüfen Sie diese, bevor Sie um Unterstützung bitten.

Normalerweise ist es eine gute Idee, das weight auf mindestens 0.8 zu senken und die Anzahl der Schritte zu erhöhen. Um die Einhaltung der Eingabeaufforderung zu verbessern, können Sie versuchen, den Gewichtungstyp im IPAdapter Advanced -Knoten zu ändern.

Ich dokumentiere (langsam) alle Knoten. Bitte überprüfen Sie die Knotenreferenz.

Bitte überprüfen Sie die Fehlerbehebung, bevor Sie ein neues Problem veröffentlichen. Denken Sie auch daran, die zuvor geschlossenen Probleme zu überprüfen.