llm agent

1.0.0

RAG-basiertes LLM nutzt Langzeitgedächtnis durch Vektordatenbank

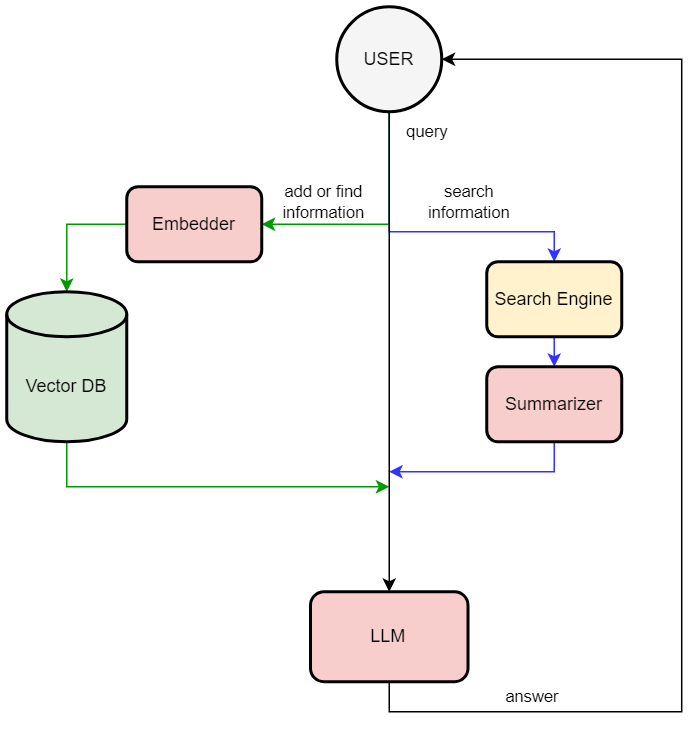

Dieses Repository ermöglicht es dem großen Sprachmodell, das Langzeitgedächtnis über eine Vektordatenbank zu nutzen (diese Methode wird RAG (Retrieval Augmented Generation) genannt – dies ist eine Technik, die es LLM ermöglicht, Fakten aus einer externen Datenbank abzurufen). Die Anwendung wurde mit mistral-7b-instruct-v0.2.Q4_K_M.gguf (unter Verwendung der LLAMA_cpp_python-Bindung) und chromadb erstellt. Der Benutzer kann in natürlicher Sprache darum bitten, Informationen zur Datenbank hinzuzufügen, Informationen in der Datenbank oder im Internet mithilfe von Anleitungen zu finden.

You > Hi

LOG: [Response]

Bot < Hello! How can I assist you today?

You > Please add information to db "The user name is Rustam Akimov"

LOG: [Adding to memory]

Bot < Done!

You > Can you find on the Internet who is Pavel Durov

LOG: [Extracting question]

LOG: [Searching]

LOG: [Summarizing]

Bot < According to the search results provided, Pavel Durov is a Russian entrepreneur who co-founded Telegram Messenger Inc.

You > Please find information in db who is Rustam Akimov

LOG: [Extracting question]

LOG: [Querying memory]

Bot < According to the input memories, your name is Rustam Akimov.