KI generiert Romane mit einem Klick

Über das Projekt • Änderungsprotokoll • Eingabeaufforderung zur Neugenerierung • Schnellstart • Anleitung zur Demo-Nutzung • Beitrag

Das Projekt umfasst einen Romangenerator, der auf großen Sprachmodellen wie GPT basiert, sowie verschiedene Eingabeaufforderungen und Tutorials zur Romangenerierung. Wir freuen uns über Community-Beiträge und aktualisieren sie ständig, um das beste Roman-Schreiberlebnis zu bieten.

Long-Novel-GPT ist ein neuartiger Generator, der auf großen Sprachmodellen wie GPT basiert. Es verwendet eine hierarchische Gliederungs-/Kapitel-/Textstruktur, um die kohärente Handlung des Romans zu erfassen. Es erhält den Kontext durch eine präzise Zuordnung von Gliederung->Kapitel->Text und optimiert so die API-Aufrufkosten und optimiert es kontinuierlich auf der Grundlage seines eigenen Feedbacks oder des Benutzer-Feedbacks . , bis Sie den Roman in Ihrem Kopf erschaffen.

Strukturiertes Schreiben : Die hierarchische Struktur erfasst effektiv den Entwicklungskontext des Romans.

Reflexionszyklus : Optimieren Sie kontinuierlich die generierte Gliederung, die Kapitel und den Textinhalt

Kostenoptimierung : Intelligentes Kontextmanagement sorgt für feste API-Aufrufkosten

Community-gesteuert : Willkommen, Anregungen und Verbesserungsvorschläge einzubringen, um gemeinsam die Entwicklung des Projekts voranzutreiben

Online-Demo: Long-Novel-GPT-Demo

Unterstützt die individuelle Neuerstellung ausgewählter Absätze während des Verfassens (durch Zitieren von Text)

Die Generierung der Eingabeaufforderungen für Gliederungen, Kapitel und Haupttext wurde optimiert.

Für Gliederung, Kapitel und Text stehen drei integrierte Eingabeaufforderungen zur Auswahl: Neu, Erweitert und Poliert

Unterstützt die Eingabe Ihrer eigenen Eingabeaufforderung

Die Interaktionslogik der sofortigen Vorschau ist besser

Unterstützt die Ein-Klick-Generierung und hilft Ihnen automatisch bei der Generierung aller Gliederungen, Kapitel und Texte.

Unterstützung für das GLM-Modell hinzugefügt

Unterstützung für mehrere große Sprachmodelle hinzugefügt:

OpenAI-Serie: o1-preivew, o1-mini, gpt4o usw.

Claude-Reihe: Claude-3.5-Sonett usw.

Wen Xinyiyan: ERNIE-4.0, ERNIE-3.5, ERNIE-Roman

Sitzsack: Doubao-Lite/Pro-Serie

Unterstützt jedes benutzerdefinierte Modell, das mit der OpenAI-Schnittstelle kompatibel ist

Die Generierungsoberfläche und das Benutzererlebnis wurden optimiert

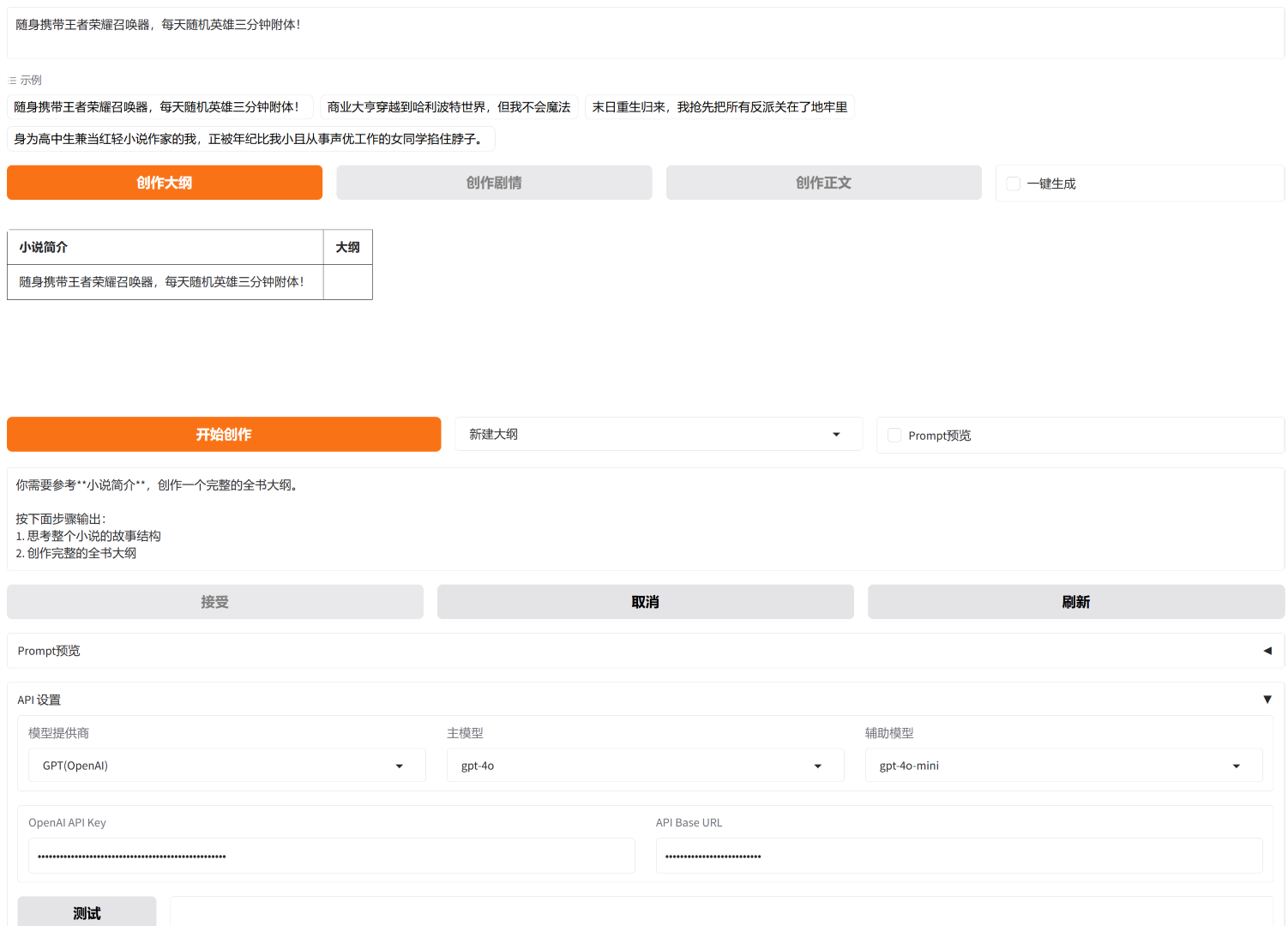

Demo unterstützt mehrere große Sprachmodelle (das Bild zeigt die API-Einstellungsschnittstelle)

Um die direkte Generierung des gesamten Buches aus einem Ideensatz zu unterstützen, steht eine Online-Demo zur Verfügung.

Erwägen Sie eine schönere und praktischere Bearbeitungsoberfläche (abgeschlossen)

Unterstützen Sie das Wenxin Novel-Modell (abgeschlossen)

Stützsitzsackmodell (abgeschlossen)

Mit einem Klick aus einer Idee direkt einen kompletten Roman generieren (in Bearbeitung)

Unterstützung bei der Erstellung von Gliederungen und Kapiteln (in Bearbeitung)

Long-Novel-GPT 1.5 und frühere Versionen bieten eine vollständige APP der neuartigen Generation, aber das Bedienerlebnis ist nicht perfekt. Ab Version 1.6 werden wir der Benutzererfahrung mehr Aufmerksamkeit schenken, eine neue Benutzeroberfläche neu schreiben und die Projektdateien in das Kernverzeichnis verschieben. Die vorherige Demo wird nicht mehr unterstützt. Wenn Sie sie ausprobieren möchten, können Sie den vorherigen Commit zum Herunterladen auswählen.

| Prompt | beschreiben |

|---|---|

| Cecilia-Kartoffel-Art | Wird zum Erstellen von Text basierend auf der Gliederung verwendet und imitiert den Schreibstil von Tiancan Tudou |

| Polieren Sie den Entwurf | Polieren und verbessern Sie den ersten Entwurf Ihres Online-Artikels |

Senden Sie Ihre Aufforderung

Keine Installation erforderlich, erleben Sie jetzt unsere Online-Demo: Long-Novel-GPT Demo

Multithread-Parallelerstellung (das Bild zeigt die Szene der Texterstellung)

Unterstützt die Anzeige von Eingabeaufforderungen (das Bild ist die Antwort des o1-Vorschaumodells)

Wenn Sie Long-Novel-GPT lokal ausführen möchten:

conda create -n lngpt python conda lngpt aktivieren pip install -r Anforderungen.txt

cd Long-Novel-GPT pythoncore/frontend.py

Besuchen Sie nach dem Start einfach den Link im Browser: http://localhost:7860/

Ja, Long-Novel-GPT-1.9 nutzt die Multi-Thread-Generierung und verwaltet den Kontext automatisch, um die Kontinuität der generierten Plots sicherzustellen. In Version 1.7 müssen Sie es lokal bereitstellen, Ihren eigenen API-Schlüssel verwenden und die maximale Anzahl von Threads konfigurieren, die während der Generierung in config.py verwendet werden.

MAX_THREAD_NUM = 5 # Maximale Anzahl der während der Generierung verwendeten Threads

Eine Online-Demo ist nicht möglich, da die maximale Anzahl an Threads 5 beträgt.

Zuerst müssen Sie es lokal bereitstellen, den API-Schlüssel konfigurieren und Thread-Einschränkungen aufheben.

Dann müssen Sie in der Phase der Gliederungserstellung etwa 40 Plotzeilen generieren, jede Zeile hat 50 Wörter, also sind es hier 2.000 Wörter. ( Erweitern Sie die gesamte Gliederung durch kontinuierliches Klicken)

Zweitens wurde während der Handlungserstellungsphase die Gliederung von 2.000 Wörtern auf 20.000 Wörter erweitert. (10+ Threads parallel)

Schließlich werden in der Texterstellungsphase die 20.000 Wörter auf 100.000 Wörter erweitert. (50+ Threads parallel)

Version 1.7 ist die erste Version, die die Generierung von Millionen-Level-Romanen unterstützt. Sie garantiert hauptsächlich Multithread-Verarbeitung, Generierungsfensterverwaltung und bietet eine vollständige Schnittstelle.

Version 1.9 verfügt über stark optimierte Eingabeaufforderungen und bietet drei Arten von Eingabeaufforderungen: neue, erweiterte und verbesserte Eingabeaufforderungen, aus denen Benutzer auswählen können. Außerdem werden Eingabeaufforderungen unterstützt.

Im Allgemeinen kann Version 1.9 unter Benutzeraufsicht Webartikel generieren, die den Vertragsschwellenwert erfüllen.

Unser oberstes Ziel ist es immer, mit einem Klick das gesamte Buch zu generieren, das nach 2-3 Versionsiterationen offiziell veröffentlicht wird.

Derzeit unterstützt die Demo GPT, Claude, Wenxin, Doubao, GLM und andere Modelle, und der API-Schlüssel wurde konfiguriert. Das Standardmodell ist GPT4o und die maximale Anzahl von Threads beträgt 5.

Sie können eine beliebige Idee im Beispiel auswählen und auf „Gliederung erstellen“ klicken, um die Gliederung zu initialisieren.

Klicken Sie nach der Initialisierung auf die Schaltfläche „Erstellung starten“ , um mit der Erstellung der Gliederung fortzufahren, bis Sie zufrieden sind.

Nachdem Sie die Gliederung erstellt haben, klicken Sie auf die Schaltfläche „Diagramm erstellen“ und wiederholen Sie dann den obigen Vorgang.

Nachdem Sie die Ein-Klick-Generierung ausgewählt haben, klicken Sie erneut auf die Schaltfläche links, um die Ein-Klick-Generierung zu generieren.

Wenn Sie auf ungelöste Probleme stoßen, klicken Sie auf die Schaltfläche „Aktualisieren“ .

Wenn das Problem immer noch nicht behoben werden kann, aktualisieren Sie bitte die Browserseite. Dies führt zum Verlust aller Daten. Bitte sichern Sie wichtige Texte manuell.

Wir freuen uns über alle Arten von Beiträgen, egal ob Vorschläge für neue Funktionen, Code-Verbesserungen oder Fehlerberichte. Bitte kontaktieren Sie uns über GitHub-Probleme oder Pull-Requests.

Sie können auch der Gruppe beitreten und in der Gruppe diskutieren.