Linienzeichnung, Segmentierung, Stilübertragung und Hochskalierung mit Stable Diffusion!

Mit dieser GUI können Bilder aus einfachen Pinselstrichen oder Bezier-Kurven in Echtzeit generiert werden. Die Funktionen wurden hauptsächlich für den Einsatz in der Architektur und zum Skizzieren in den frühen Phasen eines Projekts entwickelt. Es nutzt Stable Diffusion und ControlNet als KI-Rückgrat für den generativen Prozess. IP-Adapter-Unterstützung ist ebenso enthalten wie eine große Bibliothek vordefinierter Stile! Mit jedem Referenzbild können Sie einen bestimmten Stil auf Ihre Linienarbeit übertragen. Außerdem wurde eine Upscale-Funktion hinzugefügt, um Ergebnisse in hoher Auflösung zu exportieren (basierend auf ControlNet-Kacheln).

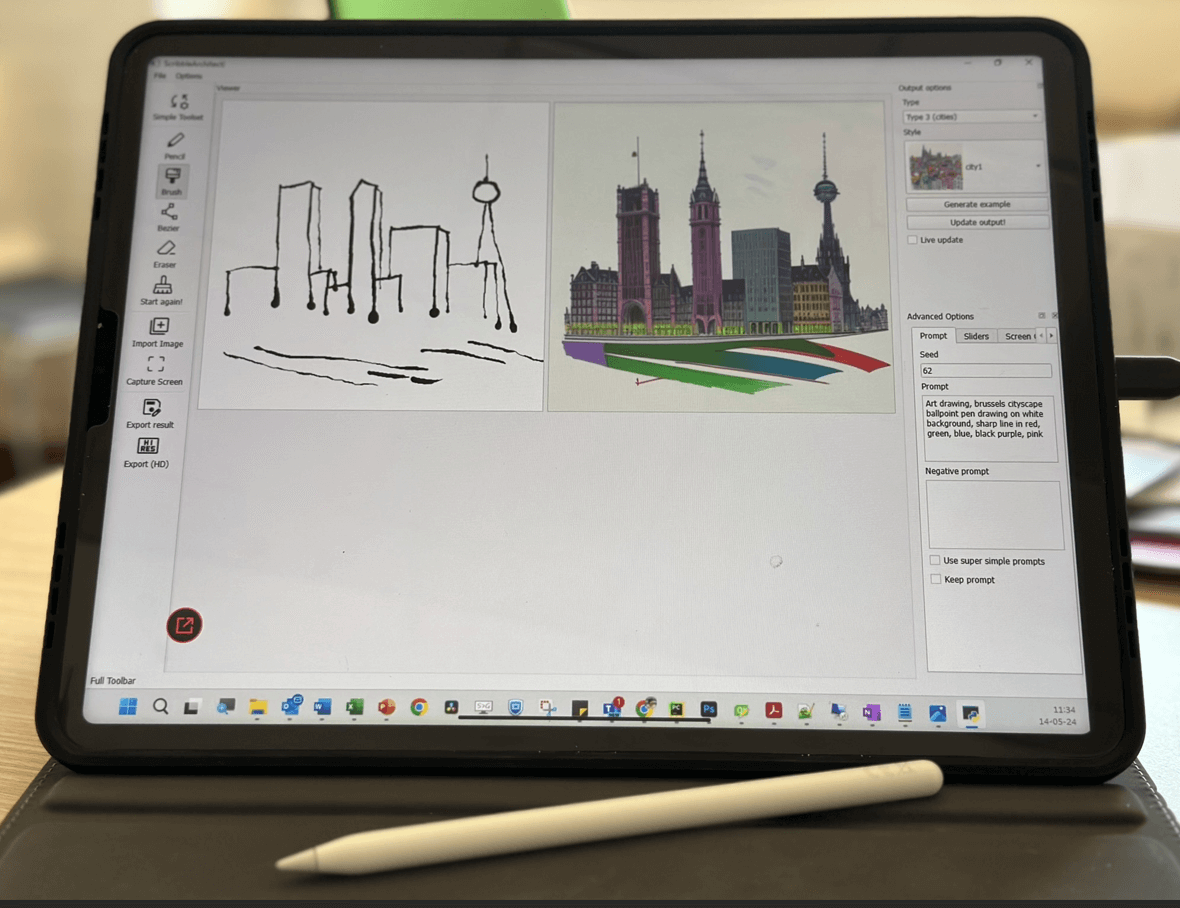

Beispiel für Live-Zeichnung

Beispiel für den Stilwechsel (Interieur)

Beispiel für den Stilwechsel (außen)

Viele neue Funktionen wurden kürzlich hinzugefügt:

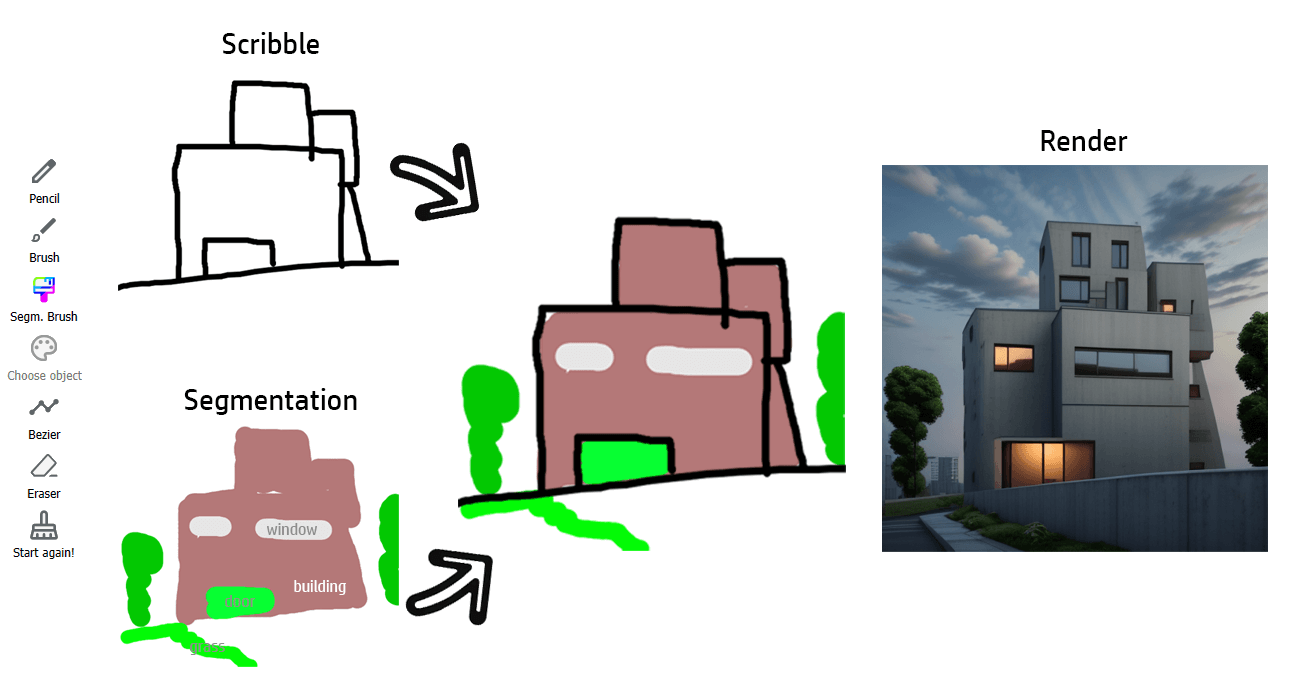

Wir haben kürzlich ein neues Ebenensystem integriert, mit dem der Benutzer entweder schwarze Linien (für die Eingabe von ControlNet Scribble) oder farbige Pinselstriche (für die ControlNet-Segmentierung) zeichnen kann. Siehe „Verwenden der App“. HINWEIS: Die alte Version finden Sie weiterhin im Abschnitt „Releases“.

Wählen Sie einen architektonischen Entwurfstyp (Außenputz, Fassadenansicht, Innenputz, ...) und einen Stil. Auf der linken Seite finden Sie den Zeichenbereich. Sie können entweder schwarze Linien hinzufügen, um die wichtigen Linien Ihrer Zeichnung zu definieren, oder farbige Zonen (eine semantische Karte), um zu definieren, wo bestimmte Objekte platziert werden sollen (ein Baum, ein Fenster usw.). Jedem Objekttyp ist ein bestimmter Farbcode zugeordnet. Sie müssen sich keine Gedanken über die Auswahl der richtigen Farbe machen, da Sie über die grafische Oberfläche das zu zeichnende Objekt direkt auswählen können. Der Zeichenvorgang selbst ist völlig Standard. Wählen Sie Ihr Werkzeug und zeichnen Sie! (oder löschen). Sie sehen die vorgeschlagene Bildanpassung live (über ein Kontrollkästchen können Sie die Live-Inferenz deaktivieren).

Beispiel für die Verwendung eines Segmentierungspinsels (Innenraum)

Wenn Sie keine Inspiration haben oder zu Testzwecken, kann automatisch eine Beispielskizze generiert werden.

Bilder können auch importiert werden, um automatisch Scribbles und/oder Segmentierungen zu generieren.

Wir haben auch eine Bildschirmaufnahmefunktion hinzugefügt. Es wird ein Erfassungsfeld (blauer Rand) erstellt, das verschoben werden kann und auf der Grundlage der erfassten Zone Kritzeleien generiert. Wenn Sie mit der Aufnahme zufrieden sind, klicken Sie erneut auf das Tool, um es zu deaktivieren. Es ermöglicht die Arbeit mit leistungsstarken Werkzeugen als Eingabe (Adobe Illustrator, Inkscape, ...).

Bildschirmaufnahmefunktion mit Inkscape als Eingabe

Dank eines ControlNet-Upscalers kann das Rendering in hoher Auflösung exportiert werden. Weitere Optionen werden in Kürze integriert!

Upscaling (künstlerischer Außenputz)

Upscaling (realistische Innendarstellung)

Unterstützung für Zeichenmedien ist seit Kurzem enthalten. Der Druck des Stifts sollte erfasst werden. Getestet auf Ipad Pro + EasyCanvas.

Live-Zeichnen erfordert eine starke GPU. Ich würde empfehlen, die Bildgröße (in main.py) zu reduzieren, wenn die Verzögerung zu groß ist! Die Hochskalierung von Bildern ist wirklich GPU-intensiv ...

Standardmäßig verwendet die App Dreamshaper (https://huggingface.co/Lykon/dreamshaper-8). Benutzerdefinierte Modelle können im speziellen Ordner („custom_models“) hinzugefügt werden. Jeder SD1.5-Prüfpunkt sollte funktionieren.

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

(siehe https://pytorch.org/get-started/locally/)

pip install git+https://github.com/sberbank-ai/Real-ESRGAN.git

https://huggingface.co/lllyasviel/sd-controlnet-seg https://huggingface.co/lllyasviel/sd-controlnet-scribble