? Fragen Sie den Sage Python Client v1.2.4

Willkommen im Ask Sage Overview-Repository! ?

Dieses Repository ist ein in Arbeit befindliches Projekt? und soll eine Sammlung von Beispielcode ? und Dokumentation sein ? zur Interaktion mit Ask Sage über die Ask Sage API. Zusätzlicher Inhalt kann tatsächliche Schritte umfassen? innerhalb der Ask Sage-Plattform, aber größtenteils wird sich dieses Repository auf die Nutzung der API und die Erstellung von Mini-Proof-of-Concept-Projekten konzentrieren.

Die bereitgestellten Beispiele decken ein breites Themenspektrum im Zusammenhang mit generativer KI ab und sind so gestaltet, dass sie für Benutzer mit unterschiedlichem Erfahrungsniveau im Bereich KI und Programmierung zugänglich sind. Im Moment haben wir eine Liste mit Ideen bereitgestellt, die in diesem Repository behandelt werden. Diese Liste wird aktualisiert, sobald weitere Inhalte hinzugefügt werden.

Hinweis: Für zahlende Abonnenten steht nur die Ask Sage API zur Verfügung. ??

Dies ist eine von der Community betriebene Initiative, um Benutzern von Ask Sage zusätzliche Ressourcen und Beispiele bereitzustellen.

Besuchen Sie hier die offizielle AskSage-Website.

Wenn Sie daran interessiert sind, zu diesem Repository beizutragen, lesen Sie bitte die Beitragsrichtlinien für weitere Informationen.

Wenn Sie Fragen haben oder Hilfe benötigen, können Sie sich gerne an die Betreuer dieses Repositorys oder direkt an das Ask Sage-Team wenden.

Zusätzliche Ressourcen:

Hinweis: Der Inhalt dieses Repositorys ist möglicherweise veraltet oder falsch. Aktuelle Informationen finden Sie daher in der offiziellen AskSage-Dokumentation.

AskSage ist eine agnostische generative KI-Plattform, die Zugriff auf eine breite Palette von KI-Modellen und -Tools bietet. Die Plattform ist so konzipiert, dass sie einfach zu bedienen und in bestehende Arbeitsabläufe integrierbar ist und weiter an die Bedürfnisse des Benutzers/der Organisation angepasst werden kann.

Ask Sage ist einzigartig auf Agnostik ausgelegt und bietet Zugriff auf eine breite Palette von Modellen, die für eine Vielzahl von Aufgaben verwendet werden können. Zu den verfügbaren Modellen gehören unter anderem:

| Modellname | Beschreibung |

|---|---|

| Azure OpenAI | Hochmoderne Sprachmodelle, die von OpenAI entwickelt und auf der Azure-Plattform gehostet werden. |

| Azure Gov OpenAI | Hochmoderne Sprachmodelle, die von OpenAI entwickelt und auf der Azure Gov-Plattform gehostet werden. |

| Google Gemini Pro | Von Google entwickelte und für verschiedene Aufgaben der Verarbeitung natürlicher Sprache optimierte Sprachmodelle. |

| LLMA3 | Ein von Meta entwickeltes großes Sprachmodell, das sich durch die Generierung hochwertiger Texte auszeichnet. |

| Mistral | Ein leistungsstarkes, von Mistral entwickeltes Sprachmodell, das kreative und kohärente Texte generieren kann. |

| Claude 3 | Ein von Anthropic entwickeltes Sprachmodell, das sich auf die Generierung von Code und programmbezogenem Text konzentriert. |

| Zusammenhängen | Ein von Cohere Technologies entwickeltes Sprachmodell, das auf die Generierung von Code spezialisiert ist. |

| OpenAI Whisper | Ein von OpenAI entwickeltes Sprachmodell, das Speech-to-Text-Funktionen ermöglicht. |

| DALL-E v3 | Ein von OpenAI entwickeltes Sprachmodell, das auf die Generierung von Bildern spezialisiert ist. |

Hier ist die aktuelle Liste der verfügbaren Modelle auf der Ask Sage-Plattform mit Stand vom 22. Oktober 2024:

models = [ 'aws-bedrock-titan' , 'llma3' , 'claude2' , 'claude-3-opus' , 'claude-3-sonnet' , 'claude-35-sonnet' , 'cohere' , 'mistral-large' , 'gpt-gov' , 'gpt4-gov' , 'gpt' , 'gpt4' , 'gpt4-32k' , 'gpt35-16k' , 'gpt4-vision' , 'gpt-4o' , 'gpt-4o-mini' , 'dall-e-2' , 'dall-e-3' , 'google-bison' , 'google-gemini-pro' , 'gpt-4o-gov' , 'groq-70b' , 'gpt-o1' , 'gpt-o1-mini' , 'xai-grok' ]Das Ask Sage-Team kann weitere Modelle hinzufügen, die speziell auf die Bedürfnisse eines Benutzers zugeschnitten sind. (es können zusätzliche Kosten anfallen)

Hinweis: Die oben aufgeführten Modelle können sich ändern und es können in Zukunft weitere Modelle hinzugefügt werden.

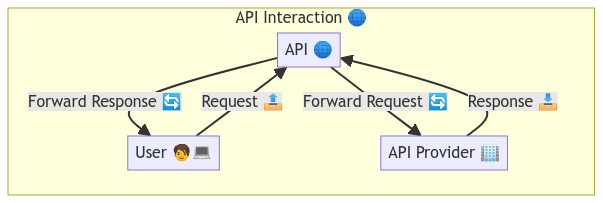

Es gibt zwei Möglichkeiten, mit Ask Sage zu interagieren:

Die Ask Sage API bietet eine RESTful-Schnittstelle für die Interaktion mit den über die Plattform verfügbaren Modellen. Benutzer können Anfragen an die API senden und Antworten im JSON-Format erhalten. Die API ist so konzipiert, dass sie einfach zu verwenden und in bestehende Arbeitsabläufe integrierbar ist.

Insgesamt bietet dieses Repository Einrichtungsanweisungen, Beispiele und andere Ressourcen, wenn man beginnt, die Fähigkeiten der generativen KI zu erkunden und wie sie in realen Szenarien eingesetzt werden kann.

Die Ask Sage API wird mithilfe von Swagger dokumentiert, das detaillierte Informationen zu den verfügbaren Endpunkten, Anforderungsparametern, Antwortformaten und Authentifizierungsmethoden bereitstellt.

Die folgende Tabelle zeigt die verfügbaren Endpunkte in der Benutzer-API:

| Endpunkt | Beschreibung |

|---|---|

| /get-token-with-api-key | Holen Sie sich ein Zugriffstoken mit API-Schlüssel und E-Mail |

| /get-user-logins | Erhalten Sie Ihre letzten Anmeldungen (standardmäßig auf 5 begrenzt) |

| /get-user-logs | Holen Sie sich Ihre letzten Eingabeaufforderungen |

| /add-dataset | Fügen Sie einen neuen Datensatz hinzu |

| /assign-dataset | Weisen Sie einen Datensatz zu |

| /delete-datasets | Löscht einen Datensatz |

Diese Informationen werden zur Interaktion mit der Ask Sage API verwendet. Der Benutzer kann Modelle abfragen, Personas auswählen/abrufen, Datensätze abrufen, Modelle trainieren und mehr.

Die folgende Tabelle zeigt die verfügbaren Endpunkte in der Server-API:

| Endpunkt | Beschreibung |

|---|---|

| /get-models | Gibt eine Liste der verfügbaren Modelle über die Ask Sage-Dienste zurück |

| /Abfrage | Hauptendpunkt zum Generieren von Vervollständigungen basierend auf der Eingabe des Benutzers |

| /query_with_file | Abfrage mit Dateiendpunkt zum Generieren von Vervollständigungen basierend auf der Benutzereingabe |

| /query-plugin | Abfrage mit Plugin-Endpunkt zum Generieren von Vervollständigungen basierend auf den Eingaben des Benutzers |

| /execute-plugin | Führen Sie ein Plugin mit dem bereitgestellten Inhalt aus |

| /follow_up_questions | Endpunkt zum Generieren von Folgefragen basierend auf den Eingaben des Benutzers |

| /tokenizer | Endpunkt zum Abrufen von Token mit Zeichenfolgenwerten |

| /get-personas | Endpunkt zum Abrufen der Token der Zeichenfolge |

| /get-datasets | Gibt eine Liste der verfügbaren Datensätze zurück |

| /get-plugins | Gibt eine Liste der verfügbaren Plugins zurück |

| /get-train | Trainiert das Modell basierend auf der Eingabe des Benutzers |

| /Datei | Konvertiert eine unterstützte Datei in Klartext/Text |

Der Python-API-Client wird über den folgenden Link dokumentiert und verwaltet: https://pypi.org/project/asksageclient/

| Funktionsname | Beschreibung |

|---|---|

get_models | Holen Sie sich die verfügbaren Modelle über den Ask Sage-Service. |

add_dataset | Fügt einen neuen Datensatz hinzu |

delete_dataset | Löscht einen angegebenen Datensatz |

assign_dataset | Weist einen Datensatz zu |

get_user_logs | Ruft alle Protokolle für den Benutzer ab |

get_user_logins | Ruft Anmeldeinformationen für einen bestimmten Benutzer ab |

query | Interagieren Sie mit dem /query-Endpunkt der Ask Sage API. |

query_with_file | Führt eine Abfrage mithilfe einer Datei aus |

query_plugin | Führt eine Abfrage mit einem bestimmten Plugin aus |

execute_plugin | Führt ein Plugin mit dem bereitgestellten Inhalt aus |

follow_up_questions | Interagieren Sie mit dem Endpunkt /follow-up-questions der Ask Sage API. |

tokenizer | Interagieren Sie mit dem /tokenizer-Endpunkt der Ask Sage API. |

get_personas | Holen Sie sich die verfügbaren Personas vom Ask Sage-Dienst. |

get_datasets | Holen Sie sich die verfügbaren Datensätze vom Ask Sage-Dienst. |

get_plugins | Holen Sie sich die verfügbaren Plugins vom Ask Sage-Dienst. |

count_monthly_tokens | Erhalten Sie die Anzahl der monatlichen Trainingstokens, die für diesen Benutzer ausgegeben wurden, über den Ask Sage-Dienst. |

count_monthly_teach_tokens | Zählt die Anzahl der in einem Monat verwendeten Teach-Tokens |

train | Trainieren Sie das Modell basierend auf den bereitgestellten Inhalten. |

train_with_file | Trainieren Sie den Datensatz basierend auf der bereitgestellten Datei. |

file | Laden Sie eine Datei zum Ask Sage-Dienst hoch. |

Im Abschnitt „Beispiele“ stellen wir Beispiele dafür bereit, wie diese Endpunkte verwendet werden, um mit der Ask Sage-API zu interagieren und Text mithilfe der auf der Plattform verfügbaren Modelle zu generieren.

Benutzer können einen API-Schlüssel von der Ask Sage-Plattform erhalten und diesen zum Generieren eines Zugriffstokens verwenden. Der API-Schlüssel ist eine eindeutige Kennung, die zur Authentifizierung des Benutzers und zur Gewährung des Zugriffs auf die API-Endpunkte verwendet wird.

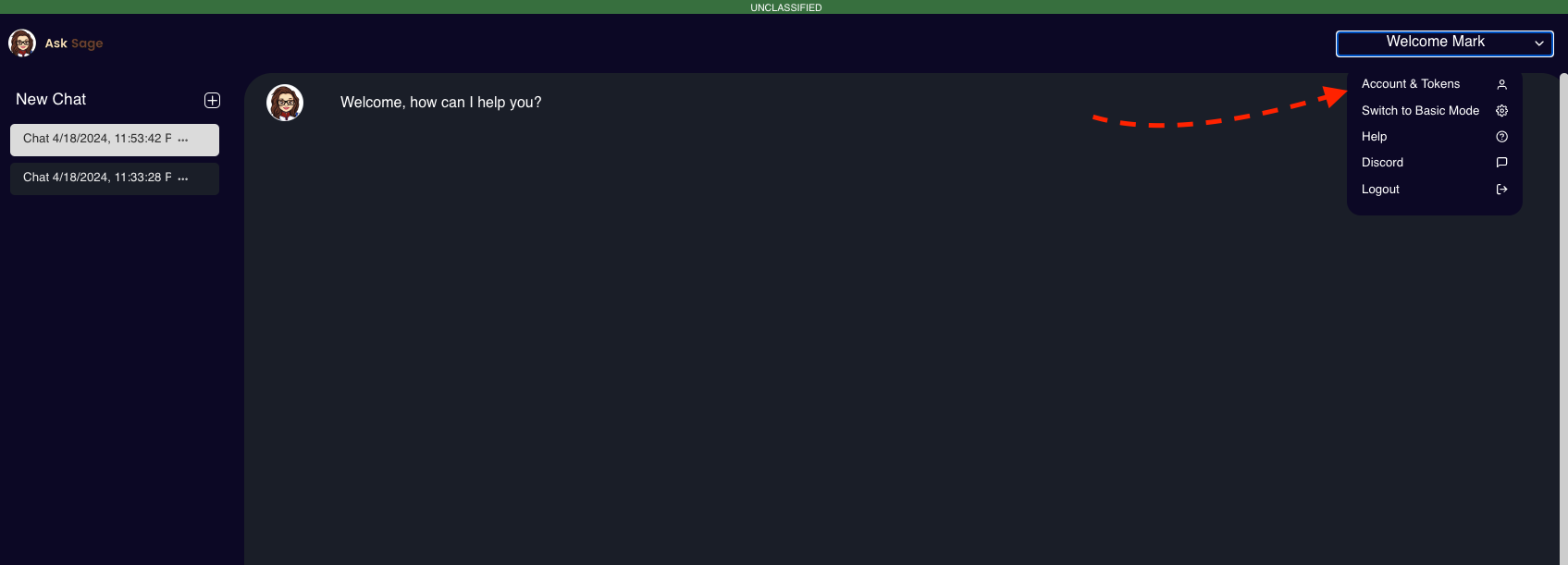

Navigieren Sie zu den Menüoptionen und wählen Sie die Option „Konto & Token“.

Scrollen Sie nach unten zum Abschnitt „API-Schlüssel“ und klicken Sie auf die Schaltfläche „API-Schlüssel generieren“.

Erstellen Sie einen neuen API-Schlüssel, indem Sie auf die Schaltfläche „Neuen API-Schlüssel erstellen“ klicken. Geben Sie einen eindeutigen Namen für den API-Schlüssel ein und klicken Sie auf die Schaltfläche „Senden“.

Der API-Schlüssel wird generiert und auf dem Bildschirm angezeigt. Kopieren Sie den API-Schlüssel und speichern Sie ihn an einem sicheren Ort.

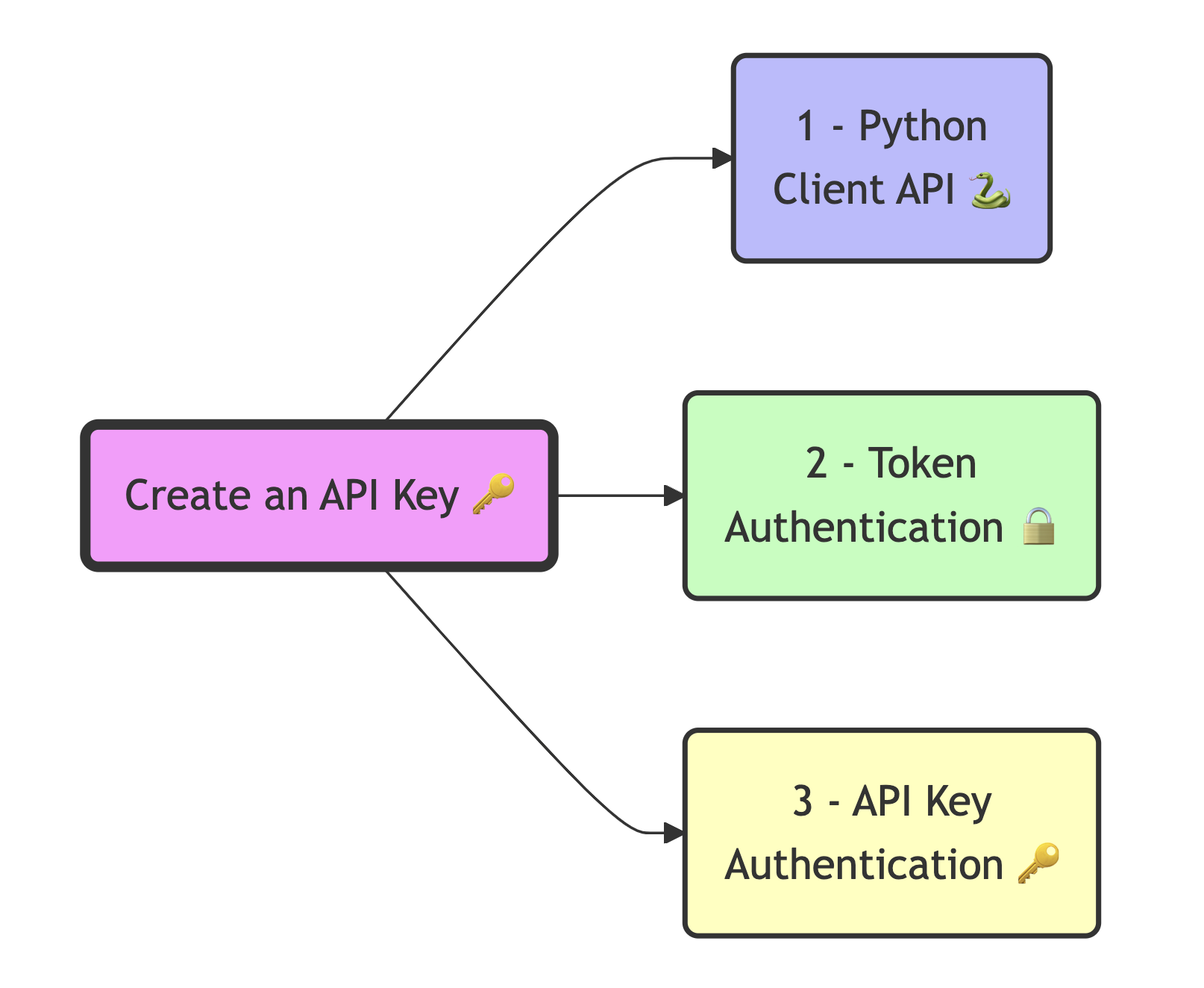

Es gibt drei Methoden, mit denen sich ein Benutzer bei Ask Sage Endpoints authentifizieren kann:

Der API-Schlüssel und die E-Mail-Adresse können zur Authentifizierung des Benutzers und zur Gewährung des Zugriffs über den Ask Sage Python-Client verwendet werden. Der API-Schlüssel und die E-Mail-Adresse des Benutzers werden in die Anforderungsheader aufgenommen.

Der folgende Codeausschnitt zeigt beispielsweise, wie Sie eine Instanz der AskSageClient-Klasse erstellen und sich mithilfe des API-Schlüssels und der E-Mail-Adresse bei der Ask Sage-API authentifizieren:

import json # Import the json module to work with JSON data

import requests # Import the requests library to send HTTP requests

from asksageclient import AskSageClient # Import the AskSageClient class from the asksageclient module

# Function to load credentials from a JSON file

def load_credentials ( filename ):

try :

with open ( filename ) as file :

return json . load ( file )

except FileNotFoundError :

raise FileNotFoundError ( "The credentials file was not found." )

except json . JSONDecodeError :

raise ValueError ( "Failed to decode JSON from the credentials file." )

# Load the credentials

credentials = load_credentials ( '../../credentials.json' )

# Extract the API key, and email from the credentials to be used in the API request

api_key = credentials [ 'credentials' ][ 'api_key' ]

email = credentials [ 'credentials' ][ 'Ask_sage_user_info' ][ 'username' ]

"""

class AskSageClient(

email: email, # The email address of the user

api_key: api_key, # The API key for the Ask Sage API, which can be obtained from the Ask Sage website

user_base_url: str = 'https://api.asksage.ai/user', # The base URL for the user API

server_base_url: str = 'https://api.asksage.ai/server' # The base URL for the server API

)

"""

ask_sage_client = AskSageClient ( email , api_key ) # Create an instance of the AskSageClient class with the email and api_key Nach dieser Einrichtung kann der Benutzer nun über das AskSageClient-Objekt mit der Ask Sage-API interagieren.

Ein Zugriffstoken wird mithilfe des API-Schlüssels und der E-Mail-Adresse mit dem Endpunkt „/get-token-with-api-key“ generiert. Das Zugriffstoken ist 24 Stunden lang gültig und kann zur Authentifizierung von Anfragen an die Ask Sage API verwendet werden.

Dies ist eine sicherere Authentifizierungsmethode, da das Zugriffstoken nur für eine begrenzte Zeit gültig ist und regelmäßig neu generiert werden muss.

Hier ist ein Beispielcode-Snippet in Python, das zeigt, wie Sie mithilfe Ihrer E-Mail-Adresse und Ihres API-Schlüssels ein Zugriffstoken erhalten:

import requests

# Define the endpoint URL

url = "https://api.asksage.ai/user/get-token-with-api-key"

# Define the payload with the user's email and API key

payload = {

"email" : "your_email@your_domain.com" ,

"api_key" : "sdfsdfsfr23456789" # Your API key generated from the Ask Sage platform

}

# Set the headers, if required (e.g., Content-Type)

headers = {

"Content-Type" : "application/json"

}

# Make the POST request

response = requests . post ( url , json = payload , headers = headers )

# Check if the request was successful

if response . status_code == 200 :

# Parse the JSON response

data = response . json ()

# raw response

print ( data )

# Extract the access token only from the response

access_token = data [ 'response' ][ 'access_token' ]

print ( access_token )Das generierte Zugriffstoken kann für die Authentifizierung von Anfragen an die Ask Sage API für die nächsten 24 Stunden verwendet werden. Hier ist ein Beispiel für die Verwendung des Zugriffstokens zur Authentifizierung einer Anfrage an einen der Ask Sage API-Endpunkte:

import requests

# Define the access token obtained from the previous request - Note: You would want to store this securely and not hardcode it in your script/file.

access_token = "fghjkl4567890" # Replace with the actual access token

# Define the endpoint URL

url = "https://api.asksage.ai/user/get-user-logins" # Replace with the actual base URL of the API

# Define the payload with the limit parameter

payload = {

"limit" : 1 # Replace with the desired limit (max is 100)

}

# Set the headers, including the Authorization header with the Bearer token

headers = {

"x-access-tokens" : access_token ,

"Content-Type" : "application/json"

}

# Make the POST request

response = requests . post ( url , json = payload , headers = headers )

# Check if the request was successful

if response . status_code == 200 :

# Parse the JSON response

data = response . json ()

print ( "User Logins:" , data )

else :

print ( f"Failed to get user logins. Status code: { response . status_code } " )

print ( f"Response: { response . text } " )Anstatt jedes Mal ein Zugriffstoken zu generieren, wenn Sie auf die API zugreifen müssen, können Sie den statischen API-Schlüssel dort übergeben, wo das Token erwartet wird. Dies ist nicht so sicher wie die Generierung eines 24-Stunden-Zugriffstokens, aber für einige Anwendungsfälle eine gültige Option.

Hinweis: Die erwartete Header-Variable ist

x-access-tokensund der Wert ist der API-Schlüssel. Es gibt keine zeitliche Begrenzung für den API-Schlüssel, es wird jedoch aus Sicherheitsgründen empfohlen, ihn regelmäßig neu zu generieren.

import requests

# Define the access token obtained from the previous request - Note: You would want to store this securely and not hardcode it in your script/file.

access_token = api_key #

# Define the endpoint URL

url = "https://api.asksage.ai/user/get-user-logins" # Replace with the actual base URL of the API

# Define the payload with the limit parameter

payload = {

"limit" : 1 # Replace with the desired limit (max is 100)

}

# Set the headers, including the Authorization header with the Bearer token

headers = {

"x-access-tokens" : access_token ,

"Content-Type" : "application/json"

}

# Make the POST request

response = requests . post ( url , json = payload , headers = headers )

# Check if the request was successful

if response . status_code == 200 :

# Parse the JSON response

data = response . json ()

print ( "User Logins:" , data )

else :

print ( f"Failed to get user logins. Status code: { response . status_code } " )

print ( f"Response: { response . text } " )Diese Beispiele konzentrieren sich mehr darauf, wie man mit der Ask Sage API interagieren kann und was man in der Antwort erwartet. Darüber hinaus werden einige Miniprojekte erstellt, um die Fähigkeiten der generativen KI und deren Einsatz in realen Szenarien zu demonstrieren. Obwohl sich dieses Repository auf die Ask Sage API konzentriert, sind die Beispiele allgemein genug, um auf andere Plattformen angewendet zu werden, die ähnliche Dienste bereitstellen, aber möglicherweise andere Endpunkte oder Parameter haben.

Hinweis: Die Beispiele konzentrieren sich derzeit eher auf textbasierte Modelle, werden aber auf die Interaktion von LLMs mit anderen Datentypen wie Bildern, Audio und Video (multimodale Modelle) ausgeweitet. Die Auseinandersetzung mit diesen Beispielen führt zu komplexeren Projekten und erfordert mehr Ressourcen und Zeit für die Fertigstellung.

Nach der Installation von Paketen aus requirements.txt müssen Sie möglicherweise Ihren Jupyter-Kernel neu starten, um die aktualisierten Pakete zu verwenden. Dadurch wird sichergestellt, dass die neu installierten Bibliotheken korrekt geladen werden.

✅Fertig✅

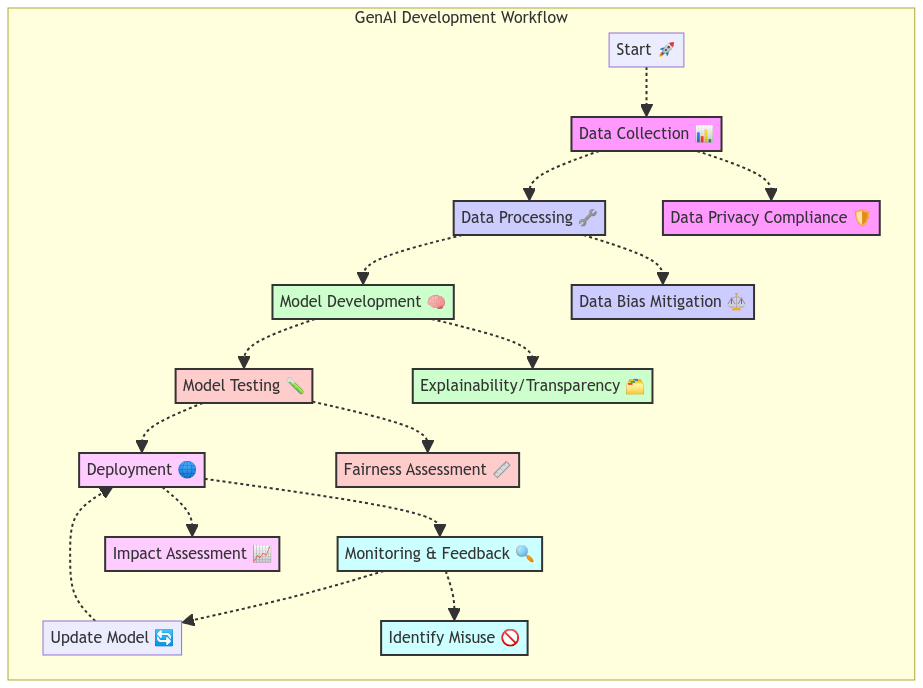

Dabei handelt es sich nicht wirklich um ein Beispiel, sondern vielmehr um eine Diskussion über die ethischen Auswirkungen des Einsatzes von KI und darüber, wie potenzielle Risiken gemindert werden können. Wir legen großen Wert darauf, dass ein Benutzer gut über die Funktionsweise von KI geschult sein muss, vermitteln aber auch ein klares Verständnis dafür, dass das, was durch GenAI-Tools generiert wird, möglicherweise nicht immer korrekt ist.

✅Fertig✅

In diesem Beispiel wird erläutert, wie die Ask Sage API-Endpunkte verwendet werden und was in den Antworten auf allgemeiner Ebene zu erwarten ist. Die folgenden Beispiele zeigen, wie die Endpunkte in realen Szenarien verwendet werden können, um nützliche Anwendungen, Tools oder Dienste zu erstellen.

? Im Baugewerbe? -> Vollständige Veröffentlichung in Kürze verfügbar!

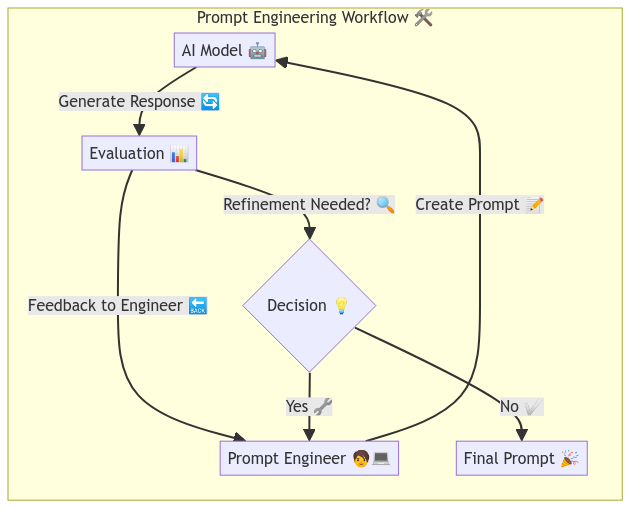

In diesem Beispiel wird erläutert, wie mit einem LLM-Modell interagiert wird und wie mithilfe von Prompt Engineering hochwertiger Text generiert wird, der das Modell bei der Generierung der gewünschten Ausgabe anleitet. Prompt Engineering ist eine leistungsstarke und notwendige Fähigkeit, mit der die Ausgabe eines Sprachmodells gesteuert und Text generiert werden kann, der bestimmte Kriterien oder Anforderungen erfüllt.

? Im Baugewerbe?

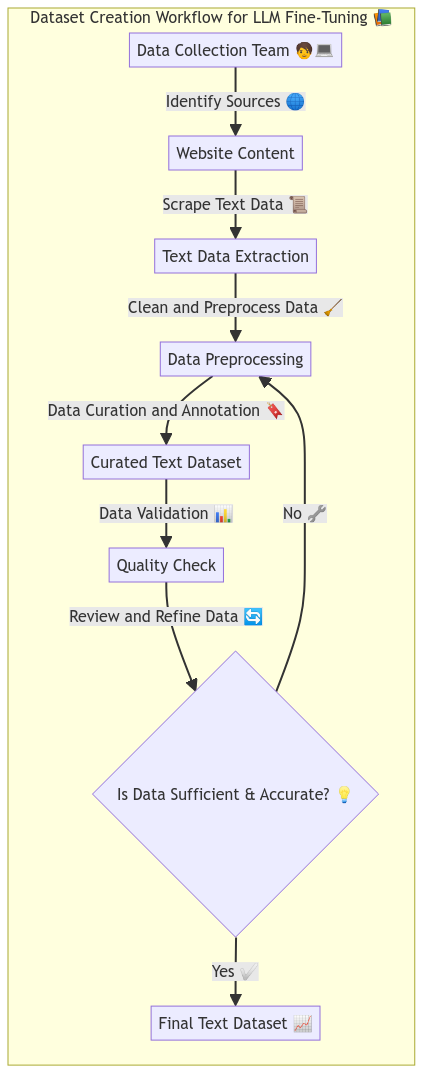

In den meisten Fällen werden LLM-Modelle auf großen Datensätzen trainiert, die ein breites Spektrum an Texten aus verschiedenen Quellen enthalten und bei denen nicht garantiert werden kann, dass sie für die spezifischen Anforderungen des Benutzers relevant sind. Auf Ask Sage können Benutzer jedoch benutzerdefinierte Datensätze erstellen, die Text enthalten, der für ihre Domäne oder ihren Anwendungsfall relevant ist, und ihn mit Methoden wie Retrieval-Augmented Generation (RAG) verwenden, um die Leistung des Modells zu verbessern. Daher wird in diesem Beispiel erläutert, wie ein benutzerdefinierter Datensatz erstellt und mit einem LLM-Modell verwendet wird, um Text zu generieren, der für die Bedürfnisse des Benutzers relevanter ist. Detailliertere Informationen werden im Beispiel darüber bereitgestellt, wie das Modell funktioniert bzw. in den Datensatz integriert wird.

? Im Baugewerbe?

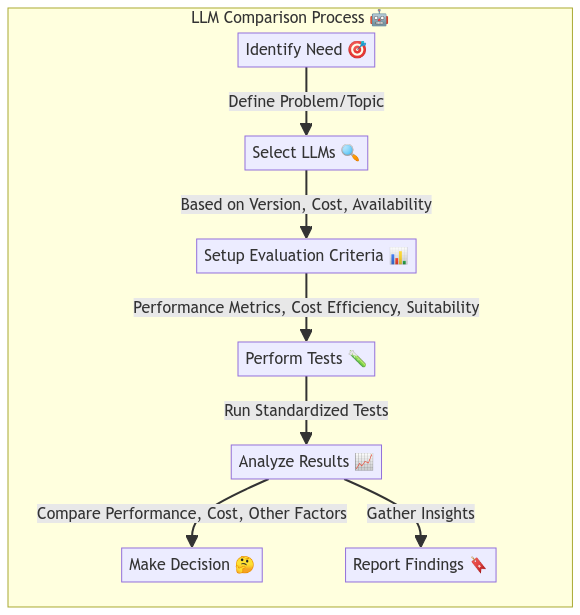

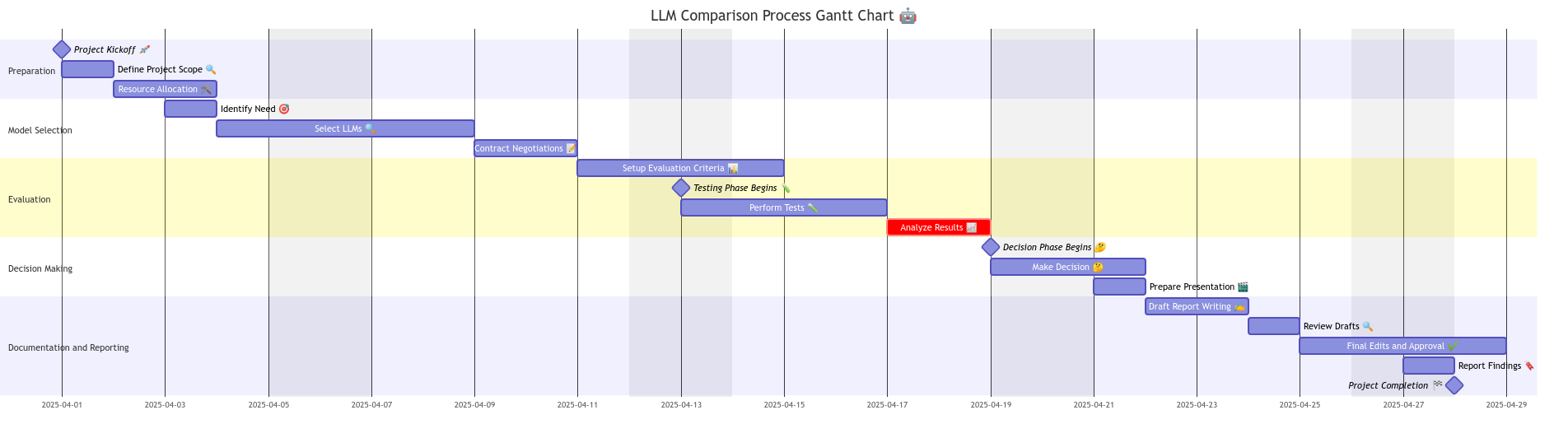

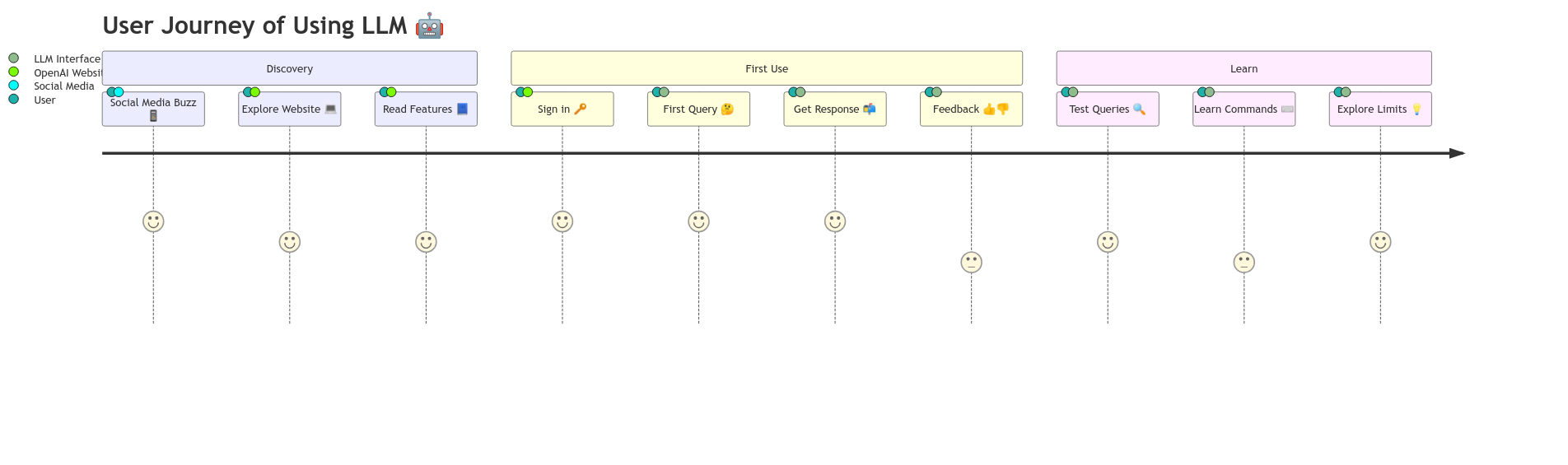

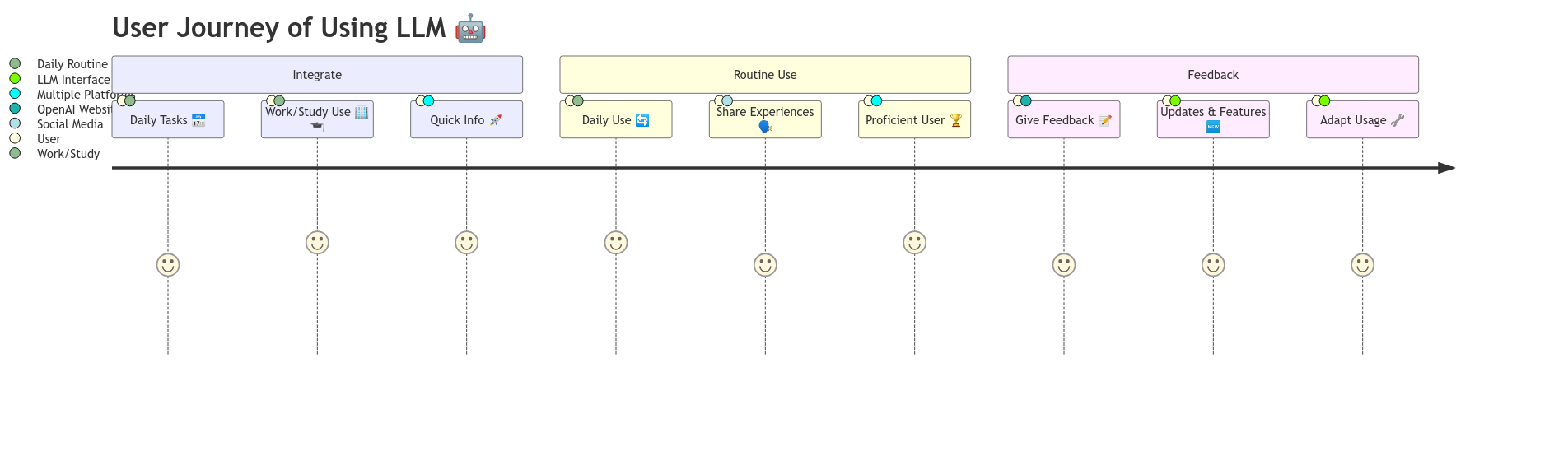

Die Zahl der heute verfügbaren LLM-Modelle ist riesig und wird weiter wachsen, da mehr Forschung im Bereich der generativen KI betrieben wird. In diesem Beispiel wird erläutert, wie verschiedene LLM-Modelle mit der agnostischen API-Methode von Ask Sage verglichen und ihre Leistung anhand verschiedener Kriterien wie Textqualität, Kohärenz, Kreativität und mehr bewertet werden. Benutzer können diese Informationen verwenden, um das beste Modell für ihre Anforderungen auszuwählen und fundierte Entscheidungen darüber zu treffen, welches Modell sie in ihren Projekten verwenden möchten.

Um zu diesem Abschnitt zu gelangen, klicken Sie auf „LLM-Modelle vergleichen“.

? Im Baugewerbe?

Dies ist ein einzigartiges Projekt und wird wahrscheinlich in Zukunft veraltet sein, aber LLMs sind textbasierte Modelle, die Text basierend auf den Eingaben des Benutzers generieren. Aber was wäre, wenn wir ein Diagramm generieren wollten, ohne es manuell erstellen zu müssen? Nehmen wir zum Beispiel an, wir wollten ein Flussdiagramm, eine Mindmap, ein Gantt-Diagramm oder eine andere Art von Diagramm. In diesem Beispiel wird erläutert, wie wir mermaid.js, ein textbasiertes Diagrammerstellungstool, verwenden, um Diagramme basierend auf dem vom LLM-Modell generierten Text zu generieren.

Um zu diesem Abschnitt zu gelangen, klicken Sie auf Diagrammerstellung mit LLMs

? Im Baugewerbe?

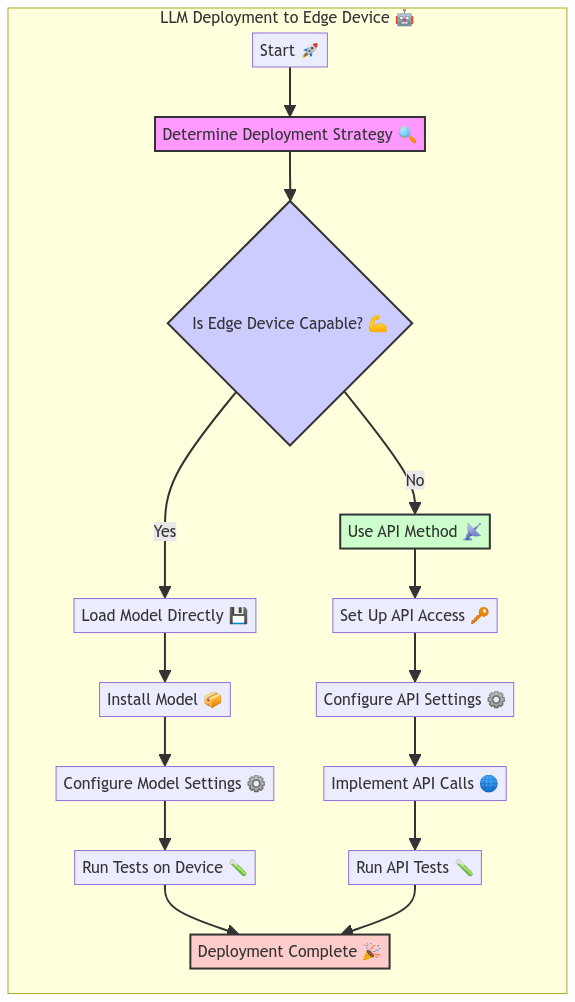

Wie wäre es mit der Möglichkeit, ein LLM-Modell auf einem Edge-Gerät wie einem Raspberry Pi oder Jetson Nano bereitzustellen? In diesem Beispiel wird erläutert, wie Sie ein LLM-Modell auf einem Edge-Gerät bereitstellen und mithilfe der Ask Sage-API Text generieren.

Um zu diesem Abschnitt zu gelangen, klicken Sie auf „LLM-Bereitstellung auf einem Edge-Gerät“.

? Im Baugewerbe?

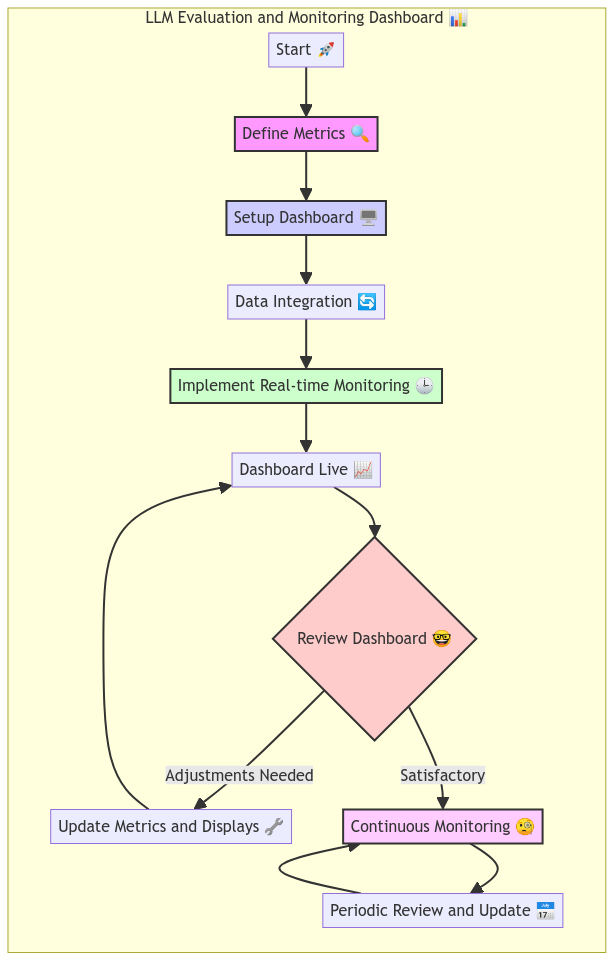

Wie bewerten wir die Leistung eines LLM-Modells und überwachen seinen Fortschritt im Laufe der Zeit? In diesem Beispiel wird erläutert, wie Sie ein Dashboard erstellen, das wichtige Kennzahlen und Erkenntnisse zum LLM-Modell anzeigt. Benutzer können dieses Dashboard verwenden, um die Leistung des Modells zu verfolgen und fundierte Entscheidungen darüber zu treffen, wie es im Laufe der Zeit verbessert werden kann.

Aber zuerst werden wir das Open-Source-Tool @arize-ai phoenix verwenden, um ein Dashboard zu erstellen, das wichtige Kennzahlen und Erkenntnisse zum LLM-Modell anzeigt.

? Im Baugewerbe?

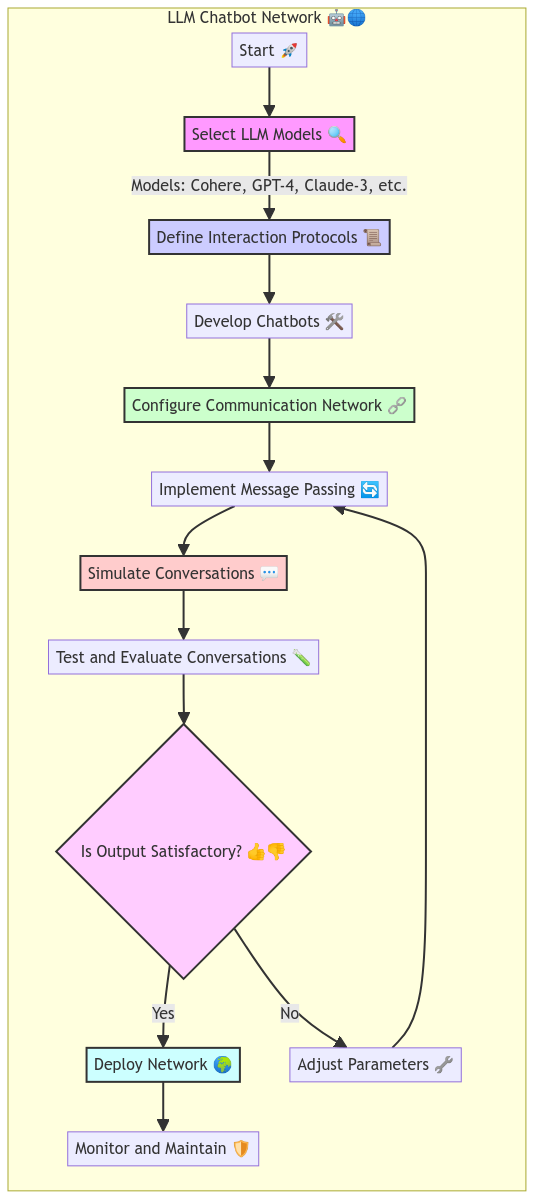

Lassen Sie uns ein Netzwerk von Chatbots erstellen, die miteinander kommunizieren und Texte basierend auf den Ergebnissen der anderen generieren können. In diesem Beispiel wird erläutert, wie Sie mithilfe von LLM-Modellen ein Chatbot-Netzwerk erstellen und eine Konversation zwischen den Chatbots simulieren. Benutzer können dieses Netzwerk nutzen, um kreative und ansprechende Texte zu generieren, die in einer Vielzahl von Anwendungen, Szenarien und Modellierungsanwendungsfällen verwendet werden können.

Um zu diesem Abschnitt zu gelangen, klicken Sie auf LLM Chatbot Network

Hier stellen wir eine Liste zusätzlicher Beispiele bereit, die von Benutzern stammen, die nach bestimmten Beispielen oder Anwendungsfällen gefragt haben. Wenn Sie ein bestimmtes Beispiel oder einen Anwendungsfall sehen möchten, wenden Sie sich bitte an uns. Wir werden unser Bestes tun, um ein Beispiel zu erstellen, das Ihren Anforderungen entspricht. Der beste Weg, uns zu erreichen, besteht darin, sich unserem Discord-Server anzuschließen und dort Ihre Anfrage zu posten. Discord - Ask Sage:

Die AskSage-API kann in bestimmten Situationen Fehler zurückgeben, beispielsweise wenn eine ungültige Anfrage gestellt wird oder wenn das Ratenlimit überschritten wird. Benutzer sollten mit den von der API zurückgegebenen Fehlercodes und Meldungen vertraut sein und diese in ihrem Code entsprechend behandeln.

Hier sind einige Best Practices, die Sie bei der Arbeit mit der Ask Sage API beachten sollten:

Wir werden zusätzliche PDF-Dokumente bereitstellen, die Ressourcen im Zusammenhang mit GenerativeAI (GenAI) enthalten. Dieses Dokument enthält Links zu Artikeln, Büchern, Tutorials, Videos und anderen Inhalten, die für Benutzer hilfreich sein können, die mehr über generative KI und deren effektive Nutzung erfahren möchten.

Unser Ziel ist es, eine umfassende Liste von Ressourcen bereitzustellen, die ein breites Themenspektrum im Zusammenhang mit generativer KI abdecken, darunter Verarbeitung natürlicher Sprache, Computer Vision, Reinforcement Learning und mehr. Wir werden auch Ressourcen einbeziehen, die spezifische Modelle und Tools abdecken, die im Bereich der generativen KI häufig verwendet werden.

Wenn Sie Vorschläge für Ressourcen haben, die in dieses Dokument aufgenommen werden sollen, wenden Sie sich bitte an uns. Wir werden mein Bestes tun, um diese in die Liste aufzunehmen.

Viel Spaß beim Lernen! ?

Wir stellen eine Liste mit Vokabeln zur Verfügung, die bei der Arbeit mit generativer KI oder maschinellem Lernen wichtig sind. Diese Begriffe helfen Benutzern, die im Bereich KI/Maschinelles Lernen verwendete Terminologie zu verstehen und sie in ihren Projekten anzuwenden.

Hier sind zum Beispiel einige Begriffe, die Sie bei der Arbeit mit generativer KI kennen sollten:

Um die vollständige Liste der Definitionen anzuzeigen, klicken Sie auf „Definitions To Know“.

Hier sind einige Funktionen oder Verbesserungen, die wir gerne zur Ask Sage API hinzugefügt sehen würden:

Jedes Element verfügt über einen Link zu dem Beispiel, das erstellt wird, um zu veranschaulichen, wo die Funktion oder Erweiterung verwendet werden kann.

Alle Fehler oder Probleme, die in der Ask Sage-API gefunden werden, sollten direkt dem Ask Sage-Team gemeldet werden. Wenn Sie Probleme mit der API haben, wenden Sie sich bitte an das Ask Sage-Team, um Hilfe zu erhalten. Darüber hinaus können Sie Fehler oder Probleme in diesem Repository melden. Wir testen und verifizieren sie, bevor wir sie an das Ask Sage-Team weiterleiten.

Dieses Repository ist unter der MIT-Lizenz lizenziert. Weitere Informationen finden Sie in der LICENSE-Datei.