Reversal of Thought

1.0.0

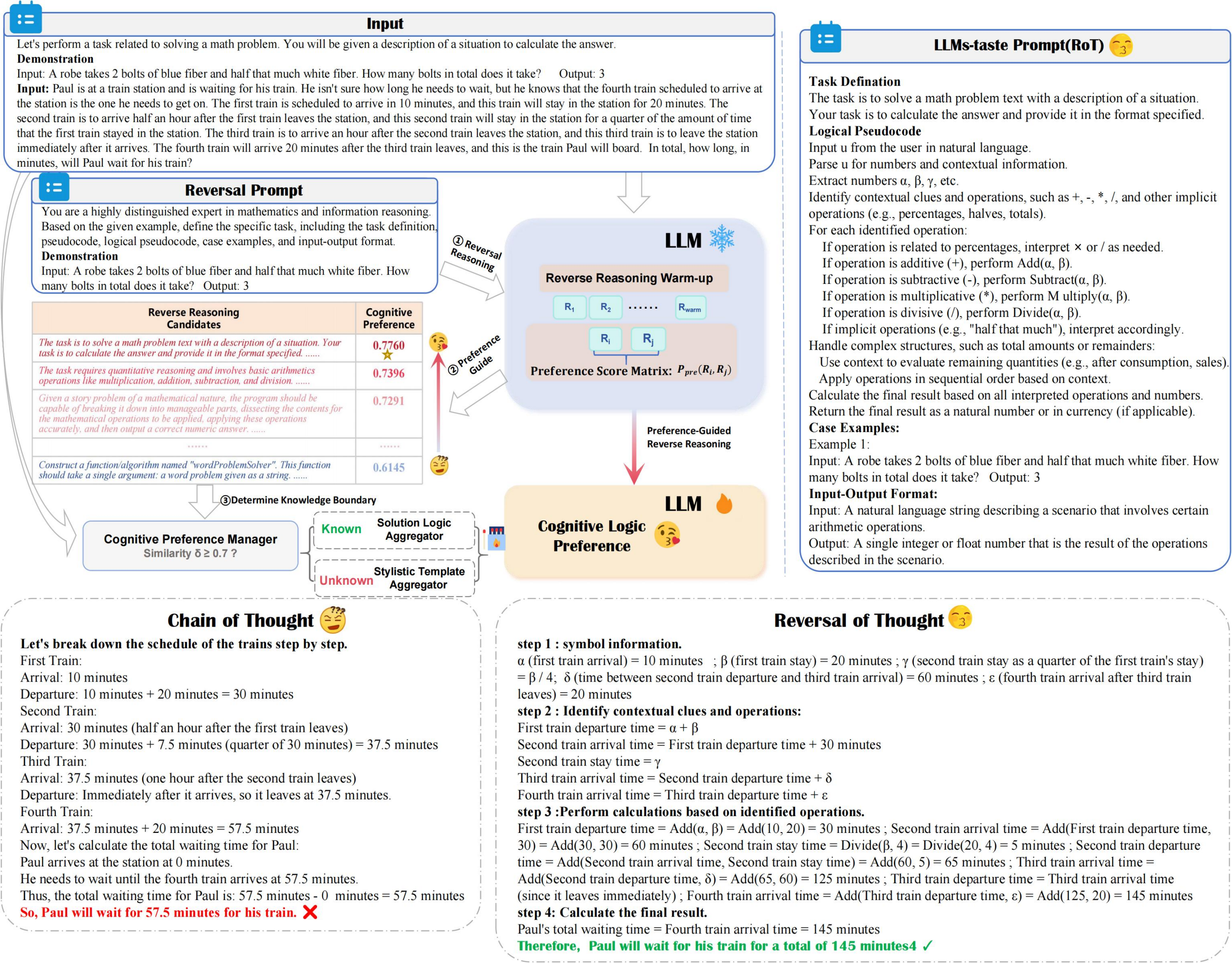

ROT verbessert die Genauigkeit und Effizienz der Argumentation und minimiert gleichzeitig die Rechenkosten, nutzt die Präferenzverwaltung und einen kognitiven Präferenzmanager, um die LLM-Argumentation mit kognitiven Präferenzen optimal zu untersuchen.

??? reversal_demo.py

from utils . llm_utils import *

from utils . prompt import *

pipeline = Pipeline ( model_id = model_id , base_url = base_url , api_key = api_key , prob = True )

demos = "Input:... Output:..." #Suggest 2-shot Demos

llm_taste = rot_pipeline ( pipeline , reversal_of_thought , demos = demos , warmup = 5 ) Verbessern Sie die LLM-vorgefertigten Eingabeaufforderungen für Aufgabenlösungen

Verfassen Sie die Aufforderung, sich an LLM-bevorzugten Strategien auszurichten und die Effizienz zu optimieren.

Potenzial für die Erstellung verschiedener QA -Datensätze

Generiert verschiedene Fragen-Antwortenpaare, um die Datensatzdiversität zu verbessern.

Wenn Sie unsere Arbeit für Ihre Forschung nützlich finden, zitieren Sie bitte unsere Arbeit wie folgt:

@article { yuan2024reversal ,

title = { Reversal of Thought: Enhancing Large Language Models with Preference-Guided Reverse Reasoning Warm-up } ,

author = { Yuan, Jiahao and Du, Dehui and Zhang, Hao and Di, Zixiang and Naseem, Usman } ,

journal = { arXiv preprint arXiv:2410.12323 } ,

year = { 2024 }

}