reweight gpt

1.0.0

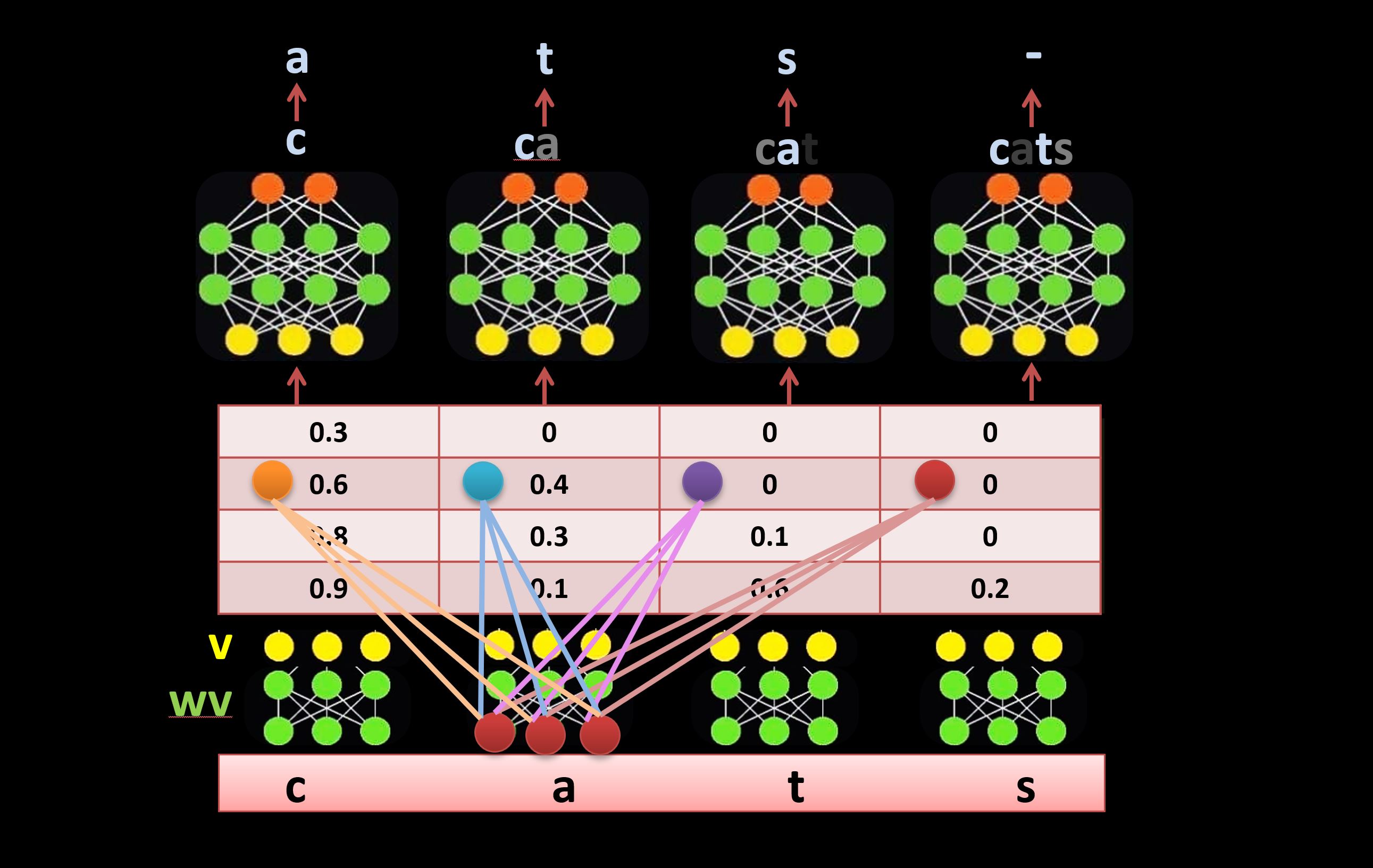

Una alternativa al mecanismo de autoatención en la arquitectura Tranformer. Utiliza conexiones laterales que se pueden aprender para reponderar las entradas directamente en lugar del mecanismo de autoatención (como se ilustra a continuación). Para obtener más información sobre el método, mire este video (de 41:26): https://youtu.be/l-CjXFmcVzY