VERI-Wild: un gran conjunto de datos y un nuevo método para la reidentificación de vehículos en la naturaleza

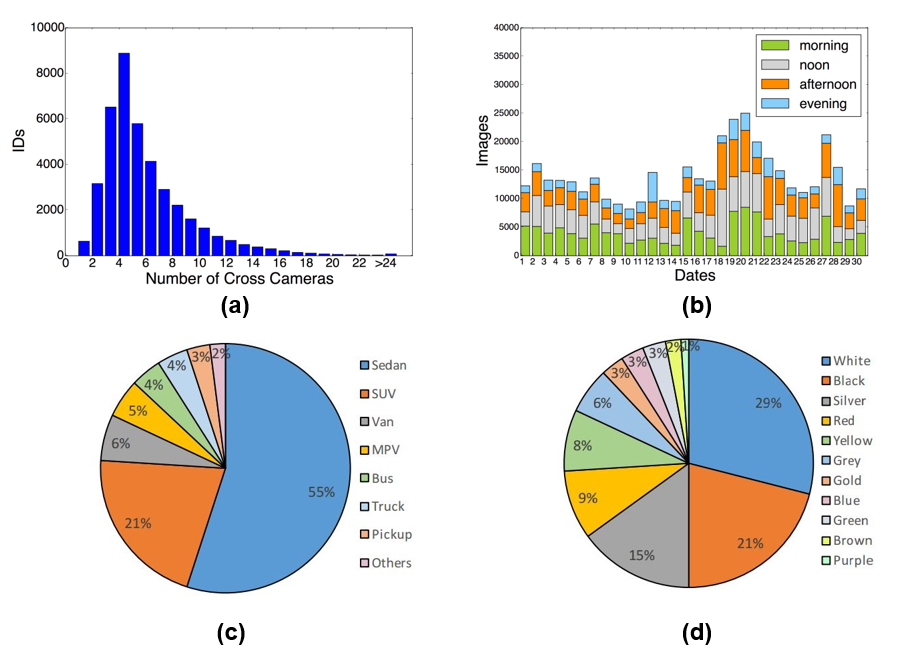

Un conjunto de datos ReID de vehículos a gran escala en estado salvaje (VERI-Wild) se captura desde un gran sistema de vigilancia CCTV que consta de 174 cámaras durante un mes (30 x 24 h) en escenarios sin restricciones. Las cámaras están distribuidas en un gran distrito urbano de más de 200 km2. El YOLO-v2 [2] se utiliza para detectar el cuadro delimitador de vehículos. El conjunto de imágenes de vehículos sin procesar contiene 12 millones de imágenes de vehículos y se invita a 11 voluntarios a limpiar el conjunto de datos durante 1 mes. Después de la limpieza y anotación de datos, se recopilan 416.314 imágenes de vehículos de 40.671 identidades. Las estadísticas de VERI-Wild se ilustran en la Figura. Por cuestiones de privacidad, las matrículas están enmascaradas en el conjunto de datos. Las características distintivas de VERI-Wild se resumen en los siguientes aspectos:

Unconstrained capture conditions in the wild El conjunto de datos VERI-Wild se recopila a partir de un sistema de cámaras CCTV real que consta de 174 cámaras de vigilancia, en las que las condiciones de captura de imágenes sin restricciones plantean una variedad de desafíos.

Complex capture conditions Las 174 cámaras de vigilancia están distribuidas en un distrito urbano de más de 200 km2, presentando diversos fondos, resoluciones, puntos de vista y oclusiones en la naturaleza. En casos extremos, un vehículo aparece en más de 40 cámaras diferentes, lo que sería un desafío para los algoritmos ReID.

Large time span involving severe illumination and weather changes VERI-Wild se recopila a partir de una duración de 125, 280 (174x24x30) horas de video. La figura (b) muestra las distribuciones de vehículos en 4 franjas horarias de 24 horas, es decir, mañana, mediodía, tarde y noche a lo largo de 30 días. VERI-Wild también contiene malas condiciones climáticas, como lluvia, niebla, etc., que no se proporcionan en conjuntos de datos anteriores.

Rich Context Information Proporcionamos información de contexto enriquecida, como ID de cámara, marca de tiempo y relación de seguimiento entre cámaras, que pueden facilitar la investigación sobre el análisis de comportamiento en redes de cámaras, como modelado de comportamiento de vehículos, seguimiento entre cámaras y recuperación basada en gráficos.

¡¡¡¡¡¡¡¡¡Importante!!!!!!!!!

Tenga en cuenta que, para el conjunto de prueba VERI-Wild, dada una imagen de consulta, debe eliminar las imágenes con la misma identificación de cámara y la misma identificación de vehículo que la imagen de consulta en el conjunto de galería. No se consideran al calcular el mAP y el CMC.

@inproceedings{lou2019large,

title={VERI-Wild: A Large Dataset and a New Method for Vehicle Re-Identification in the Wild},

author={Lou, Yihang and Bai, Yan and Liu, Jun and Wang, Shiqi and Duan, Ling-Yu},

booktitle={Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition},

pages = {3235--3243},

year={2019}

}@inproceedings{lou2019large,

title={Disentangled Feature Learning Network and a Comprehensive Benchmark for Vehicle Re-Identification},

author={Bai, Yan and Liu, Jun and Lou, Yihang and Wang, Ce and Duan, Ling-Yu},

booktitle={In IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2021}

}Yan Bai, correo electrónico: [email protected]

Para fomentar la investigación relacionada, proporcionaremos el conjunto de datos de acuerdo con su solicitud. Envíe un correo electrónico con su nombre completo y afiliación a la persona de contacto (yanbai en pku dot edu dot cn). Solicitamos su información solo para asegurarnos de que el conjunto de datos se utilice para fines no comerciales. No lo entregaremos a ningún tercero ni lo publicaremos públicamente en ningún lugar. Debido a cuestiones de privacidad, no proporcionaremos las matrículas en el futuro. Si descarga nuestro conjunto de datos, significa que ha aceptado nuestros términos de acceso en el correo electrónico.

| Métodos | Pequeño | Medio | Grande | ||||||

| mapa | Top1 | Top5 | mapa | Top1 | Top5 | mapa | Top1 | Top5 | |

| GoogleNet[1] | 24.27 | 57,16 | 75.13 | 24.15 | 53.16 | 71.1 | 21.53 | 44,61 | 63,55 |

| Red FDA (VGGM)[2] | 35.11 | 64.03 | 82,80 | 29,80 | 57,82 | 78,34 | 22,78 | 49,43 | 70,48 |

| MLSL[3] | 46,32 | - | - | 42,37 | - | - | 36,61 | - | - |

| Triplete(Resnet50) | 58,43 | 65,76 | 86,98 | 49,72 | 57,76 | 80,86 | 38,57 | 47,65 | 71,66 |

| FDA-Net(Resnet50)[2] | 61,57 | 73,62 | 91,23 | 52,69 | 64,29 | 85,39 | 45,78 | 58,76 | 80,97 |

| AAVER(Resnet50)[4] | 62.23 | 75,80 | 92,70 | 53,66 | 68.24 | 88,88 | 41,68 | 58,69 | 81,59 |

| DFLNet(Resnet50)[5] | 68.21 | 80,68 | 93,24 | 60.07 | 70,67 | 89,25 | 49.02 | 61,60 | 82,73 |

| BS (red móvil)[6] | 70,54 | 84,17 | 95.30 | 62,83 | 78,22 | 93.06 | 51,63 | 69,99 | 88,45 |

| UMTS(Resnet50)[7] | 72,7 | 84,5 | - | 66.1 | 79,3 | - | 54.2 | 72,8 | - |

| Línea de base fuerte (Resnet50)[8] | 76,61 | 90,83 | 97,29 | 70.11 | 87,45 | 95,24 | 61.3 | 82,58 | 92,73 |

| HPGN(Resnet50+PGN)[9] | 80,42 | 91,37 | - | 75,17 | 88.21 | - | 65.04 | 82,68 | - |

| GLAMOUR(Resnet50+PGN)[10] | 77,15 | 92.13 | 97,43 | - | - | - | - | - | - |

| PVEN(Resnet50)[12] | 79,8 | 94.01 | 98.06 | 73,9 | 92.03 | 97,15 | 66.2 | 88,62 | 95,31 |

| AHORRADOR(Resnet50)[11] | 80,9 | 93,78 | 97,93 | 75,3 | 92,7 | 97,48 | 67,7 | 89,5 | 95,8 |

| DFNet(Resnet50)[14] | 83.09 | 94,79 | 98.05 | 77,27 | 93,22 | 97,46 | 69,85 | 89,38 | 96.03 |

| Métodos | Probar establecer todo | Conjunto de prueba A | Conjunto de prueba B | ||||||

| mapa | Top1 | Top5 | mapa | Top1 | Top5 | mapa | Top1 | Top5 | |

| Línea de base sólida (Resnet50) [8] | 34,71 | 54,37 | 63,99 | 32,75 | 40.12 | 52.18 | 42.25 | 82,72 | 90,67 |

| GSTE (Resnet50) (con bolsa de trucos)[13] | 32,57 | 59,25 | 64,48 | 33.01 | 47,54 | 50,81 | 41,82 | 86.08 | 91,43 |

| FDA-Net (Resnet50) (con bolsa de trucos) [2] | 34.21 | 57,32 | 64,90 | 34,63 | 45,53 | 52,77 | 3.93 | 84,78 | 92,47 |

| NUNCA (Resnet50) [41] | 36,8 | 59.1 | 67,6 | 36,8 | 48,7 | 57.3 | 45,4 | 86.1 | 94,3 |

| PVEN(Resnet50)[12] | 37.15 | 61.19 | 68,63 | 38,77 | 51,28 | 59,32 | 45,48 | 88.05 | 94,35 |

| AHORRADOR(Resnet50)[11] | 38.0 | 62.1 | 69,50 | 39.2 | 52.3 | 60.2 | 45.1 | 88.1 | 94.1 |

| DFNet(Resnet50)[14] | 39,84 | 62.21 | 68,90 | 40.39 | 51,68 | 60,51 | 46.13 | 88,56 | 94,17 |

[1] Yang, L., Luo, P., Change Loy, C., Tang, X.: Un conjunto de datos de automóviles a gran escala para una categorización y verificación detalladas. En: Conferencia IEEE sobre visión por computadora y reconocimiento de patrones. (2015)

[2] Lou, Y., Bai, Y., Liu, J., Wang, S., Duan, L.: Veri-wild: un gran conjunto de datos y un nuevo método para la reidentificación de vehículos en la naturaleza. En: Conferencia IEEE sobre visión informática y reconocimiento de patrones. (2019)

[3] Alfasly, S., Hu, Y., Li, H., Liang, T., Jin, X., Liu, B., Zhao, Q.: Aprendizaje de similitud basado en etiquetas múltiples para la reidentificación de vehículos. Acceso IEEE7 (2019)

[4] Pirazh, K., Kumar, A., Peri, N., et al: Un modelo de ruta dual con atención adaptativa para la reidentificación de vehículos. En: Conferencia internacional IEEE sobre visión por computadora (2019)

[5] Yan Bai, Yihang Lou, Yongxing Dai y otros: Red de aprendizaje de funciones desenredadas para la reidentificación de vehículos. En: IJCAI 2020

[6] Kuma Ratnesh y Weill Edwin y et al: Reidentificación de vehículos: una línea de base eficiente utilizando la incrustación de tripletes. EN IJCNN 2019

[7] Xin Jin, Cuiling Lan, Wenjun Zeng, Zhibo Chen: Destilación de conocimientos multidisparo consciente de la incertidumbre para la reidentificación de objetos basada en imágenes. En: AAAI 2020

[8] Luo Hao y Gu Youzhi y et al: Bolsa de trucos y una base sólida para la reidentificación profunda de personas. En taller CVPR 2019.

[9] Shen Fei, Zhu Jianqing y et al: Exploración de la importancia espacial a través de una red híbrida de gráficos piramidales para la reidentificación de vehículos. En arXiv preimpresión arXiv:2005.14684

[10] Abhijit Suprem y Calton Pu: Luciendo GLAMOROSO: Reidentificación de vehículos en redes de cámaras heterogéneas con atención global y local. En arXiv preimpresión arXiv:2002.02256

[11] Khorramshahi Pirazh, Peri Neehar, Chen Jun-cheng, Chellappa Rama: El diablo está en los detalles: atención autosupervisada para la reidentificación de vehículos. En ECCV 2020

[12] Meng, Dechao, et al. "Red de incrustación con reconocimiento de vista basada en análisis para la reidentificación de vehículos". Actas de la Conferencia IEEE/CVF sobre visión por computadora y reconocimiento de patrones. 2020.

[13] Yan Bai, Yihang Lou, Feng Gao, Shiqi Wang, Yuwei Wu y Lingyu Duan. Incrustación de triplete sensible al grupo para la reidentificación del vehículo. Transacciones IEEE sobre multimedia, 2018.

[14] Yan Bai, Jun Liu, Yihang Lou, Ce Wang y Lingyu Duan. Red de aprendizaje de funciones desenredadas y un punto de referencia integral para la reidentificación de vehículos. Tpamí 2021.