Este trabajo utiliza modelos de difusión para implementar técnicas de relleno generativo como desenmascaramiento de imágenes, pintura, expansión y varias técnicas de relleno generativo.

Imagen en pintura (Imagen original, Imagen enmascarada, Imagen reconstruida)

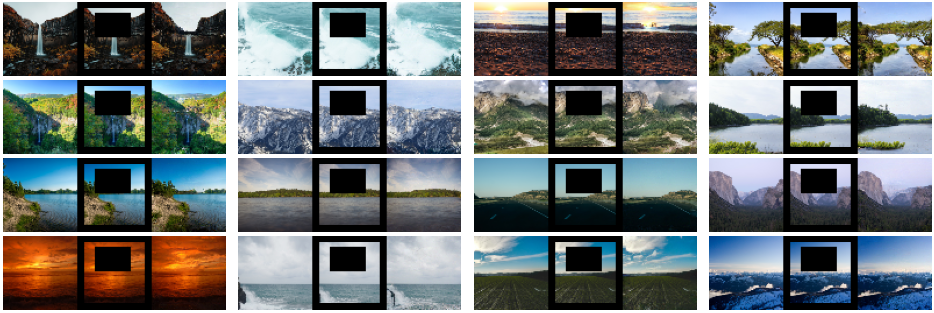

DDPM generado (entrenado y generado utilizando el conjunto de datos de paisaje).

LDM generado (entrenado en COCO y generado utilizando el conjunto de datos de paisaje).

Muestreo con COCO

Se pueden encontrar más imágenes generadas en los resultados.

Consulte mi implementación de DDPM.

Este repositorio incluye llenado generativo usando DDPM. Para realizar lo mismo usando LDM, consulte mi repositorio de LDM aquí. La carpeta ldm-genfill en este repositorio solo tiene los archivos de configuración del modelo para realizar el llenado generativo usando modelos ldm. Entonces, use la implementación en mi repositorio LDM con archivos de configuración en este repositorio. La demostración y otras instrucciones para todo el acondicionamiento de LDM están disponibles en el repositorio de LDM.

Las regiones actualmente desenmascaradas de DDPM parecen más relevantes contextualmente en comparación con LDM, ya que DDPM trabaja directamente en imágenes. El uso de texto y acondicionamiento de clase para respaldar GenFill mejora ligeramente la capacidad de relleno contextual y la capacitación adicional también puede mejorar. Es posible que haya planes para realizar mejoras más adelante.

Actualizaciones recientes