[Página de papel] [Documento] [Supp. Estera.]

Licencia de derechos de autor de software para fines de investigación científica no comercial . Lea cuidadosamente los términos y condiciones y cualquier documentación adjunta antes de descargar y/o utilizar el modelo, datos y software SMPL-X/SMPLIFY-X, ("Modelo y software"), incluidas las mallas 3D, las pesas de mezcla, las formas de mezcla , texturas, software, scripts y animaciones. Al descargar y/o usar el modelo y el software (incluida la descarga, la clonación, la instalación y cualquier otro uso de este repositorio de GitHub), reconoce que ha leído estos términos y condiciones, los comprende y acepta estar sujeto a ellos. Si no está de acuerdo con estos términos y condiciones, no debe descargar y/o usar el modelo y el software. Cualquier infracción de los términos de este Acuerdo rescindirá automáticamente sus derechos bajo esta licencia.

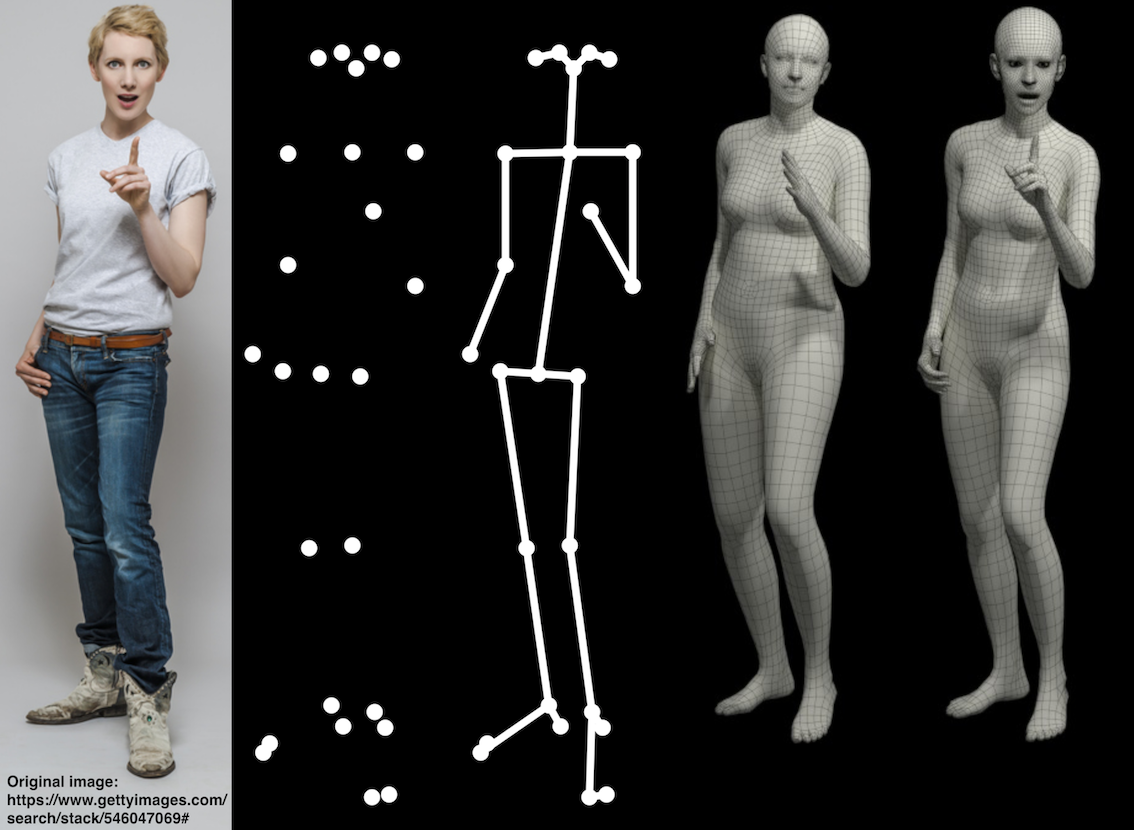

Las imágenes originales utilizadas para las Figuras 1 y 2 del papel se pueden encontrar en este enlace. Las imágenes en el documento se usan bajo licencia de gettyimages.com. Hemos adquirido el derecho de usarlos en la publicación, pero la redistribución no está permitida. Siga las instrucciones en el enlace dado para adquirir el derecho de uso. Nuestros resultados se obtienen en la resolución de 483 × 724 píxeles de las imágenes originales.

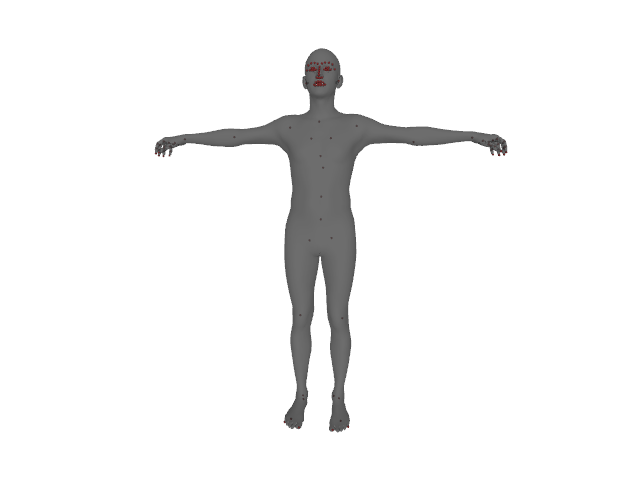

SMPL-X (SMPL expresivo) es un modelo de cuerpo unificado con parámetros de forma entrenados conjuntamente para la cara, las manos y el cuerpo. SMPL-X utiliza el desollado de mezcla lineal basado en vértices estándar con formas de mezcla correctivas aprendidas, tiene n = 10, 475 vértices y k = 54 articulaciones, que incluyen articulaciones para el cuello, la mandíbula, los ojos y los dedos. SMPL-X se define mediante una función m (θ, β, ψ), donde θ es los parámetros de pose, β los parámetros de forma y ψ los parámetros de expresión facial.

Para instalar el modelo, siga los siguientes pasos en el orden especificado:

pip install smplx[all]git clone https://github.com/vchoutas/smplx

python setup.py installPara descargar el modelo SMPL-X , vaya al sitio web de este proyecto y regístrese para obtener acceso a la sección Descargas.

Para descargar el modelo SMPL+H, vaya al sitio web de este proyecto y regístrese para obtener acceso a la sección Descargas.

Para descargar el modelo SMPL , visite este sitio web del proyecto (Modelos masculinos y femeninos) y este (Modelo de género neutral) y regístrese para obtener acceso a la sección Descargas.

El cargador da la opción de usar cualquiera de los modelos SMPL-X, SMPL+H, SMPL y MANO. Dependiendo del modelo que desee usar, siga las instrucciones de descarga respectivas. Para cambiar entre MANO, SMPL, SMPL+H y SMPL-X, simplemente cambie los parámetros model_path o model_type . Para obtener más detalles, consulte los documentos de las clases de modelos. Antes de usar SMPL y SMPL+H, debe seguir las instrucciones en herramientas/readMe.md para eliminar los objetos chumpy de ambos PKL modelo, así como fusionar los parámetros de MANO con SMPL+H.

Puede usar la función Crear desde Body_Models o llamar directamente al constructor para el modelo SMPL, SMPL+H y SMPL-X. La ruta al modelo puede ser la ruta al archivo con los parámetros o un directorio con la siguiente estructura:

models

├── smpl

│ ├── SMPL_FEMALE.pkl

│ └── SMPL_MALE.pkl

│ └── SMPL_NEUTRAL.pkl

├── smplh

│ ├── SMPLH_FEMALE.pkl

│ └── SMPLH_MALE.pkl

├── mano

| ├── MANO_RIGHT.pkl

| └── MANO_LEFT.pkl

└── smplx

├── SMPLX_FEMALE.npz

├── SMPLX_FEMALE.pkl

├── SMPLX_MALE.npz

├── SMPLX_MALE.pkl

├── SMPLX_NEUTRAL.npz

└── SMPLX_NEUTRAL.pklLas correspondencias de vértices entre SMPL-X y Mano, Flame se puede descargar desde el sitio web del proyecto. Si ha extraído los datos de correspondencia en las correspondencias de la carpeta, use los siguientes scripts para visualizarlos:

python examples/vis_mano_vertices.py --model-folder $SMPLX_FOLDER --corr-fname correspondences/MANO_SMPLX_vertex_ids.pkl

python examples/vis_flame_vertices.py --model-folder $SMPLX_FOLDER --corr-fname correspondences/SMPL-X__FLAME_vertex_ids.npy

Después de instalar el paquete SMPLX y descargar los parámetros del modelo, debería poder ejecutar el script demo.py para visualizar los resultados. Para este paso, debe instalar los paquetes Pyrender y Trimesh.

python examples/demo.py --model-folder $SMPLX_FOLDER --plot-joints=True --gender="neutral"

Si desea modificar la pose global del modelo, es decir, la rotación y la traducción de la raíz, a un nuevo sistema de coordenadas, por ejemplo, debe tener en cuenta que la rotación del modelo usa la pelvis como centro de rotación. Se puede encontrar una descripción más detallada en el siguiente enlace. Si algo no está claro, hágamelo saber para que pueda actualizar la descripción.

Dependiendo de qué modelo esté cargado para su proyecto, es decir, SMPL-X o SMPL+H o SMPL, cite el trabajo más relevante a continuación, en la lista en el mismo orden:

@inproceedings{SMPL-X:2019,

title = {Expressive Body Capture: 3D Hands, Face, and Body from a Single Image},

author = {Pavlakos, Georgios and Choutas, Vasileios and Ghorbani, Nima and Bolkart, Timo and Osman, Ahmed A. A. and Tzionas, Dimitrios and Black, Michael J.},

booktitle = {Proceedings IEEE Conf. on Computer Vision and Pattern Recognition (CVPR)},

year = {2019}

}

@article{MANO:SIGGRAPHASIA:2017,

title = {Embodied Hands: Modeling and Capturing Hands and Bodies Together},

author = {Romero, Javier and Tzionas, Dimitrios and Black, Michael J.},

journal = {ACM Transactions on Graphics, (Proc. SIGGRAPH Asia)},

volume = {36},

number = {6},

series = {245:1--245:17},

month = nov,

year = {2017},

month_numeric = {11}

}

@article{SMPL:2015,

author = {Loper, Matthew and Mahmood, Naureen and Romero, Javier and Pons-Moll, Gerard and Black, Michael J.},

title = {{SMPL}: A Skinned Multi-Person Linear Model},

journal = {ACM Transactions on Graphics, (Proc. SIGGRAPH Asia)},

month = oct,

number = {6},

pages = {248:1--248:16},

publisher = {ACM},

volume = {34},

year = {2015}

}

Este repositorio se desarrolló originalmente para SMPL-X/SMPLIFY-X (CVPR 2019), es posible que esté interesado en echar un vistazo: https://smpl-x.is.tue.mpg.de.

Un agradecimiento especial a Soubhik Sanyal por compartir el código TensorFlow utilizado para los puntos de referencia faciales.

El código de este repositorio fue implementado por Vassilis Choutas.

Para preguntas, comuníquese con [email protected].

Para obtener licencias comerciales (y todas las preguntas relacionadas para aplicaciones comerciales), comuníquese con [email protected].